Liberar el potencial de los grandes modelos de lenguaje multimodal (MLLM) para manejar diversas modalidades como voz, texto, imágenes y video es un paso crucial en el desarrollo de la IA. Esta capacidad es esencial para aplicaciones como la comprensión del lenguaje natural, la recomendación de contenido y la recuperación de información multimodal, lo que mejora la precisión y solidez de los sistemas de IA.

Los métodos tradicionales para manejar desafíos multimodales a menudo se basan en modelos densos o enfoques de modalidad de un solo experto. Los modelos densos involucran todos los parámetros en cada cálculo, lo que genera una mayor sobrecarga computacional y una escalabilidad reducida a medida que crece el tamaño del modelo. Por otro lado, los enfoques de un solo experto carecen de la flexibilidad y adaptabilidad necesarias para integrar y comprender de manera efectiva diversos datos multimodales. Estos métodos a menudo tienen dificultades con tareas complejas que involucran múltiples modalidades simultáneamente, como comprender largos segmentos de voz o procesar combinaciones intrincadas de imagen y texto.

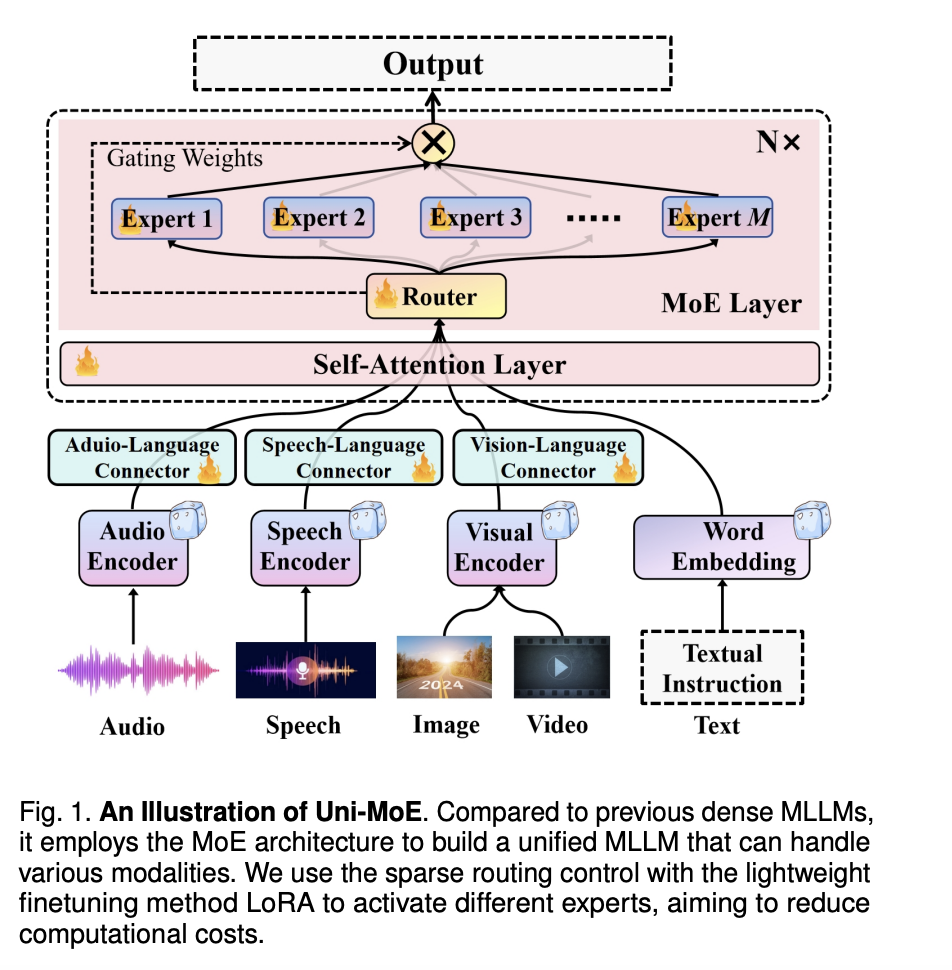

Los investigadores del Instituto de Tecnología de Harbin propusieron el innovador enfoque Uni-MoE, que aprovecha una arquitectura de mezcla de expertos (MoE) junto con una estrategia de capacitación estratégica de tres fases. Uni-MoE optimiza la selección y la colaboración de expertos, lo que permite que los expertos de modalidades específicas trabajen de forma sinérgica para mejorar el rendimiento del modelo. La estrategia de capacitación de tres fases incluye fases de capacitación especializadas para datos multimodales, lo que mejora la estabilidad, solidez y adaptabilidad del modelo. Este nuevo enfoque no solo supera los inconvenientes de los modelos densos y los enfoques de un solo experto, sino que también demuestra avances significativos en las capacidades de los sistemas de IA multimodales, particularmente en el manejo de tareas complejas que involucran diversas modalidades.

Los avances técnicos de Uni-MoE incluyen un marco MoE que se especializa en diferentes modalidades y una estrategia de capacitación de tres fases para una colaboración optimizada. Los mecanismos de enrutamiento avanzados asignan datos de entrada a expertos relevantes, optimizando los recursos computacionales, mientras que las técnicas auxiliares de pérdida de equilibrio garantizan la misma importancia de los expertos durante el entrenamiento. Estas complejidades hacen de Uni-MoE una solución sólida para tareas multimodales complejas.

Los resultados muestran la superioridad de Uni-MoE con puntuaciones de precisión que van del 62,76 % al 66,46 % en puntos de referencia de evaluación como ActivityNet-QA, RACE-Audio y A-OKVQA. Supera a los modelos densos, muestra una mejor generalización y maneja eficazmente tareas largas de comprensión del habla. El éxito de Uni-MoE marca un importante avance en el aprendizaje multimodal y promete un mayor rendimiento, eficiencia y generalización para futuros sistemas de IA.

En conclusión, Uni-MoE representa un importante avance en el ámbito del aprendizaje multimodal y los sistemas de inteligencia artificial. Su enfoque innovador, que aprovecha una arquitectura de combinación de expertos (MoE) y una estrategia de capacitación estratégica de tres fases, aborda las limitaciones de los métodos tradicionales y desbloquea un mejor rendimiento, eficiencia y generalización en diversas modalidades. Las impresionantes puntuaciones de precisión logradas en varios puntos de referencia de evaluación, incluidos ActivityNet-QA, RACE-Audio y A-OKVQA, subrayan la superioridad de Uni-MoE en el manejo de tareas complejas como la comprensión de discursos largos. Esta tecnología innovadora no solo supera los desafíos existentes, sino que también allana el camino para futuros avances en los sistemas de IA multimodal, reafirmando su papel fundamental en la configuración del futuro de la tecnología de IA.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Únete a nuestro Canal de telegramas, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro SubReddit de 42k+ ML

Aswin AK es pasante de consultoría en MarkTechPost. Está cursando su doble titulación en el Instituto Indio de Tecnología de Kharagpur. Le apasiona la ciencia de datos y el aprendizaje automático, y aporta una sólida formación académica y experiencia práctica en la resolución de desafíos interdisciplinarios de la vida real.