Los modelos de lenguaje grande (LLM) ahora admiten ventanas de contexto muy largas, pero la complejidad cuadrática de la atención estándar da como resultado una latencia de tiempo hasta el primer token (TTFT) significativamente prolongada. Los métodos existentes para abordar esta complejidad requieren un preentrenamiento o ajuste adicional y, a menudo, comprometen la precisión del modelo. La naturaleza cuadrática del mecanismo de atención básico en estos modelos aumenta significativamente el tiempo computacional, lo que dificulta las interacciones en tiempo real. Las soluciones actuales generalmente comprometen la precisión del modelo o requieren un preentrenamiento adicional, lo que a menudo resulta poco práctico.

Los métodos actuales para mitigar la complejidad cuadrática de la atención en los modelos LLM incluyen atención dispersa, matrices de bajo rango, atención dispersa y de bajo rango unificada, estados recurrentes y memoria externa. Estos enfoques apuntan a aproximarse a la atención densa o gestionar la memoria de manera más eficiente. Sin embargo, a menudo requieren un preentrenamiento o ajuste adicional, lo que genera pérdidas de precisión y hace que los modelos preentrenados sean poco prácticos.

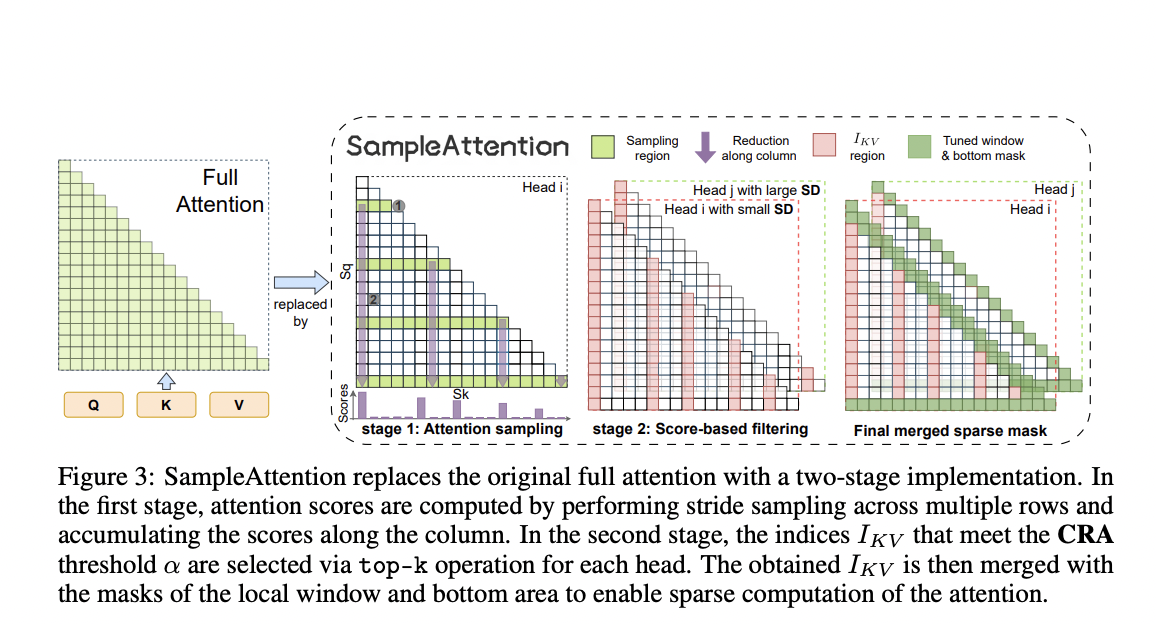

Un equipo de investigadores de China propuso SampleAttention, un mecanismo de atención dispersa estructurado y adaptativo. SampleAttention aprovecha los patrones dispersos significativos observados en los mecanismos de atención para capturar información esencial con una sobrecarga mínima. Se ocupa de un porcentaje fijo de tokens adyacentes para manejar patrones de ventana local. Emplea un enfoque de filtrado de clave-valor (KV) guiado por consultas de dos etapas para capturar patrones de franjas de columnas. Este método ofrece una atención dispersa casi sin pérdidas, que se integra perfectamente en los LLM listos para usar sin comprometer la precisión.

SampleAttention aborda la alta latencia de TTFT al capturar dinámicamente patrones dispersos específicos de la cabeza durante el tiempo de ejecución con una sobrecarga baja. El método se centra en dos patrones dispersos principales: patrones de ventana local y patrones de franjas de columna. Los patrones de ventana local se manejan prestando atención a un porcentaje fijo de tokens adyacentes, lo que garantiza que las dependencias locales importantes se capturen de manera eficiente. Los patrones de franjas de columna se administran a través de un enfoque de filtrado de KV guiado por consulta de dos etapas, que selecciona de manera adaptativa un conjunto mínimo de valores clave para mantener una sobrecarga computacional baja.

El método propuesto se evaluó en variantes LLM ampliamente utilizadas como ChatGLM2-6B e internLM2-7B, demostrando su eficacia en escenarios de contexto largo. SampleAttention mostró mejoras significativas en el rendimiento, reduciendo el TTFT hasta 2,42 veces en comparación con FlashAttention. Las evaluaciones incluyeron tareas como LongBench, BABILong y la prueba de estrés “Needle in a Haystack”, donde SampleAttention mantuvo casi sin pérdida de precisión mientras aceleraba significativamente las operaciones de atención.

Esta investigación aborda de manera eficaz el problema de la alta latencia de TTFT en los LLM con ventanas de contexto largas mediante la introducción de SampleAttention. Este método adaptativo de atención dispersa estructurada reduce la sobrecarga computacional al tiempo que mantiene la precisión, lo que proporciona una solución práctica para la integración en modelos entrenados previamente. La combinación de patrones de franjas de columnas y ventanas locales garantiza un manejo eficiente de la información esencial, lo que convierte a SampleAttention en un avance prometedor para las aplicaciones en tiempo real de los LLM.

Revisar la Papel. Todo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo.

Únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Subreddit de más de 46 000 millones de usuarios

Shreya Maji es pasante de consultoría en MarktechPost. Estudió su licenciatura en el Instituto Indio de Tecnología (IIT) en Bhubaneswar. Es una entusiasta de la inteligencia artificial y le gusta mantenerse al día de los últimos avances. Shreya está particularmente interesada en las aplicaciones reales de la tecnología de vanguardia, especialmente en el campo de la ciencia de datos.