Numerosas aplicaciones de procesamiento del lenguaje natural (NLP) se han beneficiado enormemente del uso de modelos de lenguaje grandes (LLM). Si bien los LLM han mejorado en rendimiento y han adquirido capacidades adicionales debido a su escalamiento, todavía tienen el problema de “alucinar” o producir información inconsistente con los hechos del mundo real detectados durante la capacitación previa. Esto representa una barrera importante para la adopción de aplicaciones de alto riesgo (como las que se encuentran en entornos clínicos y legales), donde la generación de texto confiable es esencial.

El objetivo de modelado del lenguaje de máxima probabilidad, que busca minimizar la divergencia directa de KL entre los datos y las distribuciones del modelo, puede ser el culpable de las alucinaciones de los LM. Sin embargo, esto está lejos de ser seguro. El LM puede asignar una probabilidad distinta de cero a frases que no sean totalmente consistentes con el conocimiento codificado en los datos de entrenamiento si se persigue este objetivo.

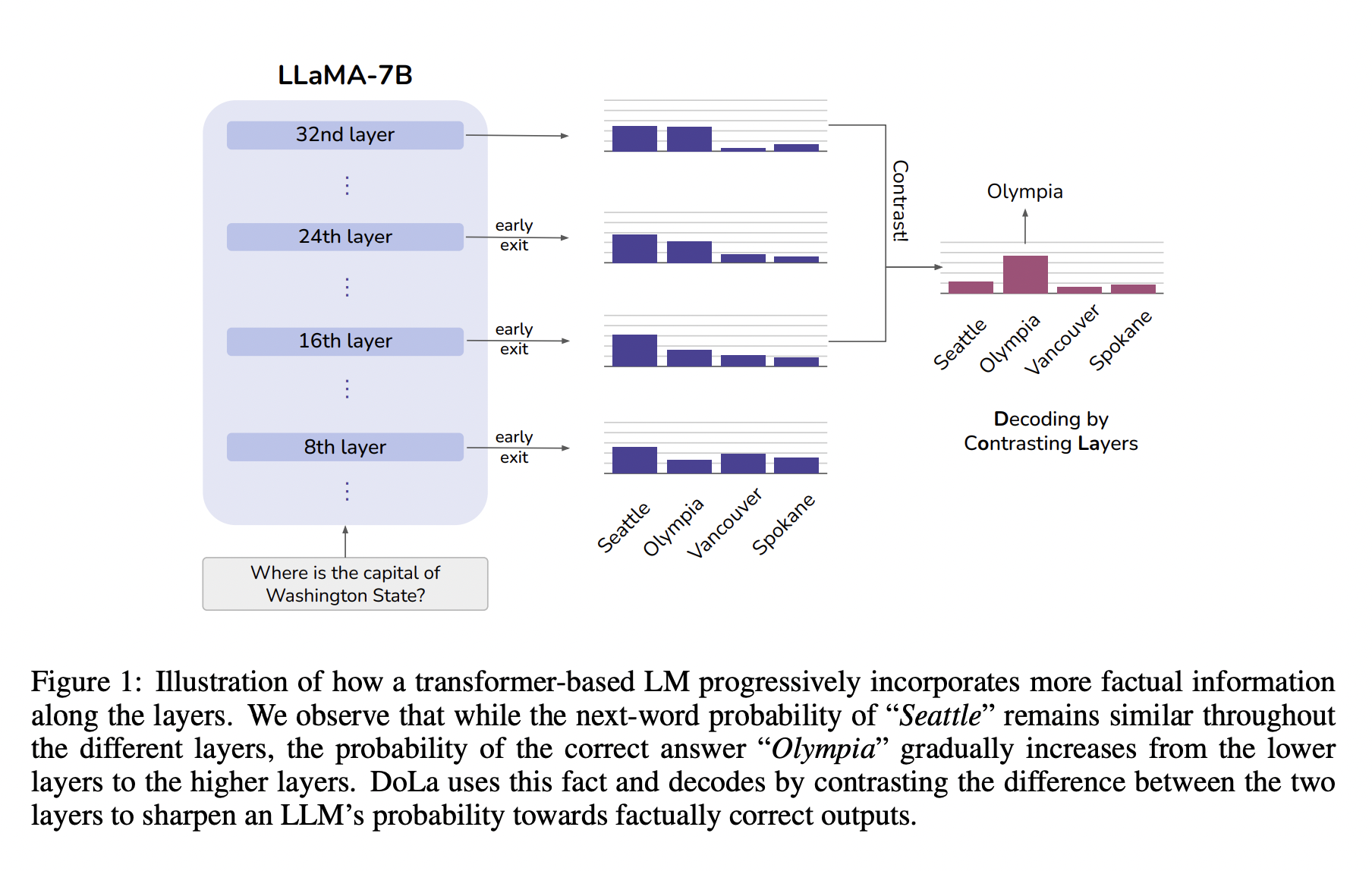

Desde la perspectiva de la interpretabilidad del modelo, los estudios han demostrado que las capas anteriores de los LM transformadores codifican información de “nivel inferior” (como etiquetas de parte del discurso). Por el contrario, los niveles posteriores codifican más información “semántica”.

Un grupo de investigadores del MIT y Microsoft sugieren utilizar esta codificación modular de conocimiento para aumentar el conocimiento fáctico del LM a través de una estrategia de decodificación contrastiva, donde la probabilidad de que se produzca la siguiente palabra se calcula utilizando la diferencia en logits de una capa superior. Con esto, es posible hacer que los LM estén más arraigados en la realidad y reducir las alucinaciones al priorizar la información de niveles más profundos y restar importancia a la de niveles intermedios o superficiales.

Su trabajo reciente presenta Decoding by Contrasting Layers (DoLa), un novedoso enfoque de decodificación. El método propuesto se basa en mejorar la exposición del conocimiento fáctico codificado en un LLM sin recuperar conocimiento externo ni realizar más ajustes.

Se ha demostrado experimentalmente que DoLa mejora la integridad de los modelos de la familia LLaMA tanto en TruthfulQA como en FACTOR. Tanto para StrategyQA como para GSM8K cc, experimentos adicionales sobre razonamiento en cadena de pensamiento demuestran su potencial para mejorar el razonamiento fáctico. Finalmente, los resultados experimentales sobre la producción de texto abierto (evaluados con GPT-4) revelan que DoLa puede generar respuestas informativas y significativamente más objetivas que conducen a calificaciones superiores en comparación con el enfoque de decodificación original. DoLa es un enfoque de decodificación que se puede utilizar para aumentar la honestidad de los LLM, y los hallazgos muestran que solo agrega una pequeña cantidad de tiempo al proceso de decodificación.

Los investigadores no investigaron el desempeño del modelo en otros dominios, como seguir instrucciones o captar comentarios humanos. Además, en lugar de aprovechar etiquetas humanas o fuentes de información factual para realizar ajustes, el equipo se basa en arquitectura y parámetros preexistentes, lo que restringe el alcance de posibles mejoras. A diferencia de ciertos LM con recuperación aumentada, esta técnica depende completamente del conocimiento preexistente del modelo en lugar de agregar nueva información a través de módulos de recuperación externos. El equipo espera que el trabajo futuro incorpore los componentes anteriores con su técnica de decodificación para ayudar a superar las restricciones.

Revisar la Papel y GitHub. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de más de 30.000 ml, Comunidad de Facebook de más de 40.000 personas, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

Dhanshree Shenwai es ingeniero en informática y tiene una buena experiencia en empresas de tecnología financiera que cubren el ámbito financiero, tarjetas y pagos y banca con un gran interés en las aplicaciones de IA. Le entusiasma explorar nuevas tecnologías y avances en el mundo en evolución de hoy que facilita la vida de todos.