A pesar de tener algunos paralelos con otras cuestiones de modelado de secuencias, como texto, audio o vídeo, las series temporales tienen dos características que las hacen particularmente difíciles. Los conjuntos de datos de series temporales agregadas frecuentemente incluyen secuencias de fuentes drásticamente variadas, ocasionalmente con valores faltantes, en contraste con el video o el audio, que normalmente tienen escalas de entrada y frecuencias de muestreo uniformes. Además, muchas aplicaciones de pronóstico de series temporales, como las de datos meteorológicos o financieros, requieren la extrapolación de observaciones que sólo contienen una pequeña parte de la información que puede haber allí. Esto hace que los pronósticos puntuales precisos sean increíblemente difíciles, lo que hace que las estimaciones de incertidumbre sean aún más cruciales.

El preentrenamiento no se utiliza con frecuencia para el modelado de series temporales porque no existe un objetivo no supervisado consensuado y no es fácil acceder a conjuntos de datos de preentrenamiento grandes y cohesivos. Sin embargo, el preentrenamiento a gran escala se ha convertido en un componente clave del entrenamiento de grandes redes neuronales en visión y texto, lo que permite que el rendimiento escale directamente con la disponibilidad de datos. Por lo tanto, los enfoques básicos de series de tiempo, como ARIMA y los modelos lineales, con frecuencia superan a las técnicas de aprendizaje profundo en puntos de referencia comunes. Los autores muestran cómo los modelos de lenguaje grande (LLM) podrían cerrar ingenuamente la brecha entre los sesgos directos de los enfoques convencionales y el intrincado aprendizaje representacional y las capacidades generativas de la comprensión profunda contemporánea.

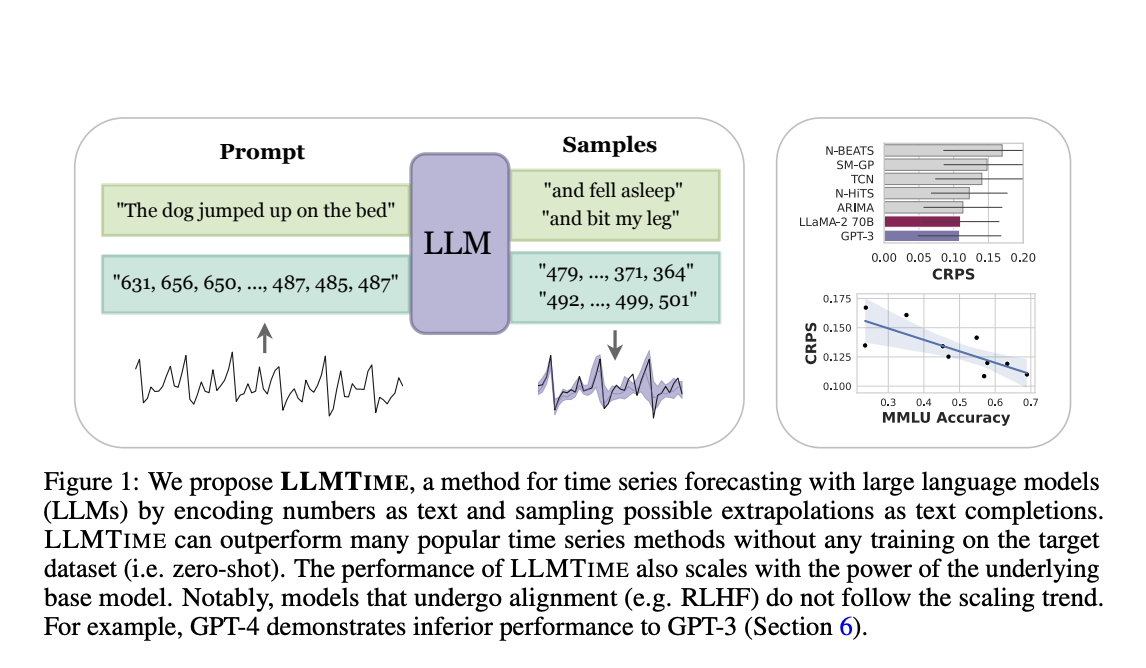

Para utilizar LLM previamente capacitados para aplicaciones de predicción de series de tiempo continuas, los investigadores presentan el enfoque muy sencillo LLMTIME2, que es de alto nivel como se muestra en la Figura 1. Esta técnica, que considera el pronóstico de series de tiempo como una predicción del siguiente token en texto y fundamentalmente representa el tiempo. La serie como una cadena de dígitos numéricos permite aplicar modelos robustos previamente entrenados y capacidades probabilísticas como evaluación de probabilidad y muestreo. Proporcionan métodos para (1) codificar eficientemente series de tiempo como una cadena de dígitos numéricos y (2) convertir las distribuciones LLM discretas en densidades continuas que pueden describir distribuciones multimodales complejas para lograr un alto rendimiento. Usando estas estrategias, descubren que LLMTIME puede ser Se aplica sin modificar los datos posteriores utilizados por otros modelos para superar o igualar los métodos de series de tiempo diseñados específicamente para diversos problemas.

Figura 1: Utilizando modelos de lenguaje grande (LLM), los investigadores presentan LLMTIME, un método para el pronóstico de series temporales que implica codificar números como texto y seleccionar posibles extrapolaciones como terminaciones de texto. Sin ningún entrenamiento en el conjunto de datos objetivo (es decir, disparo cero), LLMTIME puede superar una serie de algoritmos de series temporales bien conocidos. La solidez del modelo base subyacente también aumenta con el desempeño de LLMTIME. Cabe señalar que los modelos que pasan por alineación (como RLHF) no se adhieren a la tendencia de escala.

Por ejemplo, la Sección 6 muestra que GPT-4 funciona peor que GPT-3.

La propiedad de disparo cero de LLMTIME tiene los siguientes beneficios inherentes: (1) Facilita la aplicación simple de LLM, eliminando la necesidad de conocimientos especializados de procedimientos de ajuste y los importantes recursos computacionales necesarios para estos procedimientos. (2) Se adapta bien a escenarios con disponibilidad de datos limitada, con poca información para capacitación o ajuste. (3) Evita el tiempo, el esfuerzo y la experiencia en un dominio específico considerables que generalmente se necesitan para crear modelos de series de tiempo especializados mediante el uso de las amplias capacidades de extrapolación de patrones de los LLM previamente capacitados. Observan cómo los LLM exhiben preferencias por secuencias sencillas o repetitivas y demuestran que estos sesgos son consistentes con las características importantes de las series temporales, como la estacionalidad, para comprender las razones detrás del excelente desempeño de LLMTIME. Aparte de estos sesgos, los LLM también pueden representar distribuciones multimodales y acomodar fácilmente datos faltantes, lo cual es especialmente útil para series temporales.

También demuestran cómo los LLM hacen posible funciones atractivas como solicitar información adicional adicional y pedirle al LLM que justifique sus predicciones. Finalmente, muestran que el desempeño tiende a aumentar con el tamaño y que la calidad de los pronósticos puntuales también aumenta con la calidad de la representación de la incertidumbre, además de un desempeño de pronóstico generalmente atractivo. También descubrieron que GPT-4 tiene una peor calibración de incertidumbre que GPT-3, probablemente debido a intervenciones como RLHF (aprendizaje por refuerzo con retroalimentación humana).

Revisar la Papel y GitHub. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de 32k+ ML, Comunidad de Facebook de más de 40.000 personas, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

también estamos en Telegrama y WhatsApp.

Aneesh Tickoo es pasante de consultoría en MarktechPost. Actualmente está cursando su licenciatura en Ciencia de Datos e Inteligencia Artificial en el Instituto Indio de Tecnología (IIT), Bhilai. Pasa la mayor parte de su tiempo trabajando en proyectos destinados a aprovechar el poder del aprendizaje automático. Su interés de investigación es el procesamiento de imágenes y le apasiona crear soluciones en torno a él. Le encanta conectarse con personas y colaborar en proyectos interesantes.