Investigadores de diferentes universidades comparan la eficacia de los modelos lingüísticos (LLM) y los motores de búsqueda para ayudar en la verificación de datos. Las explicaciones de LLM ayudan a los usuarios a verificar los hechos de manera más eficiente que los motores de búsqueda, pero los usuarios tienden a confiar en los LLM incluso cuando las explicaciones son incorrectas. Agregar información contrastante reduce la dependencia excesiva, pero solo supera significativamente a los motores de búsqueda. En situaciones de alto riesgo, las explicaciones del LLM pueden no ser un sustituto confiable de la lectura de pasajes recuperados, ya que confiar en explicaciones incorrectas de la IA podría tener graves consecuencias.

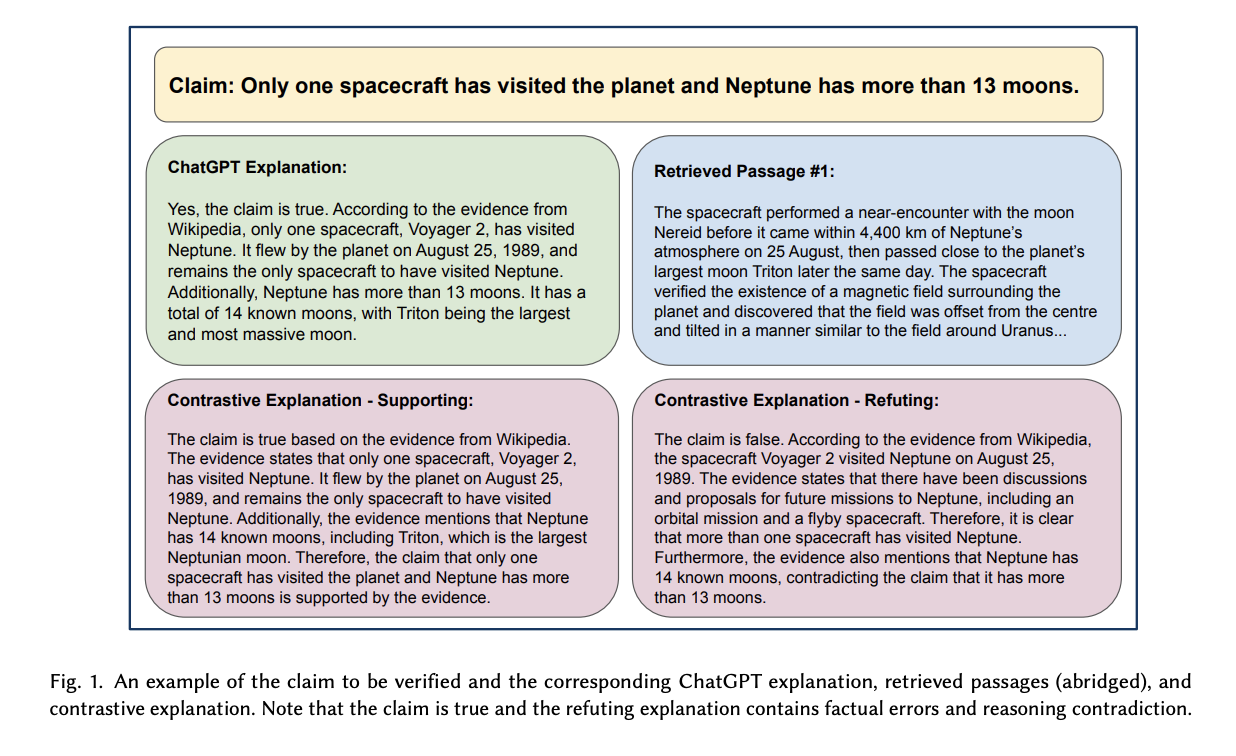

Su investigación compara modelos lingüísticos y motores de búsqueda para la verificación de hechos y descubre que las explicaciones de los modelos lingüísticos mejoran la eficiencia, pero pueden generar una dependencia excesiva cuando son incorrectas. En escenarios de alto riesgo, es posible que las explicaciones del LLM no reemplacen los pasajes de lectura. Otro estudio muestra que las explicaciones de ChatGPT mejoran la verificación humana en comparación con los pasajes recuperados, lo que lleva menos tiempo pero desalienta las búsquedas de afirmaciones en Internet.

El estudio actual se centra en el papel de los LLM en la verificación de hechos y su eficiencia en comparación con los motores de búsqueda. Las explicaciones del LLM son más efectivas pero conducen a una confianza excesiva, especialmente cuando son incorrectas. Se proponen explicaciones contrastantes pero no superan a los motores de búsqueda. Es posible que las explicaciones de LLM no reemplacen la lectura de pasajes en situaciones de alto riesgo, ya que confiar en explicaciones incorrectas de la IA podría tener graves consecuencias.

El método propuesto compara modelos lingüísticos y motores de búsqueda en la verificación de datos utilizando 80 trabajadores colaborativos. Las explicaciones de los modelos de lenguaje mejoran la eficiencia, pero los usuarios tienden a confiar demasiado en ellas. También examina los beneficios de combinar los resultados de los motores de búsqueda con explicaciones de modelos de lenguaje. El estudio utiliza un diseño entre sujetos, midiendo la precisión y el tiempo de verificación para evaluar el impacto de la recuperación y la explicación.

Las explicaciones del modelo de lenguaje mejoran la precisión de la verificación de hechos en comparación con una línea de base sin evidencia. Los pasajes recuperados también mejoran la precisión. No existe una diferencia significativa en la precisión entre las explicaciones del modelo de lenguaje y los pasajes recuperados, pero las explicaciones se leen más rápido. No supera a la recuperación en precisión. Los modelos lingüísticos pueden explicar de manera convincente afirmaciones incorrectas, lo que podría dar lugar a juicios erróneos. Es posible que las explicaciones de LLM no reemplacen los pasajes de lectura, especialmente en situaciones de alto riesgo.

En conclusión, los LLM mejoran la precisión de la verificación de hechos, pero plantean el riesgo de una dependencia excesiva y de juicios incorrectos cuando sus explicaciones son erróneas. Combinar explicaciones de LLM con resultados de búsqueda no ofrece beneficios adicionales. Las explicaciones de LLM son más rápidas de leer pero pueden explicar de manera convincente afirmaciones falsas. En situaciones de alto riesgo, no es aconsejable confiar únicamente en las explicaciones del LLM; La lectura de los pasajes recuperados sigue siendo crucial para una verificación precisa.

El estudio propone personalizar la evidencia para los usuarios, combinar estratégicamente la recuperación y la explicación, y explorar cuándo mostrar explicaciones o pasajes recuperados. Investiga los efectos de presentar ambos simultáneamente en la precisión de la verificación. La investigación también examina los riesgos de una dependencia excesiva de las explicaciones de los modelos lingüísticos, especialmente en situaciones de alto riesgo. Explora métodos para mejorar la confiabilidad y precisión de estas explicaciones como una alternativa viable a la lectura de pasajes recuperados.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de 32k+ ML, Comunidad de Facebook de más de 40.000 personas, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.también estamos en Telegrama y WhatsApp.

Hola, mi nombre es Adnan Hassan. Soy pasante de consultoría en Marktechpost y pronto seré aprendiz de gestión en American Express. Actualmente estoy cursando una doble titulación en el Instituto Indio de Tecnología, Kharagpur. Me apasiona la tecnología y quiero crear nuevos productos que marquen la diferencia.