Las crecientes capacidades de los modelos de lenguaje en aplicaciones del mundo real a menudo se ven obstaculizadas por los intrincados desafíos asociados con su entrenamiento a gran escala utilizando métodos convencionales como la retropropagación estándar. El último avance de Google DeepMind, DiLoCo (Distributed Low-Communication), sienta un nuevo precedente en la optimización del modelo de lenguaje. En el papel “DiLoCo: Entrenamiento distribuido de modelos lingüísticos de baja comunicación”, el equipo de investigación presenta un innovador algoritmo de optimización distribuida que revoluciona los enfoques de capacitación al operar en grupos de dispositivos poco conectados, logrando un notable aumento del rendimiento y reduciendo la comunicación 500 veces.

Inspirándose en los principios del aprendizaje federado, los investigadores idearon una variante del ampliamente reconocido algoritmo de promedio federado (FedAvg), infundiéndole elementos similares al algoritmo FedOpt. DiLoCo incorpora estratégicamente a AdamW como optimizador interno y aprovecha Nesterov Momentum como optimizador externo, creando una fusión ingeniosa que aborda los desafíos arraigados en los paradigmas de entrenamiento convencionales.

La brillantez de DiLoCo reside en sus tres pilares fundamentales:

1. Requisitos limitados de coubicación: cada trabajador necesita dispositivos coubicados, pero el número total requerido es notablemente menor, lo que alivia las complejidades logísticas.

2. Frecuencia de comunicación reducida: los trabajadores ya no necesitan comunicarse en cada paso, sino que sincronizan solo en intervalos de 𝐻 pasos, lo que reduce significativamente los gastos generales de comunicación a solo cientos o incluso miles.

3. Heterogeneidad de dispositivos: si bien los dispositivos dentro de un clúster deben ser homogéneos, DiLoCo permite que diferentes clústeres funcionen utilizando diversos tipos de dispositivos, ofreciendo una flexibilidad incomparable.

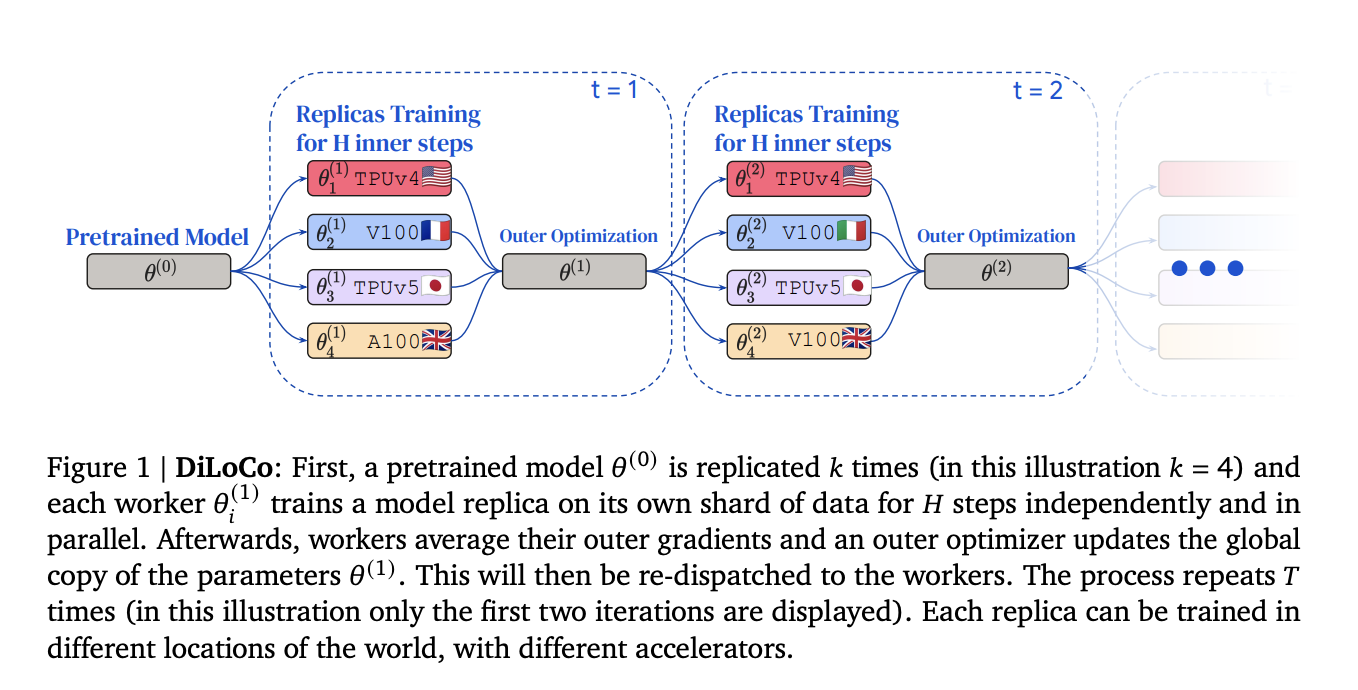

El proceso de formación de DiLoCo implica replicar un modelo previamente entrenado 𝜃 (0) varias veces. Cada trabajador entrena de forma independiente una réplica del modelo en su fragmento de datos individual durante 𝐻 pasos. Posteriormente, los trabajadores promedian sus gradientes externos y un optimizador externo actualiza la copia del parámetro global 𝜃 (1), que se distribuye a los trabajadores. Este proceso cíclico se repite 𝑇 veces, lo que permite el entrenamiento de cada réplica en distintas ubicaciones globales utilizando varios aceleradores.

En experimentos prácticos con el conjunto de datos C4, DiLoCo, que emplea a ocho trabajadores, logra un rendimiento a la par con una optimización totalmente sincrónica y, al mismo tiempo, reduce la comunicación en una asombrosa cifra de 500 veces. Además, DiLoCo demuestra una resiliencia excepcional a las variaciones en la distribución de datos entre los trabajadores y se adapta perfectamente a la disponibilidad cambiante de recursos durante la capacitación.

En esencia, DiLoCo surge como una solución robusta y transformadora para distribuir el entrenamiento de modelos de lenguaje transformador entre múltiples máquinas mal conectadas. Este enfoque innovador no solo supera los desafíos de la infraestructura, sino que también muestra un rendimiento y una adaptabilidad incomparables, lo que presagia un importante avance en la optimización del modelo de lenguaje.

Niharika es pasante de consultoría técnica en Marktechpost. Es estudiante de tercer año y actualmente cursa su licenciatura en tecnología en el Instituto Indio de Tecnología (IIT), Kharagpur. Es una persona muy entusiasta con un gran interés en el aprendizaje automático, la ciencia de datos y la inteligencia artificial y una ávida lectora de los últimos avances en estos campos.