La perfecta integración de la visión y el lenguaje ha sido un punto focal de los avances recientes en IA. El campo ha experimentado un progreso significativo con la llegada de los LLM. Sin embargo, el desarrollo de modelos básicos de visión y visión-lenguaje esenciales para los sistemas AGI multimodales aún debe ponerse al día. Esta brecha ha llevado a la creación de un modelo innovador propuesto por investigadores de la Universidad de Nanjing, OpenGVLab, el Laboratorio de IA de Shanghai, la Universidad de Hong Kong, la Universidad China de Hong Kong, la Universidad de Tsinghua, la Universidad de Ciencia y Tecnología de China y SenseTime Research. como InternVL, que amplía los modelos básicos de la visión y los alinea para tareas lingüísticas visuales genéricas.

InternVL aborda un tema crítico en el ámbito de la inteligencia artificial: la disparidad en el ritmo de desarrollo entre los modelos de visión básica y los LLM. Los modelos existentes a menudo utilizan capas de pegamento básicas para alinear las características de visión y lenguaje, lo que resulta en una falta de coincidencia en las escalas de parámetros y la coherencia de la representación. Esta insuficiencia puede obstaculizar el pleno potencial de los LLM.

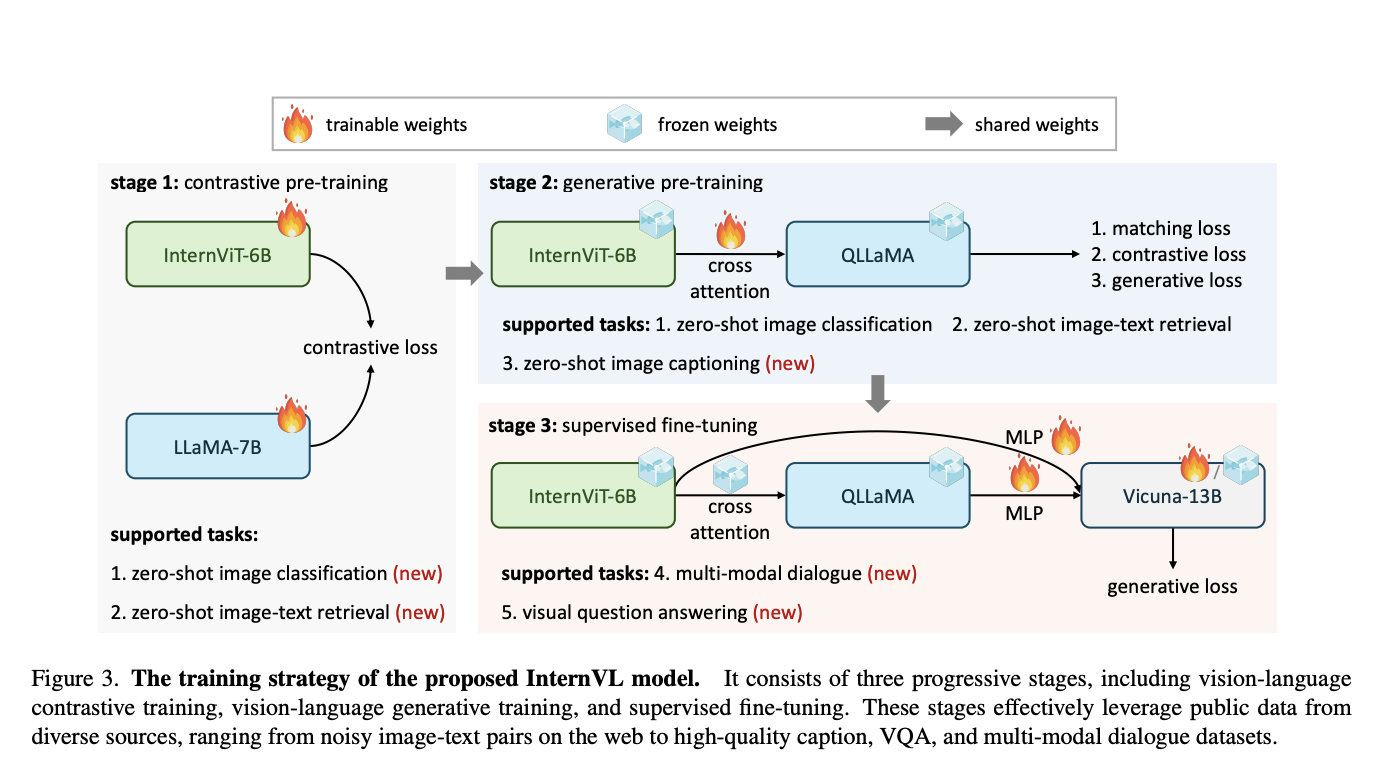

La metodología detrás de InternVL es única y sólida. El modelo emplea un codificador de visión a gran escala, InternViT-6B, y un middleware de lenguaje, QLLaMA, con 8 mil millones de parámetros. Esta estructura tiene un doble propósito: funciona como un codificador de visión independiente para tareas de percepción. Colabora con el middleware lingüístico para tareas complejas de visión y lenguaje y sistemas de diálogo multimodal. El entrenamiento del modelo implica una estrategia de alineación progresiva, comenzando con el aprendizaje contrastivo sobre datos extensos de imágenes y texto ruidosos y luego pasando al aprendizaje generativo con datos más refinados. Este enfoque progresivo mejora constantemente el rendimiento del modelo en diversas tareas.

InternVL demuestra su destreza superando a los métodos existentes en 32 puntos de referencia genéricos de lingüística visual, un testimonio de sus sólidas capacidades visuales. El modelo sobresale en diversas tareas como clasificación de imágenes y videos, recuperación de textos de imágenes y videos, subtítulos de imágenes, respuesta visible a preguntas y diálogo multimodal. Esta diversa gama de capacidades se atribuye al espacio de funciones alineado con los LLM, lo que permite que el modelo maneje tareas complejas con notable eficiencia y precisión.

Los aspectos clave del desempeño de InternVL incluyen:

- El modelo es versátil como codificador de visión independiente o combinado con el middleware de lenguaje para diversas tareas.

- InternVL supera esto de manera innovadora al escalar el modelo de base de visión a unos notables 6 mil millones de parámetros, lo que facilita una integración más completa y efectiva con los LLM.

- Su capacidad para lograr un rendimiento de vanguardia en 32 puntos de referencia visual-lingüísticos genéricos destaca sus capacidades visuales avanzadas.

- Rendimiento efectivo en clasificación de imágenes y videos, recuperación de textos de imágenes y videos, subtítulos de imágenes, respuesta visual a preguntas y diálogo multimodal.

- El espacio de funciones alineado con los LLM mejora su capacidad para integrarse perfectamente con los modelos de lenguaje existentes, ampliando aún más su alcance de aplicación.

En conclusión, la investigación realizada se puede presentar resumidamente en los siguientes puntos:

- InternVL representa un gran salto en los sistemas AGI multimodales, cerrando una brecha crucial en el desarrollo de modelos básicos de visión y lenguaje de visión.

- Su innovadora estrategia de escalado y alineación le otorga versatilidad y potencia, lo que permite un rendimiento superior en diversas tareas visual-lingüísticas.

- Esta investigación contribuye al avance de grandes modelos multimodales, lo que podría remodelar el panorama futuro de la IA y el aprendizaje automático.

Revisar la Papel y GitHub. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de más de 35.000 ml, 41k+ comunidad de Facebook, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

Hola, mi nombre es Adnan Hassan. Soy pasante de consultoría en Marktechpost y pronto seré aprendiz de gestión en American Express. Actualmente estoy cursando una doble titulación en el Instituto Indio de Tecnología, Kharagpur. Me apasiona la tecnología y quiero crear nuevos productos que marquen la diferencia.