La aparición de modelos de lenguaje grandes (LLM) ha inspirado varios usos, incluido el desarrollo de chatbots como ChatGPT, asistentes de correo electrónico y herramientas de codificación. Se ha trabajado mucho para mejorar la eficiencia de estos modelos para su implementación a gran escala. Esto ha facilitado que ChatGPT atienda a más de 100 millones de usuarios activos semanalmente. Sin embargo, hay que tener en cuenta que la generación de texto representa sólo una fracción de las posibilidades de estos modelos.

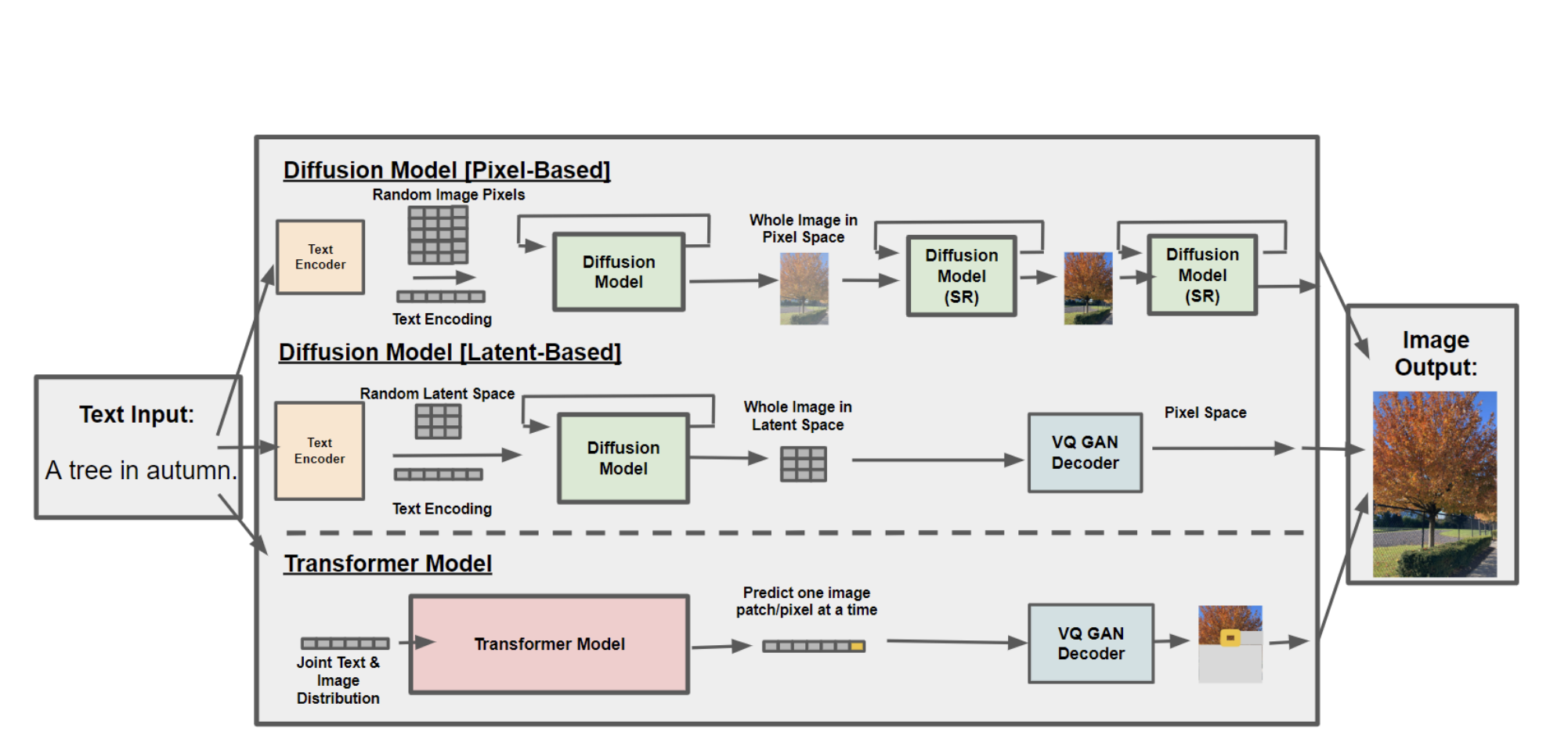

Las características únicas de los modelos Texto a imagen (TTI) y Texto a vídeo (TTV) implican que estas tareas en evolución experimentan diferentes ventajas. En consecuencia, es necesario un examen exhaustivo para identificar áreas para optimizar las operaciones de TTI/TTV. A pesar de los notables avances algorítmicos en los modelos de generación de imágenes y videos en los últimos años, ha habido un esfuerzo comparativamente limitado para optimizar la implementación de estos modelos desde el punto de vista de los sistemas.

Investigadores de la Universidad de Harvard y Meta adoptan un enfoque cuantitativo para delinear el panorama actual de los modelos de texto a imagen (TTI) y texto a video (TTV) examinando varias dimensiones del diseño, incluida la latencia y la intensidad computacional. Para lograr esto, crean un conjunto que comprende ocho tareas representativas para la generación de texto a imagen y video, comparándolas con modelos de lenguaje ampliamente utilizados como LLaMA.

Encuentran distinciones notables, lo que demuestra que surgen nuevas limitaciones de rendimiento del sistema incluso con optimizaciones de rendimiento de última generación como Flash Attention. Por ejemplo, la convolución representa hasta el 44 % del tiempo de ejecución en los modelos TTI basados en difusión, mientras que las capas lineales consumen hasta el 49 % del tiempo de ejecución en los modelos TTI basados en transformadores.

Además, encuentran que el cuello de botella relacionado con la atención temporal aumenta exponencialmente con el aumento de fotogramas. Esta observación subraya la necesidad de futuras optimizaciones del sistema para abordar este desafío. Desarrollan un marco analítico para modelar los requisitos cambiantes de memoria y FLOP a lo largo del avance de un modelo de difusión.

Los modelos de lenguaje grande (LLM) se definen mediante una secuencia que denota la extensión de información que el modelo puede considerar, indicando la cantidad de palabras que puede tener en cuenta al predecir la palabra siguiente. Sin embargo, en los modelos de texto a imagen (TTI) y texto a vídeo (TTV) de última generación, la longitud de la secuencia está directamente influenciada por el tamaño de la imagen que se procesa.

Realizaron un estudio de caso sobre el modelo de Difusión Estable para comprender de manera más concreta el impacto de escalar el tamaño de la imagen y demostrar la distribución de la longitud de la secuencia para la inferencia de Difusión Estable. Encuentran que después de aplicar técnicas como Flash Attention, Convolution tiene una mayor dependencia de escala con el tamaño de la imagen que Atención.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de más de 35.000 ml, 41k+ comunidad de Facebook, Canal de discordia, Grupo LinkedIny Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

Arshad es pasante en MarktechPost. Actualmente cursa su carrera internacional. Maestría en Física del Instituto Indio de Tecnología Kharagpur. Comprender las cosas hasta el nivel fundamental conduce a nuevos descubrimientos que conducen al avance de la tecnología. Le apasiona comprender la naturaleza fundamentalmente con la ayuda de herramientas como modelos matemáticos, modelos de aprendizaje automático e inteligencia artificial.