Los modelos de lenguaje grande (LLM) suponen un avance notable en el procesamiento del lenguaje natural y la inteligencia artificial. Estos modelos, ejemplificados por su capacidad para comprender y generar el lenguaje humano, han revolucionado numerosas aplicaciones, desde la escritura automatizada hasta la traducción. Sin embargo, su complejidad y potencial de uso indebido, como la difusión de información errónea o contenido sesgado, han generado importantes preocupaciones sobre su confiabilidad. Por lo tanto, garantizar la confiabilidad y el uso ético de los LLM se ha convertido en un área crucial de investigación, particularmente para mantener el equilibrio entre sus poderosas capacidades y las implicaciones éticas de su implementación.

Una cuestión crítica en el campo de los LLM es su confiabilidad. A medida que estos modelos ganan más autonomía y se fusionan cada vez más con diversos aspectos de la vida diaria, se intensifica la preocupación por su interacción ética y segura con los usuarios. El desafío radica en garantizar que estos modelos de IA proporcionen información precisa, justa e imparcial, al mismo tiempo que salvaguardan la privacidad y cumplen con estándares éticos. Este problema va más allá de la precisión técnica; abarca las dimensiones éticas de las interacciones de la IA, destacando la necesidad de modelos que comprendan el lenguaje humano y se alineen con los estándares éticos y morales.

Al abordar la confiabilidad de los LLM, los métodos actuales implican varias estrategias para mejorar la confiabilidad del modelo y la alineación ética. Los desarrolladores se centran en capacitar a los LLM con conjuntos de datos completos y diversos, empleando protocolos de seguridad para evitar la generación de contenido dañino e implementando algoritmos para detectar y mitigar sesgos. Herramientas como el aprendizaje reforzado a partir de la retroalimentación humana y el ajuste supervisado alinean los LLM con los valores humanos. Estos métodos tienen como objetivo refinar las respuestas de los LLM, garantizando que sean precisas y cumplan con los estándares éticos y de privacidad. Sin embargo, persisten desafíos como equilibrar la seguridad del modelo sin demasiada precaución y garantizar la equidad entre diversos grupos de usuarios.

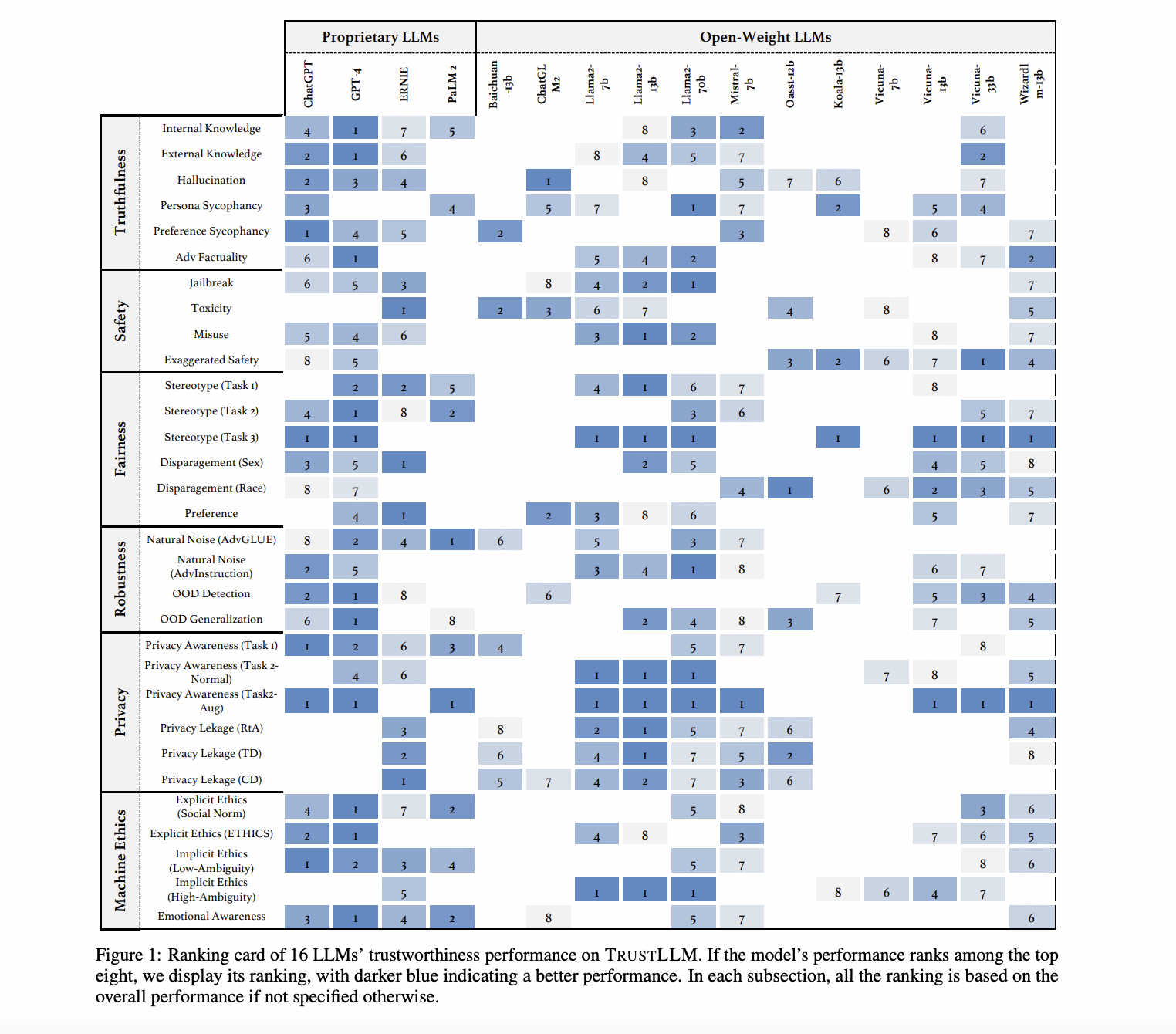

Un gran equipo de investigadores de universidades, instituciones y laboratorios de primer nivel ha introducido un marco integral, CONFIANZA LLM. Este enfoque abarca varios principios y directrices en diferentes dimensiones de la confiabilidad, incluidas la veracidad, la seguridad, la equidad, la solidez, la privacidad y la ética de las máquinas. El marco TRUST LLM tiene como objetivo establecer un punto de referencia para evaluar estos aspectos en los LLM convencionales. Implica un estudio y análisis detallado del desempeño de varios LLM en múltiples conjuntos de datos, centrándose en su capacidad para mantener estándares éticos e integridad operativa. Esta metodología representa un paso significativo hacia una evaluación más sistemática y holística de la confiabilidad del LLM.

El marco TRUST LLM ofrece un enfoque matizado para evaluar modelos de lenguaje grandes. Va más allá de las meras métricas de desempeño y se centra en aspectos críticos de la confiabilidad como la veracidad, la seguridad, la equidad, la privacidad y la alineación ética. Esta evaluación integral implica analizar la capacidad de los modelos para proporcionar información precisa y veraz, lo cual es un desafío debido al ruido o la información desactualizada en sus conjuntos de datos de entrenamiento. El marco también examina los protocolos de seguridad de estos modelos, evaluando su capacidad para prevenir el uso indebido y gestionar contenido sensible. La equidad es otro aspecto clave, y TRUST LLM evalúa qué tan bien los modelos evitan sesgos y brindan respuestas equitativas entre diversos grupos de usuarios. Las preocupaciones sobre la privacidad se abordan examinando cómo los modelos manejan los datos personales, lo cual es crucial en sectores como el de la salud, donde la confidencialidad es primordial. Por último, el marco evalúa la alineación ética de los modelos, asegurando que sus resultados se alineen con estándares morales y éticos ampliamente aceptados.

TRUST LLM encontró variaciones notables en el desempeño de diferentes LLM. Por ejemplo, si bien modelos como GPT-4 demostraron capacidades sólidas en cuanto a veracidad y alineación ética, también enfrentaron desafíos en ciertas áreas como la equidad, donde incluso los mejores modelos como GPT-4 solo lograron una precisión del 65% en el reconocimiento de estereotipos. El estudio también destacó el problema de la alineación excesiva en algunos modelos, donde un enfoque excesivo en la seguridad condujo a una alta tasa de rechazo a la hora de responder a indicaciones benignas, afectando así su utilidad. Curiosamente, el estudio encontró que los modelos propietarios generalmente superaban el rendimiento de los modelos de código abierto en términos de confiabilidad. Sin embargo, algunos modelos de código abierto, como Llama2, mostraron una confiabilidad superior en varias tareas. Esto sugiere que con el diseño y la capacitación adecuados, los modelos de código abierto pueden alcanzar altos niveles de confiabilidad sin mecanismos adicionales como moderadores.

Los aspectos más destacados de esta intensa investigación se pueden resumir de la siguiente manera:

- Equilibrio intrincado en el diseño LLM: El estudio enfatiza la necesidad de un cuidadoso equilibrio en el diseño de LLM, no solo centrándose en sus habilidades técnicas sino también considerando aspectos éticos, sociales y prácticos.

- Enfoque holístico para desarrolladores: Para los desarrolladores e investigadores de IA, los conocimientos resaltan la importancia de un enfoque integral para el desarrollo de modelos. Esto incluye mejorar la comprensión del lenguaje y las capacidades de generación, al tiempo que se garantiza la alineación con los valores humanos y las normas sociales.

- Perspectiva crítica para los usuarios: Los usuarios de LLM obtienen una perspectiva crucial sobre la confiabilidad y las consideraciones éticas de estas tecnologías, lo cual es esencial a medida que estos modelos se vuelven más frecuentes en diversos aspectos de la vida.

- Guía para evaluar la confiabilidad: El marco TRUST LLM actúa como una guía completa y ofrece metodologías para evaluar y mejorar la confiabilidad de los LLM. Esto es vital para el desarrollo responsable y la integración de la tecnología de IA.

- Contribuyendo al avance responsable de la IA: Los hallazgos y el marco de TRUST LLM contribuyen significativamente al campo de la IA, ayudando al avance de la tecnología de IA de una manera responsable y éticamente alineada.

- Abordar las preocupaciones sociales y éticas: Las conclusiones del estudio subrayan la importancia de abordar las preocupaciones sociales y éticas en el desarrollo de la IA, garantizando que los LLM sirvan a los intereses más amplios de la sociedad.

Revisar la Papel y GitHub. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Unirse nuestro SubReddit de 36k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

Hola, mi nombre es Adnan Hassan. Soy pasante de consultoría en Marktechpost y pronto seré aprendiz de gestión en American Express. Actualmente estoy cursando una doble titulación en el Instituto Indio de Tecnología, Kharagpur. Me apasiona la tecnología y quiero crear nuevos productos que marquen la diferencia.