Los modelos de lenguajes grandes (LLM), que son los últimos y más increíbles desarrollos en el campo de la inteligencia artificial (IA), han ganado una enorme popularidad. Debido a sus habilidades de imitación humana para responder preguntas como los humanos, completar códigos, resumir párrafos de texto largos, etc., estos modelos han utilizado en gran medida el potencial del procesamiento del lenguaje natural (PLN) y la generación del lenguaje natural (NLG).

Aunque estos modelos han demostrado capacidades impresionantes, todavía surgen desafíos cuando se trata de que estos modelos produzcan contenido objetivamente correcto y fluido. Los LLM son capaces de producir textos extremadamente realistas y cohesivos, pero a veces también tienden a producir información objetivamente falsa, es decir, alucinaciones. Estas alucinaciones pueden obstaculizar el uso práctico de estos modelos en aplicaciones del mundo real.

Estudios anteriores sobre las alucinaciones en la Generación del Lenguaje Natural se han concentrado frecuentemente en situaciones en las que un determinado texto de referencia está disponible, examinando qué tan estrechamente se adhiere el texto generado a estas referencias. Por otro lado, se han planteado cuestiones relativas a las alucinaciones que resultan de que el modelo dependa más de hechos y conocimientos generales que de un texto fuente en particular.

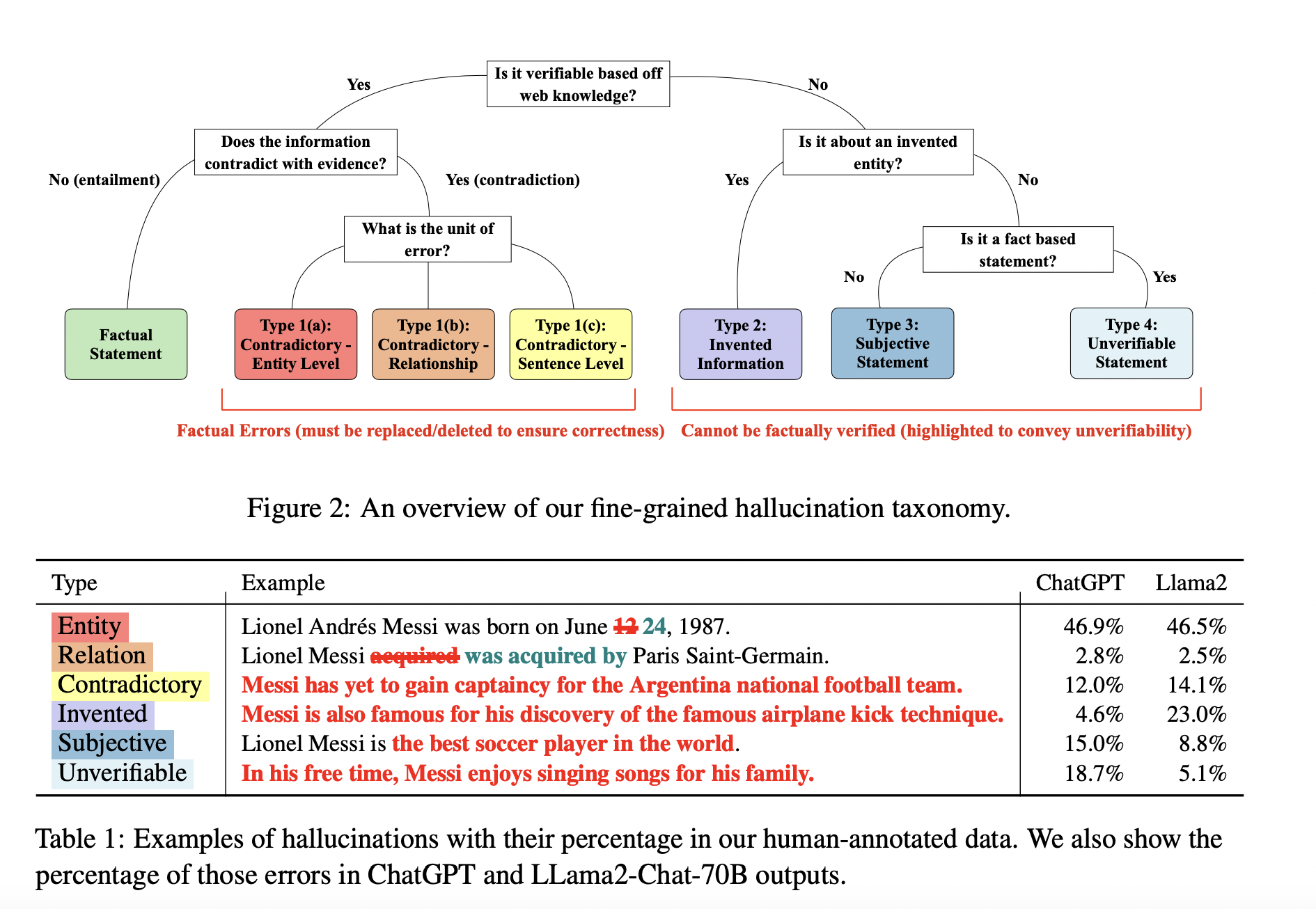

Para superar esto, un equipo de investigadores ha publicado recientemente un estudio sobre una tarea única: la detección automática de alucinaciones detalladas. El equipo ha propuesto una taxonomía integral que consta de seis formas de alucinaciones definidas jerárquicamente. Se han desarrollado sistemas automatizados para modificar o detectar alucinaciones.

Los sistemas actuales con frecuencia se centran en dominios o tipos de errores particulares, simplificando demasiado los errores fácticos en categorías binarias como fácticos o no fácticos. Es posible que esta simplificación excesiva no capte la variedad de tipos de alucinaciones, como las contradicciones a nivel de entidad y la creación de entidades que no tienen existencia en el mundo real. Para ello, el equipo ha sugerido un método más detallado de identificación de alucinaciones mediante la introducción de una nueva tarea, punto de referencia y modelo para superar estos inconvenientes.

Los objetivos son la detección precisa de secuencias de alucinaciones, la diferenciación de tipos de errores y recomendaciones para posibles mejoras. El equipo se ha centrado en las alucinaciones en contextos de búsqueda de información cuando es vital fundamentarse en el conocimiento del mundo. También han proporcionado una taxonomía única que divide los errores fácticos en seis tipos.

El equipo ha presentado un nuevo punto de referencia que incorpora juicios humanos sobre los resultados de dos modelos de lenguaje (LM), ChatGPT y Llama2-Chat 70B, en múltiples dominios para ayudar en la evaluación de la identificación detallada de alucinaciones. Según el estudio de referencia, se observó que un porcentaje considerable de los resultados de ChatGPT y Llama2-Chat, 60% y 75%, respectivamente, muestran alucinaciones.

En ChatGPT y Llama2-Chat, el punto de referencia indicó un promedio de 1,9 y 3,4 alucinaciones por respuesta. También se observó que una gran proporción de estas alucinaciones pertenecen a categorías que no han sido examinadas adecuadamente. Otros defectos además de los fallos a nivel de entidad, como conceptos inventados o palabras no verificables, estuvieron presentes en más del 60% de las alucinaciones generadas por LM.

El equipo también ha entrenado a FAVA, un LM de recuperación aumentada, como una posible solución. El procedimiento de capacitación incluyó la creación meticulosa de producción de datos sintéticos para identificar y abordar alucinaciones detalladas. Tanto las evaluaciones automatizadas como las humanas en el punto de referencia demostraron que FAVA funciona mejor que ChatGPT en términos de identificación detallada de alucinaciones. Las ediciones propuestas por FAVA mejoraron la factibilidad del texto generado por LM y detectaron alucinaciones simultáneamente, lo que produjo mejoras en FActScore entre un 5% y un 10%.

En conclusión, este estudio ha propuesto una tarea única de identificación automática de alucinaciones detallada para abordar el problema común de las alucinaciones en el texto generado por modelos de lenguaje. La exhaustiva taxonomía y los puntos de referencia del artículo han proporcionado información sobre el grado de alucinaciones en los LM populares. Se han demostrado resultados prometedores en la detección y corrección de alucinaciones de grano fino utilizando FAVA, el LM de recuperación aumentada propuesto, lo que destaca la necesidad de seguir desarrollando en esta área.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Unirse nuestro SubReddit de 36k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

Tanya Malhotra es estudiante de último año de la Universidad de Estudios de Petróleo y Energía, Dehradun, y cursa BTech en Ingeniería en Ciencias de la Computación con especialización en Inteligencia Artificial y Aprendizaje Automático.

Es una entusiasta de la Ciencia de Datos con buen pensamiento analítico y crítico, junto con un ardiente interés en adquirir nuevas habilidades, liderar grupos y gestionar el trabajo de manera organizada.