El avance más reciente en el campo de la Inteligencia Artificial (IA), es decir, los Grandes Modelos de Lenguaje (LLM), ha demostrado una gran mejora en la producción del lenguaje. Dado que los tamaños de los modelos alcanzan miles de millones de parámetros, estos modelos están entrando en todos los ámbitos, desde la atención sanitaria y las finanzas hasta la educación.

Aunque estos modelos han demostrado capacidades asombrosas, el desarrollo del tamaño del modelo ha llevado a una mayor latencia de inferencia, lo que plantea un problema para las aplicaciones del mundo real. Las operaciones vinculadas a la memoria representan el principal cuello de botella en la inferencia LLM, ya que es ineficaz transportar todos los parámetros del modelo desde la memoria de alto ancho de banda (HBM) a la caché del acelerador durante la decodificación autorregresiva.

Los investigadores se han esforzado por encontrar una solución a estas limitaciones, una de las cuales es disminuir el número de pasos de decodificación y aumentar la intensidad aritmética del proceso de decodificación. Se ha sugerido utilizar un modelo preliminar más pequeño para la decodificación especulativa, que produce una serie de tokens que luego se mejoran con el modelo original más grande. Sin embargo, existen dificultades a la hora de incorporar un modelo preliminar en un sistema distribuido.

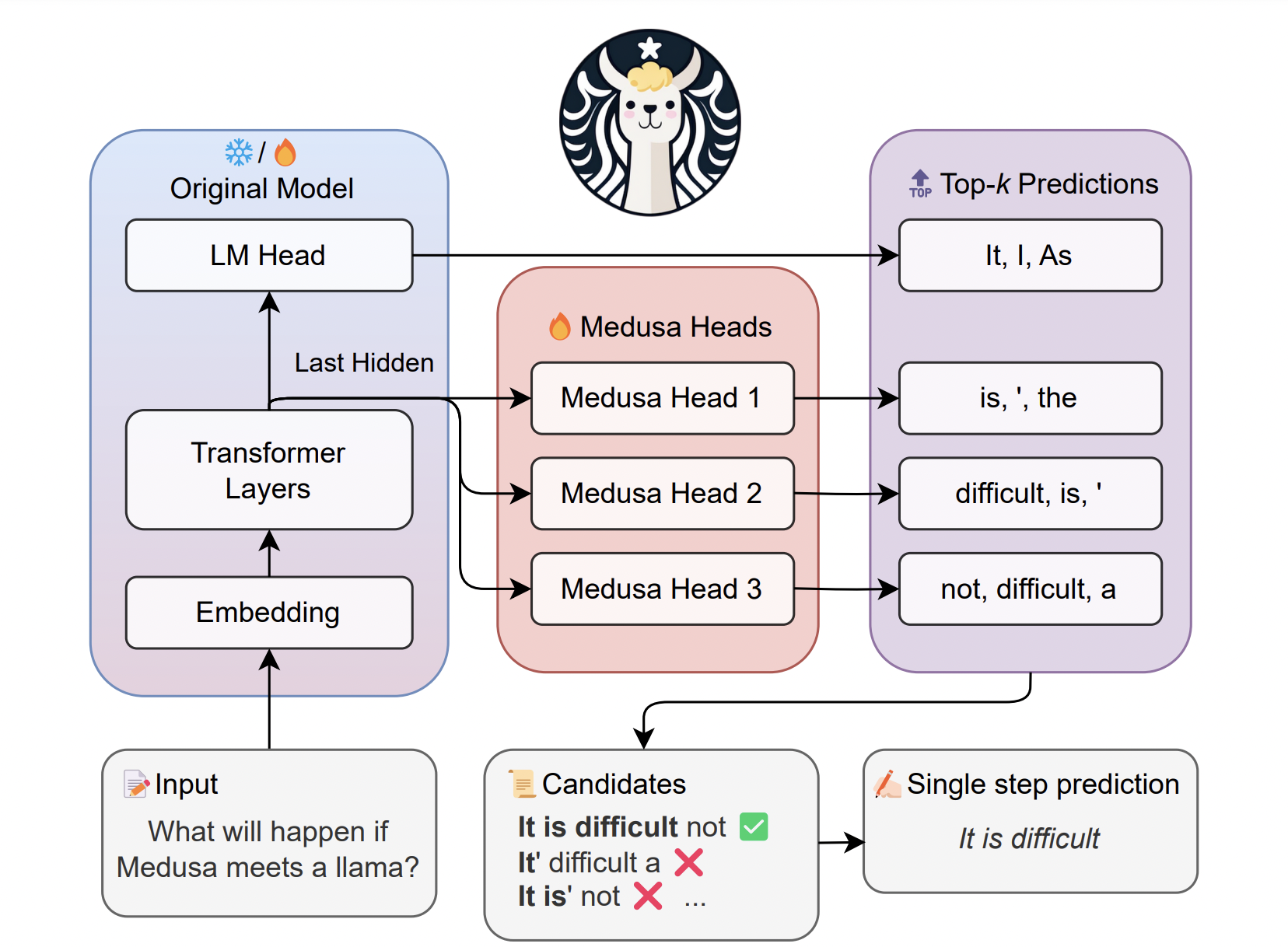

Para superar estos desafíos, un equipo de investigadores en un estudio reciente presentó MEDUSA, un enfoque eficiente que mejora la inferencia LLM al incorporar cabezales de decodificación adicionales para predecir múltiples tokens posteriores en paralelo. Utiliza los numerosos cabezales de decodificación del modelo troncal para acelerar la inferencia. Estas cabezas superan las dificultades de la decodificación especulativa al predecir simultáneamente numerosos tokens.

MEDUSA no requiere un modelo de borrador separado como lo requiere la decodificación especulativa, lo que lo hace capaz de integrarse fácilmente en los sistemas LLM actuales, incluso en situaciones dispersas. El equipo ha compartido que MEDUSA construye varias continuaciones candidatas en cada fase de decodificación y las verifica simultáneamente utilizando un mecanismo de atención basado en árboles. Al utilizar el procesamiento paralelo, MEDUSA reduce la cantidad de pasos de decodificación necesarios y al mismo tiempo introduce muy poca sobrecarga en términos de latencia de un solo paso.

Se han agregado dos nuevos conocimientos a MEDUSA. En primer lugar, se han generado numerosas continuaciones candidatas utilizando cabezales MEDUSA y se han verificado simultáneamente. En segundo lugar, se utilizó un procedimiento de aceptación para elegir a los candidatos adecuados. El equipo ha compartido la estrategia de muestreo de rechazo utilizada en la decodificación especulativa, que un umbral basado en la temperatura puede sustituir eficazmente para manejar las desviaciones.

El estudio ha sugerido dos métodos para ajustar los cabezales predictivos de MEDUSA de los LLM, que son los siguientes.

- MEDUSA-1: Esto permite una aceleración de inferencia sin pérdidas ajustando directamente MEDUSA sobre un LLM central congelado. Se ha sugerido el uso de MEDUSA-1 al incorporar MEDUSA en un modelo existente o en entornos con recursos computacionales limitados. Utiliza menos memoria y puede hacerse aún más eficiente aplicando técnicas de cuantificación.

- MEDUSA-2: Este método ajusta MEDUSA y el LLM principal simultáneamente. Si bien ofrece una mayor velocidad y una precisión de predicción mejorada para las cabezas de MEDUSA, necesita una receta de entrenamiento única para mantener la funcionalidad del modelo principal. MEDUSA-2 es apropiado cuando los recursos son abundantes y permite el entrenamiento simultáneo de los cabezales de MEDUSA y el modelo principal sin sacrificar la calidad del resultado o la capacidad de predicción del siguiente token.

La investigación también ha sugerido varias adiciones para mejorar o ampliar el uso de MEDUSA. Estos incluyen un esquema de aceptación habitual para aumentar la tasa de aceptación sin sacrificar la calidad de la generación y un método de autodestilación en ausencia de datos de entrenamiento. El equipo ha compartido que el proceso de evaluación de MEDUSA incluyó pruebas en modelos de diferentes tamaños y protocolos de entrenamiento. Los resultados han demostrado que MEDUSA-1 puede acelerar los datos más de 2,2 veces sin sacrificar la calidad de generación. Además, la aceleración se mejora a 2,3-3,6× usando MEDUSA-2.

Revisar la Papel y GitHub. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Unirse nuestro SubReddit de 36k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

Tanya Malhotra es estudiante de último año de la Universidad de Estudios de Petróleo y Energía, Dehradun, y cursa BTech en Ingeniería en Ciencias de la Computación con especialización en Inteligencia Artificial y Aprendizaje Automático.

Es una entusiasta de la Ciencia de Datos con buen pensamiento analítico y crítico, junto con un ardiente interés en adquirir nuevas habilidades, liderar grupos y gestionar el trabajo de manera organizada.