Los transformadores han encontrado una aplicación generalizada en diversas tareas que abarcan la clasificación de texto, la construcción de mapas, la detección de objetos, el análisis de nubes de puntos y el reconocimiento de espectrogramas de audio. Su versatilidad se extiende a tareas multimodales, ejemplificada por el uso que hace CLIP de pares imagen-texto para un reconocimiento superior de imágenes. Esto subraya la eficacia de los transformadores para establecer modelos universales de secuencia a secuencia, creando incorporaciones que unifican la representación de datos en múltiples modalidades.

CLIP ilustra una metodología notable, que aprovecha datos de una modalidad (texto) para mejorar el rendimiento de un modelo en otra (imágenes). Sin embargo, el requisito de muestras de datos pareados relevantes es una limitación importante que a menudo se pasa por alto en la investigación. Por ejemplo, si bien el entrenamiento con pares de imagen y audio podría mejorar el reconocimiento de imágenes, aún está por determinar la eficacia de un conjunto de datos de audio puro para mejorar la clasificación de ImageNet sin conexiones significativas entre muestras de audio e imágenes.

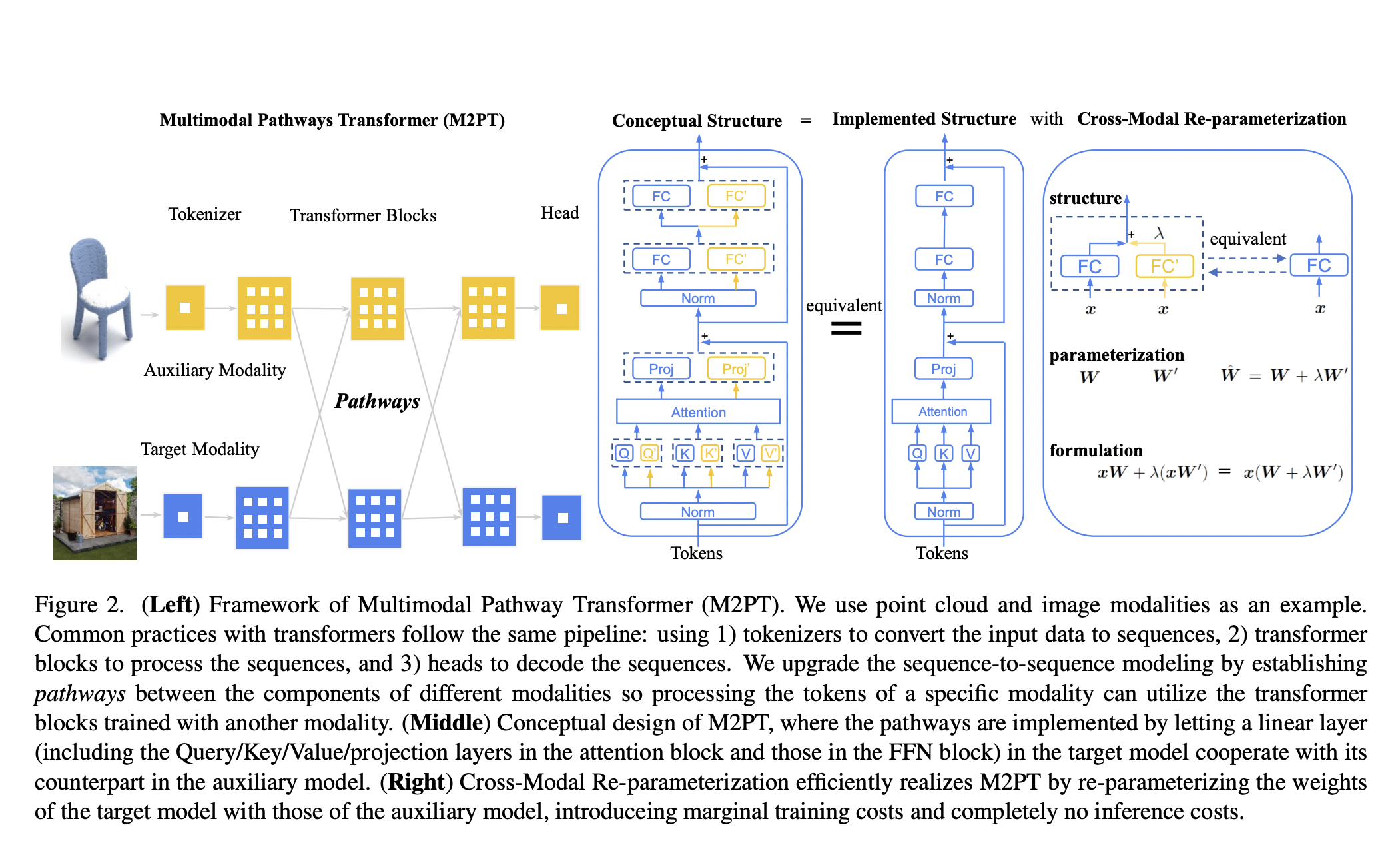

Investigadores de la Universidad China de Hong Kong y Tencent AI Lab han propuesto la Transformador de vía multimodal (M2PT). Los investigadores buscan mejorar los transformadores diseñados para modalidades específicas, como ImageNet, incorporando datos irrelevantes de modalidades no relacionadas como audio o conjuntos de datos de nubes de puntos. Este enfoque se distingue de otros que se basan en datos emparejados o entrelazados de diferentes modalidades. El objetivo es demostrar una mejora en el rendimiento del modelo conectando transformadores de modalidades dispares, donde las muestras de datos de la modalidad objetivo son intencionalmente irrelevantes para las de las modalidades auxiliares.

M2PT conecta componentes de un modelo de modalidad objetivo con un modelo auxiliar a través de vías. Esto permite el procesamiento de datos de modalidad objetivo mediante ambos modelos, utilizando las capacidades universales de modelado secuencia a secuencia del transformador desde dos modalidades. El enfoque implica un tokenizador específico de la modalidad y un cabezal específico de la tarea, e incorpora bloques transformadores de modelo auxiliar que utilizan la reparametrización entre módulos, lo que permite la explotación de pesos adicionales sin costos de inferencia. Al incorporar datos irrelevantes de otras modalidades, su método demuestra mejoras de rendimiento sustanciales y consistentes en tareas de reconocimiento de imágenes, nubes de puntos, video y audio.

Los investigadores presentan hallazgos experimentales en reconocimiento de imágenes, empleando la arquitectura ViT-B en todos los modelos. M2PT-Video, M2PT-Audio y M2PT-Point se comparan con SemMAE, MFF y MAE. Los resultados en ImageNet, MS COCO y ADE20K demuestran mejoras en la precisión y el rendimiento de las tareas. M2PT-Point sobresale notablemente, mostrando mejoras sustanciales en las métricas de APbox, APmask y mIOU en comparación con los modelos de referencia.

En conclusión, el artículo presenta la Vía multimodal mejorar el rendimiento del transformador en una modalidad específica mediante la incorporación de datos irrelevantes de otras modalidades. Los investigadores presentan la reparametrización intermodal como una implementación tangible que permite la utilización de pesos auxiliares sin incurrir en costos de inferencia. Los resultados experimentales muestran consistentemente mejoras sustanciales en el rendimiento en tareas de reconocimiento de imágenes, nubes de puntos, video y audio, enfatizando la eficacia de aprovechar datos irrelevantes de diversas modalidades en modelos basados en transformadores.

Revisar la Papel y GitHub. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Unirse nuestro SubReddit de 36k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

Asjad es consultor interno en Marktechpost. Está cursando B.Tech en ingeniería mecánica en el Instituto Indio de Tecnología, Kharagpur. Asjad es un entusiasta del aprendizaje automático y el aprendizaje profundo que siempre está investigando las aplicaciones del aprendizaje automático en la atención médica.