La IA generativa ha experimentado recientemente un auge, y los modelos de lenguajes grandes (LLM) muestran una amplia aplicabilidad en muchos campos. Estos modelos han mejorado el rendimiento de numerosas herramientas, incluidas aquellas que facilitan interacciones basadas en búsquedas, síntesis de programas, chat y muchas más. Además, los métodos basados en el lenguaje han facilitado la vinculación de muchas modalidades, lo que ha dado lugar a varias transformaciones, como texto a código, texto a 3D, texto a audio, texto a imagen y vídeo. . Estos usos sólo comienzan a ilustrar el impacto de gran alcance de las interacciones basadas en el lenguaje en el futuro de la interacción entre humanos y computadoras.

Para abordar la desalineación de valores y abrir nuevas posibilidades para las interacciones entre cadenas, árboles y gráficos de pensamientos, el ajuste fino de los LLM basado en instrucciones a través del aprendizaje reforzado a partir de la retroalimentación humana o la optimización directa de las preferencias ha mostrado resultados alentadores. A pesar de su fortaleza en la competencia lingüística formal, una nueva investigación muestra que los LLM no son muy buenos en la competencia lingüística funcional.

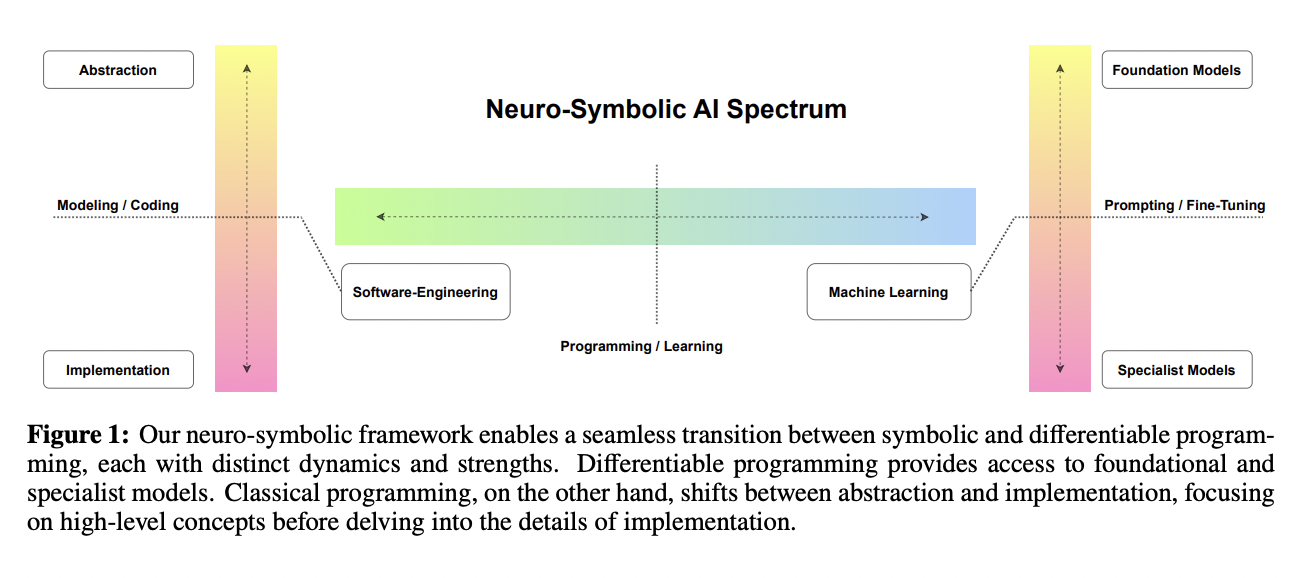

Investigadores de la Universidad Johannes Kepler y la Academia de Ciencias de Austria presentan SymbolicAI, un marco compositivo neurosimbólico (NeSy) que puede representar y manipular estructuras compositivas, multimodales y autorreferenciales. A través del aprendizaje en contexto, SymbolicAI mejora el proceso creativo de los LLM con operaciones de aprendizaje funcionales de cero y pocas oportunidades, allanando el camino para el desarrollo de aplicaciones flexibles. Estos pasos dirigen el proceso de generación y permiten una arquitectura modular con muchos tipos diferentes de solucionadores. Estos incluyen motores que evalúan expresiones matemáticas usando lenguaje formal, motores que prueban teoremas, bases de datos que almacenan conocimiento y motores de búsqueda que recuperan información.

Los investigadores se propusieron diseñar solucionadores de problemas invariantes de dominio y revelaron que estos solucionadores son bloques de construcción para crear funciones de composición como gráficos computacionales. También ayuda a desarrollar un conjunto de herramientas extensible que combina paradigmas de programación clásicos y diferenciables. Para la arquitectura de SymbolicAI se inspiraron en trabajos anteriores sobre arquitecturas cognitivas, el impacto del lenguaje en la formación de mapas semánticos en el cerebro y la evidencia de que el cerebro humano tiene un módulo de procesamiento selectivo del lenguaje. Ven el lenguaje como un módulo de procesamiento central que define una base para los sistemas generales de IA, separado de otros procesos cognitivos como el pensamiento o la memoria.

Finalmente, abordan la evaluación de procesos de generación de NeSy de varios pasos mediante la introducción de un punto de referencia, derivando una medida de calidad y calculando su puntuación empírica, todo ello en conjunto con el marco. Utilizando LLM de vanguardia como backends del motor NeSy, evalúan y discuten empíricamente posibles áreas de aplicación. Su evaluación se centra en la familia de modelos GPT, específicamente GPT-3.5 Turbo y GPT-4 Turbo porque son los modelos más efectivos hasta el momento; Gemini-Pro porque es el modelo de mejor rendimiento disponible a través de la API de Google; LlaMA 2 13B porque proporciona una base sólida para los LLM de código abierto de Meta; y Mistral 7B y Zephyr 7B, como buenos puntos de partida para los contendientes de código abierto revisados y afinados, respectivamente. Para evaluar las capacidades lógicas de los modelos, definen formas de expresiones lógicas en lenguaje natural y matemático y analizan qué tan bien los modelos pueden traducir y evaluar afirmaciones lógicas en todos los dominios. Finalmente, el equipo probó qué tan bien los modelos pueden diseñar, construir, mantener y ejecutar gráficos computacionales jerárquicos.

SymbolicAI sienta las bases para futuros estudios en áreas como sistemas autorreferenciales, gráficos computacionales jerárquicos, síntesis de programas sofisticados y la creación de agentes autónomos mediante la integración de enfoques probabilísticos con el diseño de IA. El equipo se esfuerza por fomentar una cultura de crecimiento colaborativo e innovación a través de su compromiso con las ideas de código abierto.

Revisar la Papel y GitHub. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 36k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

Dhanshree Shenwai es ingeniero en informática y tiene una buena experiencia en empresas de tecnología financiera que cubren el ámbito financiero, tarjetas y pagos y banca con un gran interés en las aplicaciones de IA. Le entusiasma explorar nuevas tecnologías y avances en el mundo en evolución de hoy que facilita la vida de todos.