La perfecta integración de los modelos de lenguajes grandes (LLM) en el tejido de la investigación científica especializada representa un cambio fundamental en el panorama de la biología computacional, la química y más. Tradicionalmente, los LLM se destacan en tareas amplias de procesamiento del lenguaje natural, pero fallan al navegar por los complejos terrenos de dominios ricos en terminologías especializadas y formatos de datos estructurados, como secuencias de proteínas y compuestos químicos. Esta limitación limita la utilidad de los LLM en estas áreas críticas y restringe el potencial de innovaciones impulsadas por la IA que podrían revolucionar el descubrimiento y la aplicación científicos.

Para abordar este desafío, surge un marco innovador desarrollado en Microsoft Research, TAG-LLM. Está diseñado para aprovechar las capacidades generales de los LLM y al mismo tiempo adaptar sus habilidades a dominios especializados. En el corazón de TAG-LLM se encuentra un sistema de etiquetas de entrada metalingüísticas, que condicionan ingeniosamente el LLM para navegar con destreza en paisajes de dominios específicos. Estas etiquetas, conceptualizadas como vectores continuos, se agregan ingeniosamente a la capa de incrustación del modelo, lo que le permite reconocer y procesar contenido especializado con una precisión sin precedentes.

El ingenio de TAG-LLM se desarrolla a través de una metodología meticulosamente estructurada que comprende tres etapas. Inicialmente, las etiquetas de dominio se cultivan utilizando datos no supervisados, capturando la esencia del conocimiento específico del dominio. Este paso fundamental es crucial, ya que permite que el modelo se familiarice con las representaciones lingüísticas y simbólicas únicas endémicas de cada campo especializado. Posteriormente, estas etiquetas de dominio se someten a un proceso de enriquecimiento, al que se les infunde información relevante para la tarea que refina aún más su utilidad. La culminación de este proceso ve la introducción de etiquetas de funciones diseñadas para guiar al LLM a través de una gran variedad de tareas dentro de estos dominios especializados. Este enfoque tripartito aprovecha el conocimiento inherente integrado en los LLM y los dota de la flexibilidad y precisión necesarias para tareas de dominios específicos.

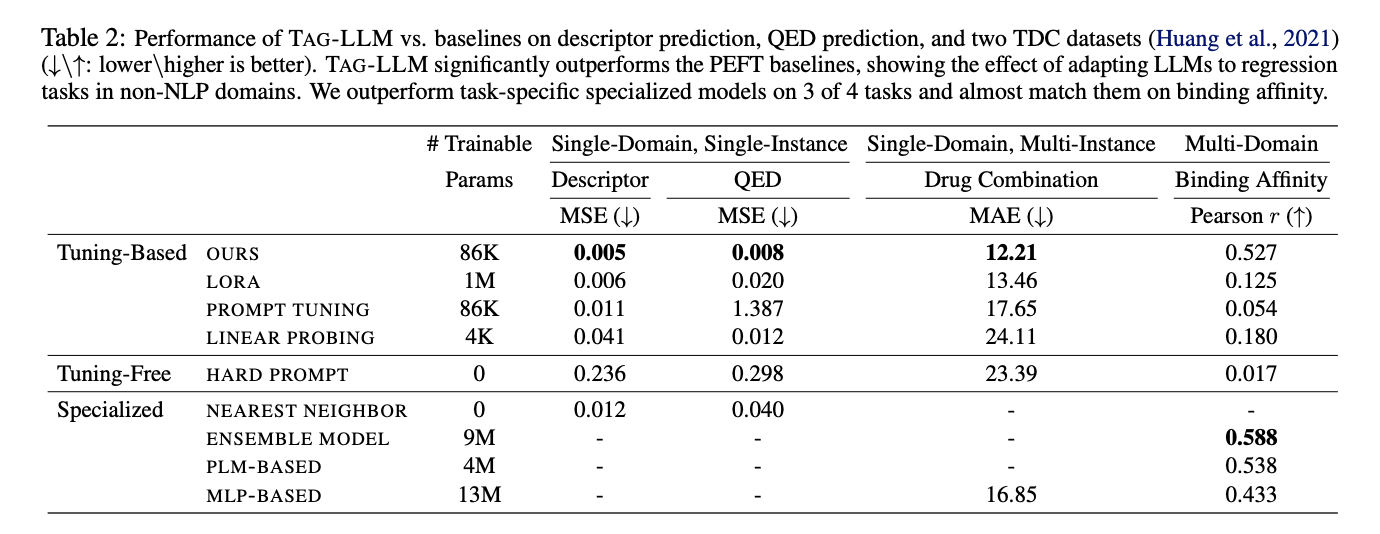

La destreza de TAG-LLM se ilustra vívidamente a través de su desempeño ejemplar en un espectro de tareas que involucran propiedades de proteínas, características de compuestos químicos e interacciones entre fármacos y objetivos. En comparación con los modelos existentes y los enfoques de ajuste, TAG-LLM demuestra una eficacia superior, subrayada por su capacidad para superar a los modelos especializados adaptados a estas tareas. Este notable logro es un testimonio de la solidez de TAG-LLM y destaca su potencial para catalizar avances significativos en la investigación y las aplicaciones científicas.

Más allá de sus aplicaciones inmediatas, las implicaciones de TAG-LLM se extienden mucho más allá de la investigación y el descubrimiento científicos. TAG-LLM abre nuevas vías para aprovechar la IA para mejorar nuestra comprensión y capacidades dentro de estos campos al cerrar la brecha entre los LLM de propósito general y los requisitos matizados de los dominios especializados. Su versatilidad y eficiencia presentan una solución convincente a los desafíos de aplicar la IA a la investigación técnica y científica, prometiendo un futuro en el que las innovaciones impulsadas por la IA estén a la vanguardia de los avances y aplicaciones científicos.

TAG-LLM es un modelo de innovación que encarna la confluencia de la IA y la investigación científica especializada. Su desarrollo aborda un desafío crítico en la aplicación de LLM a dominios técnicos y sienta las bases para una nueva era de descubrimientos científicos impulsados por la IA. El viaje de TAG-LLM desde el concepto hasta la realización subraya el potencial transformador de la IA para revolucionar nuestro enfoque de la investigación científica, presagiando un futuro en el que los límites de lo que se puede lograr a través de la ciencia impulsada por la IA se amplían continuamente.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 36k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

Muhammad Athar Ganaie, pasante de consultoría en MarktechPost, es un defensor del aprendizaje profundo eficiente, con especial atención en la capacitación dispersa. Cursando un M.Sc. en Ingeniería Eléctrica, con especialización en Ingeniería de Software, combina conocimientos técnicos avanzados con aplicaciones prácticas. Su esfuerzo actual es su tesis sobre “Mejora de la eficiencia en el aprendizaje por refuerzo profundo”, que muestra su compromiso de mejorar las capacidades de la IA. El trabajo de Athar se encuentra en la intersección “Capacitación escasa en DNN” y “Aprendizaje por refuerzo profundo”.