Los modelos basados en transformadores han transformado los campos del procesamiento del lenguaje natural (NLP) y la generación del lenguaje natural (NLG), demostrando un rendimiento excepcional en una amplia gama de aplicaciones. Los mejores ejemplos de esto son los modelos Gemini introducidos recientemente por Google y los modelos GPT de OpenAI. Varios estudios han demostrado que estos modelos funcionan bien en tareas de razonamiento matemático, síntesis de código y demostración de teoremas, pero tienen dificultades con la generalización de longitud, que es la capacidad de aplicar su conocimiento a secuencias más largas que las encontradas durante el entrenamiento.

Esta restricción plantea preguntas importantes sobre si los Transformers realmente entienden los algoritmos fundamentales de una tarea o si dependen de soluciones rápidas y memoria de nivel superficial que no funcionan para tareas más grandes y complicadas. Los investigadores han estado tratando de descubrir si los transformadores tienen un defecto de diseño incorporado que impide una generalización exitosa de la longitud.

Para superar esto, un equipo de investigadores de Google DeepMind se ha centrado en un análisis metódico de la capacidad de generalización de longitud del Transformer, con especial atención al problema de la suma decimal de N dígitos. A pesar de la relativa simplicidad del problema de la suma en comparación con el lenguaje natural, este estudio lo trata como un aprendizaje de lenguaje sintético para obtener información sobre la capacidad del Transformador para internalizar procesos básicos.

El equipo ha explorado la capacidad de generalización de longitud del modelo Transformer, concretamente mediante el uso de la suma de números enteros como lente. Los resultados han revelado una importante interdependencia: la capacidad de un Transformer para procesar secuencias más largas depende no sólo de su arquitectura y tamaño, sino también en gran medida del tipo de datos que utiliza y de la codificación de posición utilizada. El equipo ha compartido que la técnica de codificación de posición, que le da al modelo una sensación de orden de secuencia, y el formato de datos, que describe cómo se proporciona la información al modelo, son componentes cruciales para determinar si el modelo puede generalizarse o no.

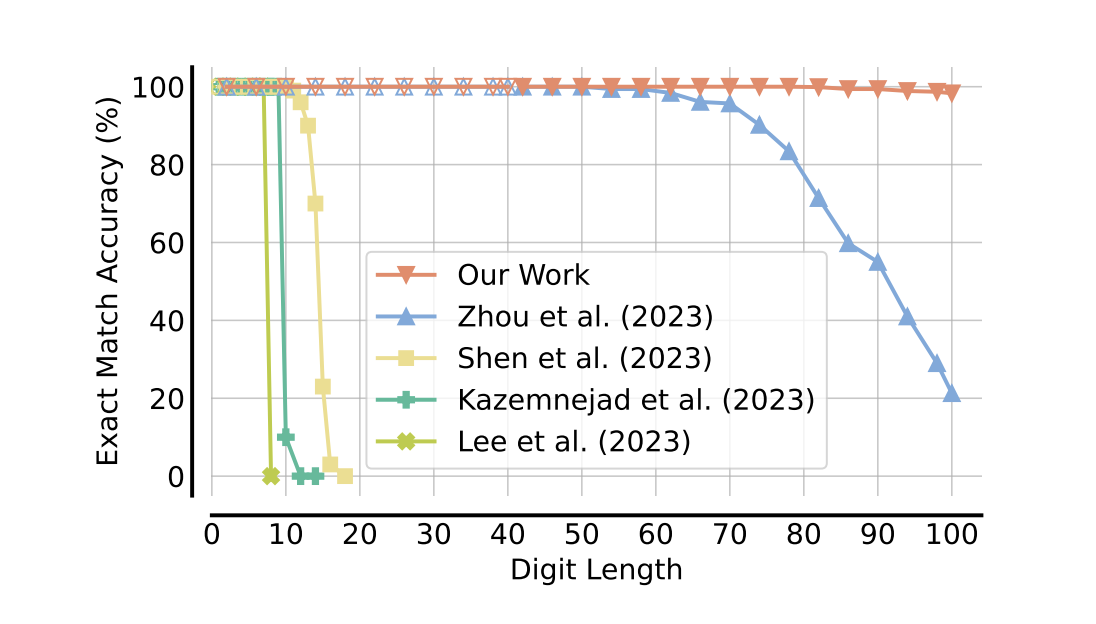

A través de experimentos que involucran diferentes combinaciones de codificaciones de posición y formatos de datos, el equipo ha encontrado configuraciones que permiten a los Transformers típicos extrapolar a secuencias 2,5 veces más largas que las encontradas durante el entrenamiento, excediendo así considerablemente sus límites de entrenamiento. Esto ha demostrado que los Transformers son capaces de manejar secuencias más largas con éxito cuando se les brinda la capacitación y las circunstancias adecuadas.

En contraste con la expectativa de que los modelos funcionen consistentemente con datos similares a su conjunto de entrenamiento en la generalización en distribución, la generalización de longitud es un logro más delicado, que enfatiza la compleja interacción entre la dinámica de entrenamiento, la presentación de datos y el diseño del modelo para lograr resultados confiables. capacidades de extrapolación.

El equipo ha resumido sus principales contribuciones de la siguiente manera.

- Se ha descubierto que la selección estratégica de la codificación de posición y el formato de datos es fundamental para lograr una generalización de longitud exitosa en modelos de lenguaje, especialmente en tareas como la suma de enteros. Las capacidades de estos modelos se han ampliado optimizando estos aspectos, permitiéndoles manejar secuencias hasta 2,5 veces más largas que aquellas en las que fueron entrenados.

- Se han estudiado varios enfoques de aumento y formato de datos y se ha descubierto que la eficacia de estos enfoques para mejorar la generalización de longitud depende en gran medida del tipo de codificación de posición que se aplica. Esto enfatiza la importancia de utilizar una estrategia coordinada al elegir la codificación de posición y el formato de datos para obtener los mejores resultados.

- Se ha descubierto que los modelos lograron una generalización notable, como extrapolar a longitudes mucho más allá de su alcance de entrenamiento; sin embargo, había una notable fragilidad en esta habilidad. El rendimiento del modelo varía mucho entre las iteraciones de entrenamiento debido a factores como la aleatorización de la inicialización del peso y el orden en que se proporcionan los datos de entrenamiento.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 38k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

También te puede gustar nuestro Cursos GRATUITOS de IA….

Tanya Malhotra es estudiante de último año de la Universidad de Estudios de Petróleo y Energía, Dehradun, y cursa BTech en Ingeniería en Ciencias de la Computación con especialización en Inteligencia Artificial y Aprendizaje Automático.

Es una entusiasta de la Ciencia de Datos con buen pensamiento analítico y crítico, junto con un ardiente interés en adquirir nuevas habilidades, liderar grupos y gestionar el trabajo de manera organizada.