En una exploración intrigante encabezada por investigadores de Google DeepMind y University College London, se han puesto bajo el microscopio las capacidades de los modelos de lenguajes grandes (LLM) para participar en razonamiento latente de múltiples saltos. Este estudio de vanguardia profundiza en si los LLM, cuando se les presentan indicaciones complejas que requieren la conexión de piezas dispares de información, pueden navegar internamente sus vastos almacenes de conocimiento implícito para generar respuestas coherentes.

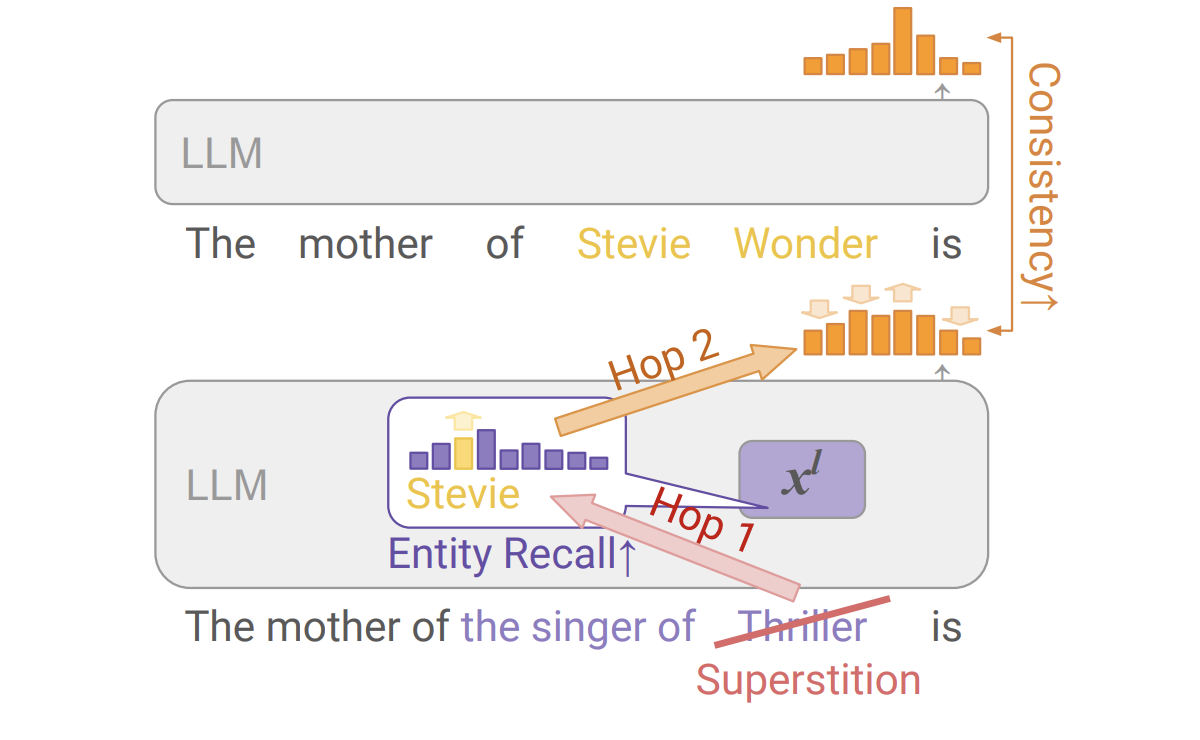

La esencia del razonamiento de saltos múltiples radica en que requiere que una entidad no solo recupere información relevante sino también la vincule secuencialmente para resolver un problema o responder una consulta. La investigación evalúa meticulosamente este proceso examinando las respuestas de los LLM a indicaciones intrincadamente diseñadas que requieren unir dos hechos separados para generar una respuesta correcta. Por ejemplo, una consulta que pregunta indirectamente por la madre de Stevie Wonder refiriéndose a ella como “el cantante de ‘Superstition’” pone a prueba la capacidad del modelo para dar los saltos lógicos necesarios.

La metodología del investigador ofrece una nueva perspectiva sobre la evaluación de las facultades de razonamiento de múltiples saltos de los LLM. Al centrarse en la competencia de los modelos para recordar y aplicar piezas específicas de información, conocidas como entidades puente, cuando se enfrentan a indicaciones indirectas, el estudio es pionero en una nueva forma de cuantificar esta capacidad de razonamiento avanzado. A través de una serie de experimentos que involucran modelos de diferentes tamaños, el artículo arroja luz sobre cómo los LLM navegan por estas complejas tareas cognitivas.

Las métricas de desempeño y los resultados revelados por esta investigación son esclarecedores e indicativos de las limitaciones actuales que enfrentan los LLM en este dominio. Se observó evidencia de razonamiento latente de múltiples saltos, aunque de manera contextualmente variable. El estudio reveló que, si bien los LLM pueden exhibir esta forma de razonamiento, su desempeño está significativamente influenciado por la estructura del mensaje y la información relacional que contiene. Un hallazgo notable de la investigación es la tendencia de escala observada con el tamaño del modelo; Los modelos más grandes demostraron capacidades mejoradas en el salto inicial de razonamiento, pero no exhibieron el mismo nivel de avance en los saltos posteriores. Específicamente, el estudio encontró evidencia sólida de una lógica latente de múltiples saltos para ciertos tipos de indicaciones, con la vía de razonamiento utilizada en más del 80% de los casos para tipos específicos de composición de hechos. Sin embargo, en promedio, la evidencia para el segundo salto y el recorrido completo de múltiples saltos fue moderada, lo que indica un área potencial para desarrollo futuro.

Esta investigación innovadora concluye con una reflexión sobre el potencial y las limitaciones de los LLM en la realización de tareas complejas de razonamiento. El equipo de Google DeepMind y UCL postula que, si bien los LLM son prometedores en el razonamiento latente de múltiples saltos, la capacidad está marcadamente influenciada por el contexto y los desafíos específicos que presentan las indicaciones. Abogan por avances en arquitecturas LLM, paradigmas de capacitación y técnicas de representación del conocimiento para mejorar aún más las capacidades de razonamiento de estos modelos. El estudio avanza nuestra comprensión de los mecanismos operativos de los LLM. Allana el camino para que futuras investigaciones desarrollen sistemas de inteligencia artificial con capacidades cognitivas sofisticadas similares al razonamiento humano y la resolución de problemas.

Al analizar meticulosamente las capacidades latentes de razonamiento de múltiples saltos de los LLM, este estudio ofrece información invaluable sobre el intrincado funcionamiento de los modelos de IA y su potencial para imitar procesos cognitivos humanos complejos. Los hallazgos subrayan la importancia de la innovación continua en la investigación de la IA, particularmente en la mejora de las capacidades de razonamiento de los LLM, para desbloquear nuevas posibilidades en las capacidades cognitivas y de resolución de problemas de la IA.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 38k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

También te puede gustar nuestro Cursos GRATUITOS de IA….

Muhammad Athar Ganaie, pasante de consultoría en MarktechPost, es un defensor del aprendizaje profundo eficiente, con especial atención en la capacitación dispersa. Cursando un M.Sc. en Ingeniería Eléctrica, con especialización en Ingeniería de Software, combina conocimientos técnicos avanzados con aplicaciones prácticas. Su esfuerzo actual es su tesis sobre “Mejora de la eficiencia en el aprendizaje por refuerzo profundo”, que muestra su compromiso de mejorar las capacidades de la IA. El trabajo de Athar se encuentra en la intersección “Capacitación escasa en DNN” y “Aprendizaje por refuerzo profundo”.