El incesante avance del progreso en inteligencia artificial está impulsado por la ambición de reflejar y ampliar las capacidades cognitivas humanas a través de la tecnología. Este viaje se caracteriza por la búsqueda de máquinas que comprendan el lenguaje, procesen imágenes e interactúen con el mundo con una comprensión casi humana.

El equipo de investigación de 01.AI ha introducido el familia modelo yi. A diferencia de sus predecesores, Yi no sólo analiza texto o imágenes de forma aislada, sino que combina estas capacidades, mostrando un nivel sin precedentes de comprensión multimodal. Al hacer esto, Yi aborda el desafío de cerrar la brecha entre el lenguaje humano y la percepción visual, lo que requiere arquitecturas de modelos innovadoras y repensar cómo se entrenan los modelos y la calidad de los datos de los que aprenden. Los modelos anteriores a menudo necesitan mejorar cuando se enfrentan a la necesidad de comprender el contexto en largos tramos de texto o derivar significado de una combinación de texto y señales visuales.

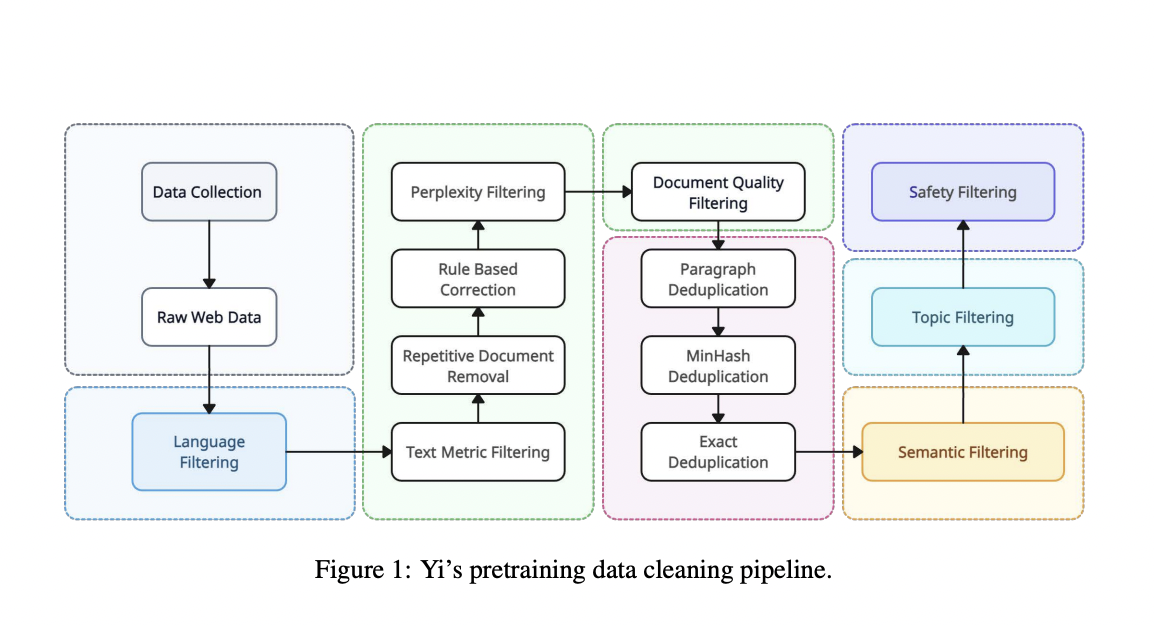

La serie de modelos incluye modelos específicos de cada idioma capaces de procesar información visual junto con texto. Estos se basan en una arquitectura de transformador evolucionada que se ha ajustado teniendo en cuenta la calidad de los datos, un factor que aumenta significativamente el rendimiento en varios puntos de referencia. La base técnica de Yi implica un enfoque en capas para construir y entrenar modelos. Comenzando con los modelos de lenguaje 6B y 34B, el equipo detrás de Yi los expandió a modelos de chat capaces de manejar contextos largos e integrar técnicas de ampliación en profundidad. Los modelos se entrenaron en un corpus enriquecido mediante un riguroso proceso de deduplicación y filtrado, garantizando que los datos que se les introducían no sólo fueran voluminosos sino también de una calidad excepcional.

El desarrollo del modelo Yi-9 B implicó una metodología de entrenamiento novedosa. Este proceso de dos etapas utilizó un conjunto de datos que comprende aproximadamente 800 mil millones de tokens, con un enfoque especial en la recopilación y selección de datos recientes para mejorar la comprensión y el rendimiento del modelo en tareas relacionadas con la codificación. Gracias a una tasa de aprendizaje constante y un aumento estratégico del tamaño del lote, el modelo demostró mejoras sustanciales en el rendimiento en varios puntos de referencia, incluidos el razonamiento, el conocimiento, la codificación y las matemáticas. Esta metodología rigurosa y las ganancias de rendimiento resultantes resaltan el potencial de la familia de modelos Yi para aplicaciones avanzadas de IA.

La serie de modelos Yi no es sólo un avance teórico sino una herramienta práctica con una amplia gama de aplicaciones. Sus principales puntos fuertes residen en el equilibrio entre la cantidad y la calidad de los datos y el proceso de ajuste estratégico. El modelo Yi-34B, por ejemplo, iguala el rendimiento del GPT-3.5 pero con la ventaja adicional de la capacidad de implementación en dispositivos de consumo, gracias a estrategias efectivas de cuantificación. Esta practicidad hace que la serie de modelos Yi sea una herramienta poderosa para diversas aplicaciones, desde el procesamiento del lenguaje natural hasta tareas de visión por computadora.

Uno de los aspectos más interesantes de la serie Yi es su capacidad en tareas de visión y lenguaje. Al combinar el modelo de lenguaje de chat con un codificador transformador de visión, Yi puede alinear las entradas visuales con la semántica lingüística. Esto le permite comprender y responder a entradas que combinan imágenes y texto. Esta capacidad abre un mundo de posibilidades para las aplicaciones de IA, desde chatbots interactivos mejorados hasta herramientas de análisis sofisticadas que pueden interpretar conjuntos de datos visuales y textuales complejos.

En conclusión, la familia de modelos Yi de 01.AI marca un importante paso adelante en el desarrollo de una IA que pueda navegar por las complejidades del lenguaje y la visión humanos. Este avance se logró a través de:

- Una sofisticada arquitectura transformadora optimizada para tareas lingüísticas y visuales.

- Un enfoque innovador para el procesamiento de datos que enfatiza la calidad de los datos utilizados para la capacitación.

- La integración exitosa de modelos de lenguaje y visión permite la comprensión de entradas multimodales.

- Ha obtenido resultados notables en los puntos de referencia estándar y en las evaluaciones de preferencias de los usuarios, lo que demuestra su potencial para diversas aplicaciones.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 38k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

También te puede gustar nuestro Cursos GRATUITOS de IA….

Hola, mi nombre es Adnan Hassan. Soy pasante de consultoría en Marktechpost y pronto seré aprendiz de gestión en American Express. Actualmente estoy cursando una doble titulación en el Instituto Indio de Tecnología, Kharagpur. Me apasiona la tecnología y quiero crear nuevos productos que marquen la diferencia.