Los modelos de gran capacidad, como los modelos de lenguajes grandes (LLM) y los modelos multimodales grandes (LMM), han demostrado eficacia en diversos dominios y tareas. Ampliar estos modelos aumentando el número de parámetros mejora el rendimiento pero reduce significativamente la velocidad de inferencia, lo que limita la practicidad. Las Sparse Mixtures of Experts (SMoE) ofrecen una alternativa prometedora, que permite la escalabilidad del modelo y al mismo tiempo mitiga los costos computacionales. Sin embargo, SMoE enfrenta dos desafíos clave: i) baja activación de expertos y ii) capacidades analíticas limitadas, que obstaculizan su efectividad y escalabilidad.

SMoE mejora la capacidad del modelo mientras mantiene una demanda computacional constante, lo que genera un rendimiento superior en comparación con los modelos densamente activados. A diferencia de los modelos densos, SMoE emplea N redes de alimentación directa (FFN) independientes como expertos dentro de cada capa de Mezcla de expertos (MoE) y una función de activación para distribuir pesos entre las salidas de estos expertos. El mecanismo de enrutamiento selecciona a los mejores k expertos de N expertos, donde k << N facilita los datos y el paralelismo de expertos. Los valores k más grandes a menudo mejoran el rendimiento del modelo, pero pueden reducir la eficiencia del entrenamiento.

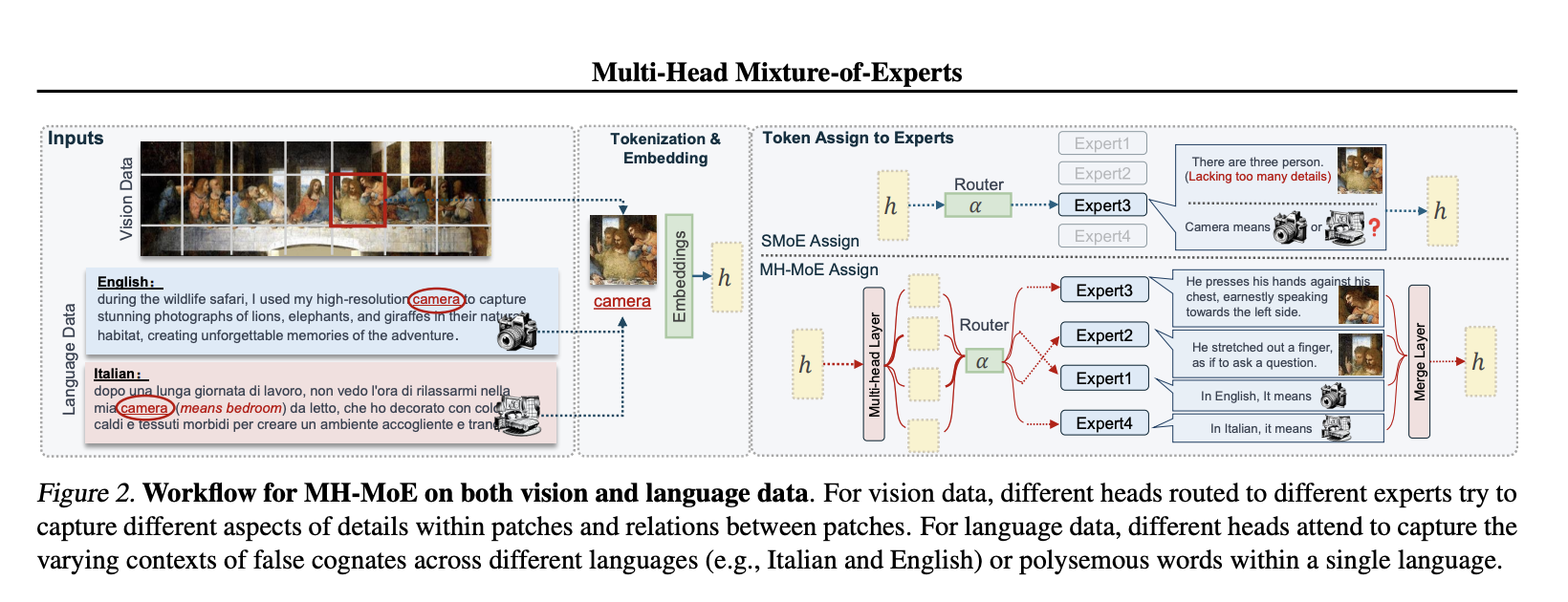

Investigadores de la Universidad de Tsinghua y Microsoft Research presentan la Mezcla de Expertos de Cabezales Múltiples (MH-MoE). MH-MoE utiliza un mecanismo de múltiples cabezales para dividir cada token de entrada en múltiples subtokens y distribuirlos entre diferentes expertos, logrando una activación de expertos más densa sin aumentar la complejidad computacional o de parámetros. A diferencia de SMoE, MH-MoE activa cuatro expertos para un único token de entrada dividiéndolo en cuatro subtokens. Esta asignación permite que el modelo se centre en varios espacios de representación dentro de los expertos, lo que facilita una comprensión más matizada de los patrones de visión y lenguaje.

La arquitectura de MH-MoE aborda los problemas de baja activación de expertos y ambigüedad de los tokens mediante el empleo de un mecanismo de múltiples cabezales para dividir los tokens en subtokens y enrutarlos a varios expertos. En MH-MoE, cada capa paralela contiene un conjunto de N expertos, con una capa de múltiples cabezales que proyecta entradas seguidas de funciones de división y activación de tokens para enrutar subtokens a expertos. El mecanismo de enrutamiento top-k activa a los expertos con las puntuaciones más altas, y estos expertos activados procesan los subtokens resultantes y los reorganizan antes de fusionarlos para mantener la coherencia de la forma de entrada y salida. La operación Token-Splitting-Merging (TSM) aumenta el volumen de datos enviados a expertos específicos, lo que da como resultado una activación de expertos más densa y una mejor comprensión. Este proceso garantiza que no haya costos computacionales adicionales en bloques posteriores, con un hiperparámetro β utilizado para equilibrar los parámetros y la complejidad computacional con el SMoE original.

Las curvas de perplejidad de validación para todos los modelos previamente entrenados y las tareas previas al entrenamiento se examinan en dos entornos de expertos (8 expertos y 32 expertos). MH-MoE mantiene consistentemente una perplejidad menor que las líneas de base en varias configuraciones experimentales, lo que indica un aprendizaje más efectivo. Además, el aumento del número de expertos se correlaciona con una disminución de la perplejidad para MH-MoE, lo que sugiere capacidades mejoradas de aprendizaje de representación. La evaluación posterior de diferentes tareas previas al entrenamiento valida aún más la eficacia de MH-MoE. En el modelado del lenguaje centrado en el inglés, MH-MoE logra el mejor rendimiento en múltiples puntos de referencia, lo que demuestra su eficacia para mejorar la representación del lenguaje. De manera similar, MH-MoE supera consistentemente a X-MoE en el modelado de lenguajes multilingües, lo que demuestra su superioridad en el modelado de lenguaje natural multilingüe. En tareas de modelado multimodal enmascarado, como respuesta visual a preguntas, razonamiento visual y subtítulos de imágenes, MH-MoE supera consistentemente las líneas base Dense y X-MoE, lo que subraya su capacidad para capturar información semántica y detallada diversa dentro de datos visuales.

En conclusión, este artículo investiga métodos para lograr una activación experta más densa sin introducir costos adicionales y al mismo tiempo mejorar la capacidad de comprensión detallada. El MH-MoE propuesto ofrece una implementación sencilla de estas funcionalidades. Además, la simplicidad de MH-MoE facilita una integración perfecta con otros marcos SMoE, lo que mejora el rendimiento fácilmente. Amplios resultados empíricos en tres tareas validan la eficacia de MH-MoE para lograr estos objetivos.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Únete a nuestro Canal de telegramas, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro SubReddit de más de 40.000 ml

Asjad es consultor interno en Marktechpost. Está cursando B.Tech en ingeniería mecánica en el Instituto Indio de Tecnología, Kharagpur. Asjad es un entusiasta del aprendizaje automático y el aprendizaje profundo que siempre está investigando las aplicaciones del aprendizaje automático en la atención médica.