RLHF es el enfoque estándar para alinear los LLM. Sin embargo, los avances recientes en los métodos de alineación fuera de línea, como la optimización de preferencias directas (DPO) y sus variantes, desafían la necesidad de un muestreo basado en políticas en RLHF. Los métodos fuera de línea, que alinean los LLM utilizando conjuntos de datos preexistentes sin interacción activa en línea, han demostrado eficiencia práctica y son más simples y económicos de implementar. Esto plantea la cuestión de si la RL en línea es esencial para la alineación de la IA. Comparar métodos en línea y fuera de línea es complejo debido a sus diferentes demandas computacionales, lo que requiere una calibración cuidadosa del presupuesto gastado para medir el desempeño de manera justa.

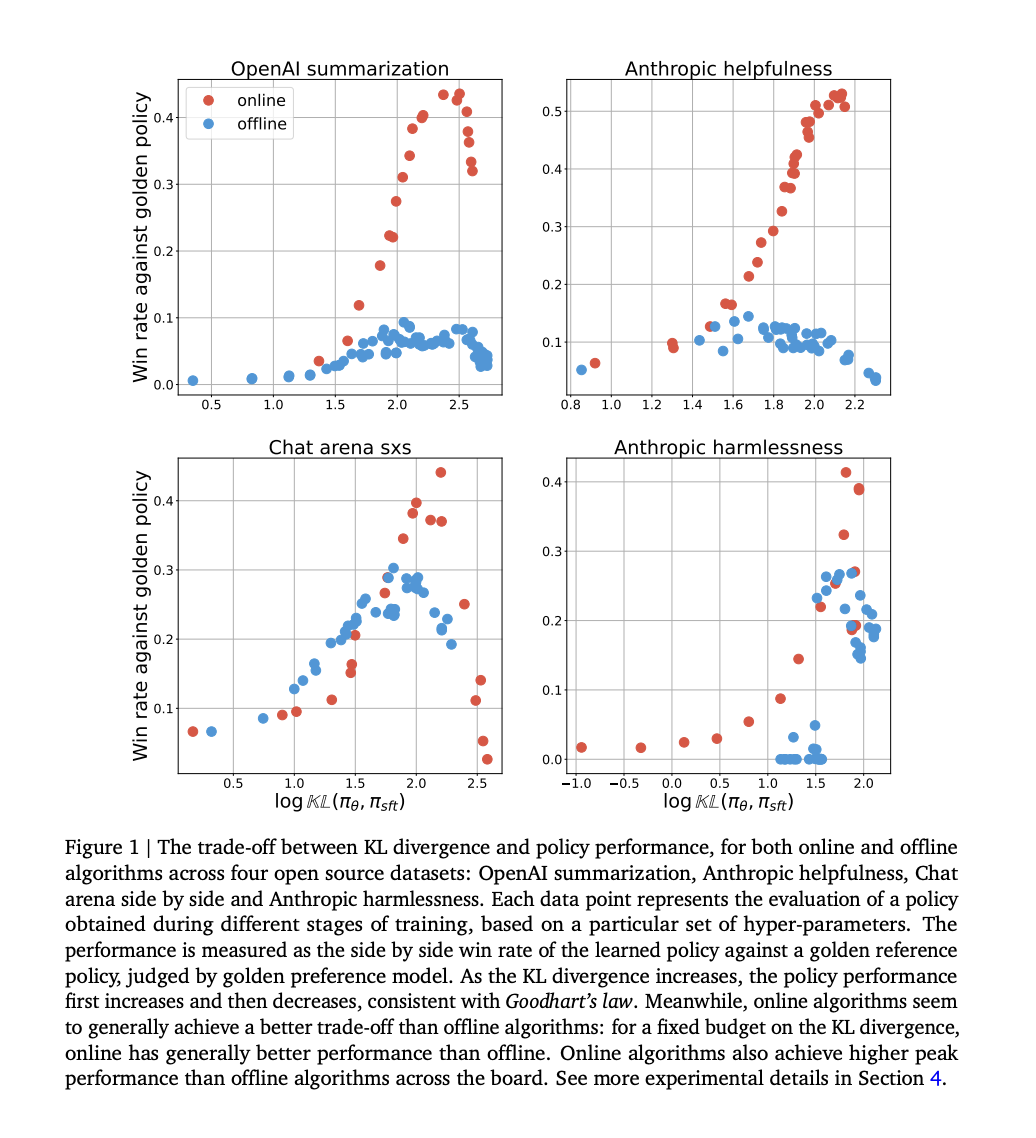

Los investigadores de Google DeepMind demostraron que los métodos en línea superan a los métodos fuera de línea en sus experimentos iniciales, lo que llevó a una mayor investigación sobre esta brecha de rendimiento. A través de experimentos controlados, descubrieron que factores como la cobertura y la calidad de los datos fuera de línea deben explicar completamente la discrepancia. A diferencia de los métodos en línea, los métodos fuera de línea destacan en la clasificación por pares, pero necesitan ayuda con la generación. La brecha persiste independientemente del tipo de función de pérdida y la escala del modelo. Esto sugiere que el muestreo dentro de las políticas es crucial para la alineación de la IA, lo que destaca los desafíos en la alineación fuera de línea. El estudio utiliza la divergencia de KL con respecto a la política supervisada y ajustada (SFT) para comparar el rendimiento entre algoritmos y presupuestos, lo que revela diferencias persistentes.

El estudio complementa el trabajo previo sobre RLHF al comparar algoritmos RLHF en línea y fuera de línea. Los investigadores identifican una brecha de rendimiento persistente entre los métodos en línea y fuera de línea, incluso cuando se utilizan diferentes funciones de pérdida y se escalan redes de políticas. Si bien estudios anteriores señalaron desafíos en el RLHF fuera de línea, sus hallazgos enfatizan que se extienden al RLHF.

El estudio compara métodos de alineación en línea y fuera de línea utilizando la pérdida de IPO en varios conjuntos de datos, examinando su desempeño según la ley de Goodhart. La pérdida de IPO implica optimizar el peso de las respuestas ganadoras sobre las perdedoras, con diferencias en los procesos de muestreo que definen los métodos en línea y fuera de línea. Los algoritmos en línea muestran respuestas sobre políticas, mientras que los algoritmos fuera de línea utilizan un conjunto de datos fijo. Los experimentos revelan que los algoritmos en línea logran mejores compensaciones entre la divergencia y el rendimiento de KL, utilizando el presupuesto de KL de manera más eficiente y logrando un rendimiento máximo más alto. Se proponen varias hipótesis para explicar estas discrepancias, como la diversidad de cobertura de datos y conjuntos de datos fuera de línea subóptimos.

La hipótesis postula que la discrepancia de rendimiento entre los algoritmos en línea y fuera de línea puede atribuirse parcialmente a la precisión de la clasificación del modelo de preferencia proxy en comparación con la política misma. En primer lugar, el modelo de preferencia proxy tiende a lograr una mayor precisión de clasificación que la política cuando se utiliza como clasificador. En segundo lugar, propone que esta diferencia en la precisión de la clasificación contribuye a la brecha de rendimiento observada entre los algoritmos en línea y fuera de línea. En esencia, sugiere que una mejor clasificación conduce a un mejor desempeño, pero esta hipótesis necesita ser examinada y validada más a fondo a través de evidencia empírica.

En conclusión, el estudio destaca el papel fundamental del muestreo dentro de las políticas para alinear eficazmente los LLM y expone los desafíos asociados con los enfoques de alineación fuera de línea. Los investigadores desacreditaron varias creencias comunes sobre la brecha de rendimiento entre los algoritmos en línea y fuera de línea mediante experimentación rigurosa y pruebas de hipótesis. Destacaron la importancia de la generación de datos sobre políticas para mejorar la eficiencia del aprendizaje de políticas. Sin embargo, también argumentan que los algoritmos fuera de línea pueden mejorar adoptando estrategias que imiten los procesos de aprendizaje en línea. Esto abre vías para una mayor exploración, como enfoques híbridos que combinen las fortalezas de los métodos en línea y fuera de línea e investigaciones teóricas más profundas sobre el aprendizaje por refuerzo para la retroalimentación humana.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Únete a nuestro Canal de telegramas, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro SubReddit de 42k+ ML

A Sana Hassan, pasante de consultoría en Marktechpost y estudiante de doble titulación en IIT Madras, le apasiona aplicar la tecnología y la inteligencia artificial para abordar los desafíos del mundo real. Con un gran interés en resolver problemas prácticos, aporta una nueva perspectiva a la intersección de la IA y las soluciones de la vida real.