Un desafío importante en el ámbito de los modelos de lenguajes grandes (LLM) es el alto costo computacional asociado con los debates entre múltiples agentes (MAD). Estos debates, en los que múltiples agentes se comunican para mejorar el razonamiento y la precisión de los hechos, a menudo implican una topología de comunicación totalmente conectada. Esto significa que cada agente hace referencia a las soluciones generadas por todos los demás agentes, lo que genera contextos de entrada ampliados y mayores demandas computacionales. Abordar este desafío es crucial para mejorar la escalabilidad y eficiencia de los sistemas de IA, haciéndolos más viables para aplicaciones y entornos en tiempo real con recursos computacionales limitados.

Los métodos actuales para el debate entre múltiples agentes implican topologías completamente conectadas donde cada agente puede acceder y hacer referencia a las soluciones generadas por todos los demás agentes. Si bien este enfoque ha mostrado mejoras en las tareas de razonamiento, es computacionalmente costoso. Se han empleado técnicas como la cadena de pensamiento (CoT) y la autoconsistencia para mejorar el desempeño de LLM al estructurar sus procesos de razonamiento. Sin embargo, estos métodos también adolecen de limitaciones, incluida una mayor complejidad y la necesidad de amplios recursos computacionales para manejar el contexto de entrada ampliado generado por múltiples agentes que se comunican ampliamente.

Los investigadores de Google DeepMind presentan un enfoque novedoso que utiliza una topología de comunicación dispersa en debates entre múltiples agentes. Al limitar la cantidad de soluciones de referencia visibles para cada agente, su objetivo es mantener o incluso mejorar el rendimiento de MAD y, al mismo tiempo, reducir significativamente los costos computacionales. Este enfoque implica la investigación sistemática y la implementación de estrategias de comunicación conectadas con vecinos, donde los agentes se comunican con un conjunto limitado de pares en lugar de con todos los agentes. Esta innovación aborda las ineficiencias computacionales de los métodos existentes al reducir el tamaño del contexto de entrada, lo que hace que el proceso de debate sea más escalable y eficiente en el uso de recursos.

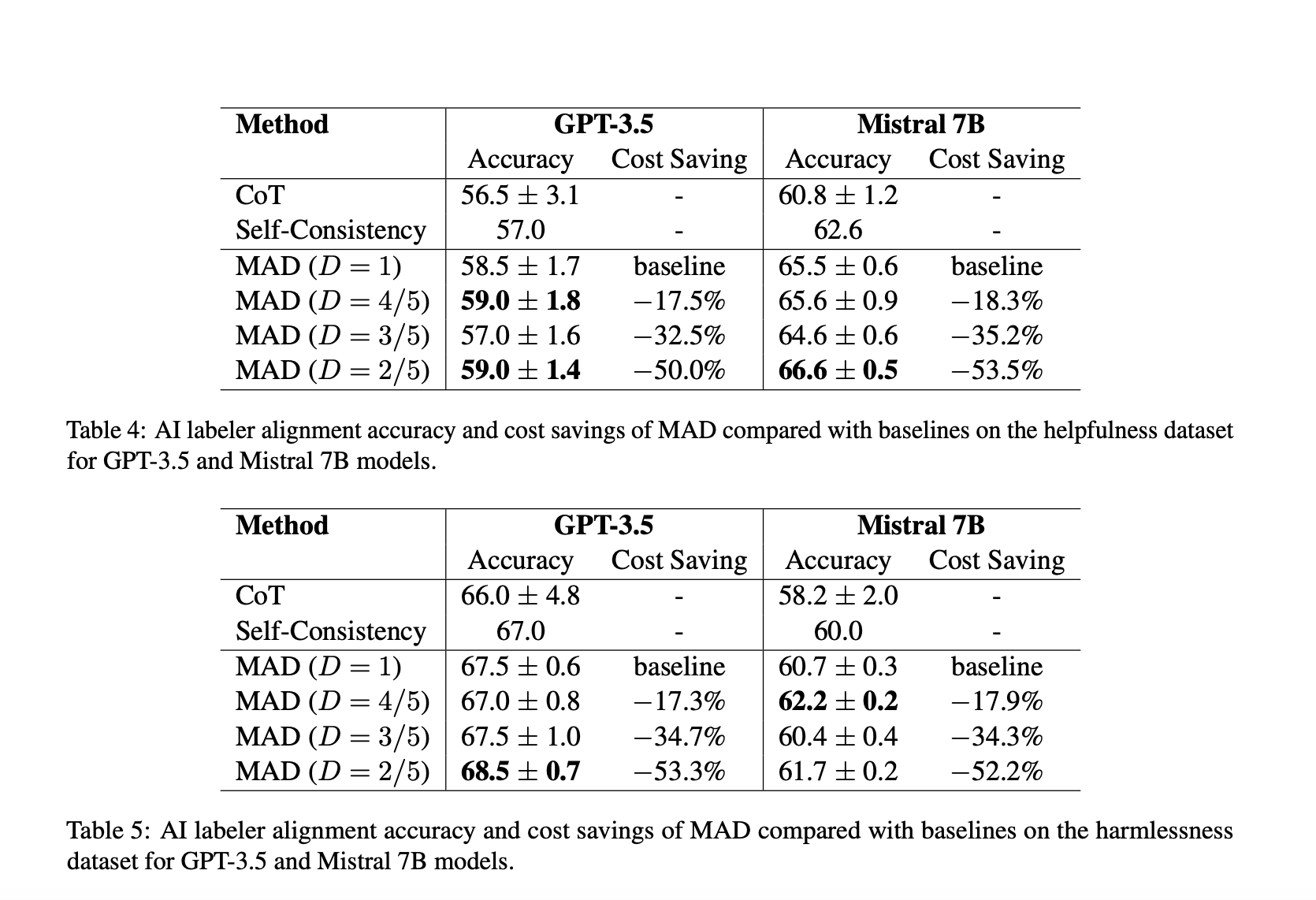

Este método innovador utiliza gráficos estáticos para representar topologías de comunicación entre agentes, cuantificadas por una relación de dispersión. En los experimentos, el enfoque se centra en configuraciones con seis agentes, examinando varios grados de dispersión. Los agentes, instanciados con modelos como GPT-3.5 y Mistral 7B, participan en múltiples rondas de debate, incorporando respuestas de sus pares conectados para refinar sus respuestas. Para las tareas de razonamiento, se utilizan conjuntos de datos como MATH y GSM8K, mientras que las tareas de etiquetado de alineación emplean el conjunto de datos Anthropic-HH. La configuración experimental incluye métricas de rendimiento como precisión y ahorro de costos, y se aplican técnicas de reducción de varianza para garantizar resultados sólidos.

El enfoque que utiliza una topología de comunicación dispersa en MAD logró mejoras notables tanto en el rendimiento como en la eficiencia computacional. En el conjunto de datos MATH, una topología conectada a un vecino mejoró la precisión en un 2 % con respecto a MAD completamente conectado, al tiempo que redujo el costo promedio del token de entrada en más de un 40 %. Para las tareas de etiquetado de alineación que utilizan el conjunto de datos Anthropic-HH, las configuraciones MAD dispersas mostraron mejoras en las métricas de utilidad e inocuidad en un 0,5% y un 1,0%, respectivamente, al tiempo que redujeron a la mitad los costos computacionales. Estos resultados demuestran que las topologías de comunicación dispersas pueden ofrecer un rendimiento comparable o superior al de topologías completamente conectadas con una sobrecarga computacional significativamente reducida.

En conclusión, esta investigación presenta un avance significativo en el campo de la IA al introducir una topología de comunicación dispersa en debates entre múltiples agentes. Este enfoque aborda eficazmente las ineficiencias computacionales de los métodos existentes, ofreciendo una solución escalable y eficiente en recursos. Los resultados experimentales resaltan el impacto potencial de esta innovación en la investigación de la IA, mostrando su capacidad para mejorar el rendimiento y al mismo tiempo reducir los costos, avanzando así en la aplicabilidad práctica de los sistemas multiagente.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo.

Únete a nuestro Canal de Telegram y LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro SubReddit de más de 45.000 ml

🚀 Cree, edite y aumente datos tabulares con el primer sistema de IA compuesto, Gretel Navigator, ¡ahora disponible de forma generalizada! [Advertisement]

Aswin AK es pasante de consultoría en MarkTechPost. Está cursando su doble titulación en el Instituto Indio de Tecnología de Kharagpur. Le apasiona la ciencia de datos y el aprendizaje automático, y aporta una sólida formación académica y experiencia práctica en la resolución de desafíos interdisciplinarios de la vida real.