Los modelos de base del lenguaje (LFM) y los modelos de lenguaje de gran tamaño (LLM) han demostrado su capacidad para gestionar múltiples tareas de manera eficiente con un único modelo fijo. Este logro ha motivado el desarrollo de los modelos de base de imágenes (IFM) en visión artificial, cuyo objetivo es codificar información general de imágenes en vectores de incrustación. Sin embargo, el uso de estas técnicas plantea un desafío en el análisis de vídeo. Un enfoque implica tratar los vídeos como una secuencia de imágenes, donde cada fotograma se muestrea y se incrusta antes de combinarlos; sin embargo, este enfoque se enfrenta a desafíos a la hora de capturar el movimiento detallado y los pequeños cambios entre fotogramas. Se vuelve difícil comprender el flujo continuo de información en los vídeos, especialmente cuando se trata de rastrear el movimiento de los objetos y las pequeñas diferencias entre fotogramas.

Los trabajos existentes intentaron superar estos desafíos utilizando dos enfoques principales basados en la arquitectura Vision Transformer (ViT). El primer enfoque utiliza la destilación con IFM de alto rendimiento como CLIP como profesores, y el segundo enfoque se basa en el modelado enmascarado, donde el modelo predice la información faltante a partir de una entrada parcial. Sin embargo, ambos enfoques tienen sus limitaciones. Los métodos basados en la destilación, como UMT e InternVideo2, tienen dificultades con los puntos de referencia sensibles al movimiento como Something-Something-v2 y Diving-48. Los métodos basados en el modelado enmascarado, como V-JEPA, tienen un mal desempeño en los puntos de referencia centrados en la apariencia como Kinetics-400 y Moments-in-Time. Estas limitaciones resaltan la dificultad de capturar la apariencia de los objetos y su movimiento en videos.

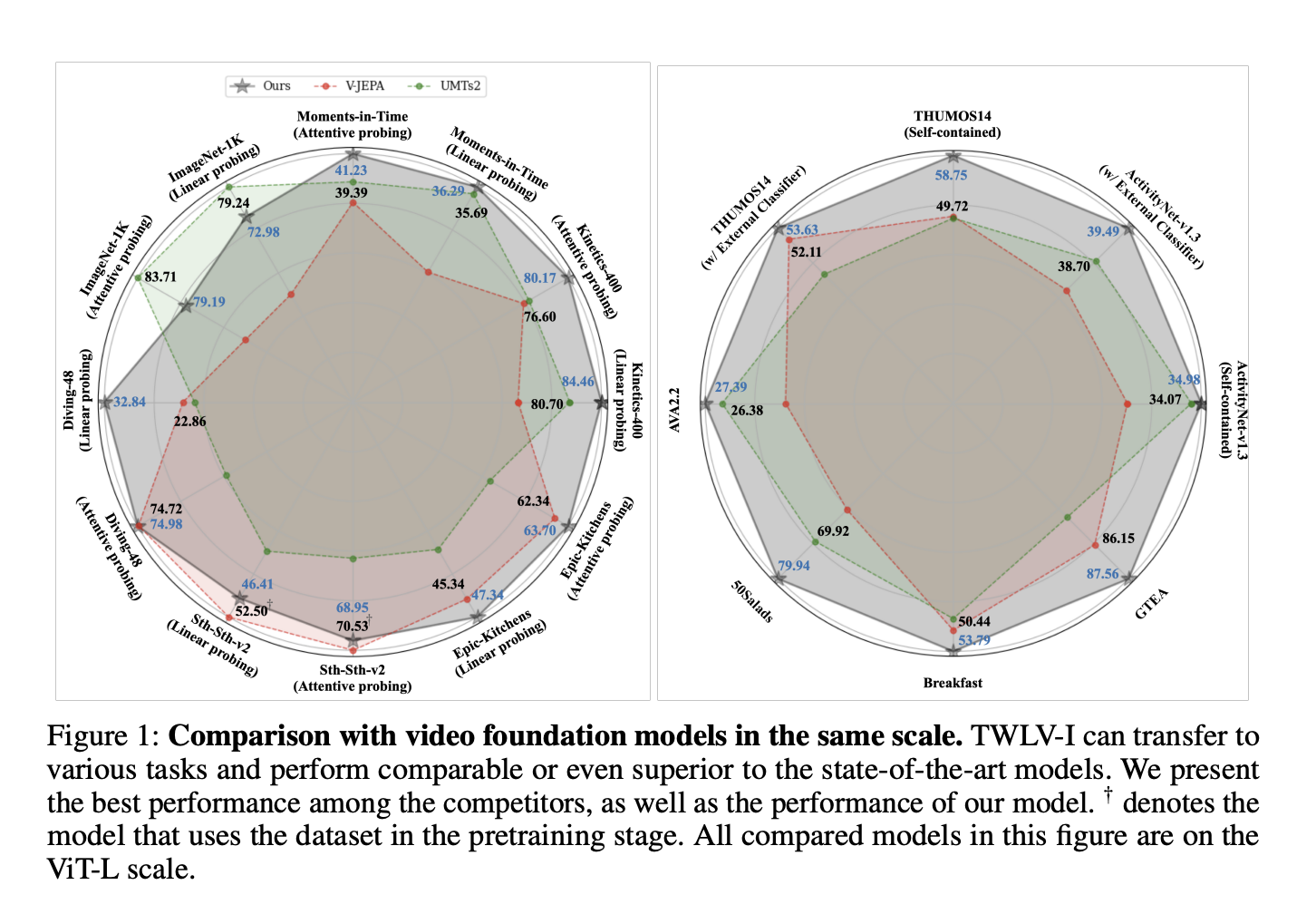

Un equipo de Twelve Labs ha propuesto TWLV-I, un nuevo modelo diseñado para proporcionar vectores de incrustación para vídeos que capturan la apariencia y el movimiento. Aunque se entrenó solo con conjuntos de datos disponibles públicamente, TWLV-I muestra un sólido rendimiento en los puntos de referencia de reconocimiento de acciones centrados en la apariencia y el movimiento. Además, el modelo logra un rendimiento de vanguardia en tareas centradas en el vídeo, como la localización de acciones temporales y espaciotemporales, así como la segmentación de acciones temporales. Los métodos de evaluación actuales se han mejorado para analizar TWLV-I y otros modelos de base de vídeo (VFM), con un nuevo enfoque analítico y una técnica para encontrar la capacidad del modelo para diferenciar vídeos en función de la dirección del movimiento, independientemente de la apariencia.

TWLV-I adopta la arquitectura ViT, disponible en versiones Base con 86M de parámetros y Large con 307M de parámetros. El modelo convierte los videos de entrada en parches, los procesa a través del transformador y agrupa las incrustaciones resultantes por parche para obtener la incrustación de video general. Además, el conjunto de datos de preentrenamiento contiene Kinetics-710, HowTo360K, WebVid10M y varios conjuntos de datos de imágenes. El objetivo de entrenamiento de TWLV-I integra las fortalezas de los enfoques basados en destilación y modelado enmascarado utilizando diferentes estrategias de reconstrucción de objetivos. El modelo utiliza dos métodos de muestreo de cuadros, (a) incrustación uniforme para videos más cortos y (b) incrustación de múltiples clips para videos más largos, para superar las limitaciones computacionales.

Los resultados obtenidos en TWLV-I muestran una mejora significativa del rendimiento en comparación con los modelos existentes en tareas de reconocimiento de acciones. Basándose en la precisión media de top-1 del sondeo lineal en cinco puntos de referencia de reconocimiento de acciones y utilizando solo conjuntos de datos disponibles públicamente para el preentrenamiento, TWLV-I supera a VJEPA (ViT-L) en 4,6 % puntos y a UMT (ViT-L) en 7,7 % puntos. Este modelo supera a modelos más grandes como DFN (ViT-H) en 7,2 % puntos, V-JEPA (ViT-H) en 2,7 % puntos e InternVideo2 (ViT-g) en 2,8 % puntos. Los investigadores también proporcionaron vectores de incrustación generados por TWLV-I a partir de puntos de referencia de video ampliamente utilizados y código fuente de evaluación que puede utilizar directamente estas incrustaciones.

Un equipo de Twelve Labs ha propuesto TWLV-I, un nuevo modelo diseñado para proporcionar vectores de incrustación para vídeos que capturan la apariencia y el movimiento. TWLV-I demuestra ser un modelo de base de vídeo sólido que muestra un gran rendimiento en la comprensión del movimiento y la apariencia. Se espera que el modelo TWLV-I y sus incrustaciones se utilicen ampliamente en diversas aplicaciones. Además, los métodos de evaluación y análisis se adoptarán activamente en el dominio del modelo de base de vídeo. En el futuro, se espera que estos métodos guíen la investigación en el campo de la comprensión del vídeo, logrando un mayor progreso en el desarrollo de modelos de análisis de vídeo más completos.

Echa un vistazo a la Papel y GitHub. Todo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!. Si te gusta nuestro trabajo, te encantará nuestro hoja informativa..

No olvides unirte a nuestro Más de 49 000 suscriptores de ML en Reddit

Encuentra lo próximo Seminarios web sobre IA aquí

Sajjad Ansari es un estudiante de último año de la carrera de IIT Kharagpur. Como entusiasta de la tecnología, se adentra en las aplicaciones prácticas de la IA, centrándose en comprender el impacto de las tecnologías de IA y sus implicaciones en el mundo real. Su objetivo es articular conceptos complejos de IA de una manera clara y accesible.