Los modelos LLM se utilizan cada vez más en el ámbito sanitario para tareas como la respuesta a preguntas y la elaboración de resúmenes de documentos, con un rendimiento similar al de los expertos en la materia. Sin embargo, aún queda por ver su eficacia en tareas biomédicas tradicionales, como la extracción de información estructurada. Si bien los modelos LLM han generado resultados de texto libre con éxito, los enfoques actuales se centran principalmente en mejorar el conocimiento interno de los modelos mediante métodos como el ajuste fino y el aprendizaje en contexto. Estos métodos dependen de datos fácilmente disponibles, a menudo insuficientes en el ámbito biomédico debido a los cambios de dominio y la falta de recursos para tareas estructuradas específicas, lo que hace que el rendimiento de disparo cero sea crítico pero poco explorado.

Investigadores de varias instituciones, entre ellas ASUS Intelligent Cloud Services, Imperial College London y la Universidad de Manchester, realizaron un estudio para evaluar el rendimiento de los LLM en tareas de clasificación médica y reconocimiento de entidades nombradas (NER). Su objetivo era analizar cómo diferentes factores, como el razonamiento específico de la tarea, el conocimiento del dominio y la incorporación de expertos externos, influyen en el rendimiento de los LLM. Sus hallazgos revelaron que las indicaciones estándar superaron a las técnicas más complejas, como el razonamiento en cadena de pensamiento (CoT) y la generación aumentada por recuperación (RAG). El estudio destaca los desafíos de aplicar métodos avanzados de indicaciones en tareas biomédicas y hace hincapié en una mejor integración del conocimiento externo en los LLM para aplicaciones del mundo real.

La literatura existente sobre evaluación comparativa de los LLM en el ámbito médico se centra principalmente en tareas como la respuesta a preguntas, la elaboración de resúmenes y la codificación clínica, y a menudo descuida las tareas de predicción estructurada, como la clasificación de documentos y el reconocimiento de entidades con nombre. Si bien el trabajo anterior ha proporcionado recursos valiosos para las tareas estructuradas tradicionalmente, muchos puntos de referencia los pasan por alto a favor de la evaluación de modelos específicos del dominio. Los enfoques recientes para mejorar el rendimiento de los LLM incluyen el preentrenamiento específico del dominio, el ajuste de instrucciones, el razonamiento CoT y el RAG. Sin embargo, estos métodos a menudo necesitan una evaluación más sistemática en el contexto de la predicción estructurada, que el estudio pretende abordar.

Para evaluar el desempeño de LLM en tareas de predicción estructurada, el estudio compara una variedad de modelos en tareas de clasificación de textos biomédicos y NER en un entorno de cero disparos real. Este enfoque evalúa el conocimiento paramétrico inherente de los modelos, que es crucial debido a la escasez de datos biomédicos anotados. Comparamos este desempeño de referencia con mejoras del razonamiento CoT, RAG y métodos de autoconsistencia mientras mantenemos el conocimiento paramétrico constante. Las técnicas se evalúan utilizando una variedad de conjuntos de datos, que incluyen fuentes en inglés y en otros idiomas, y los modelos se restringen para garantizar un resultado estructurado.

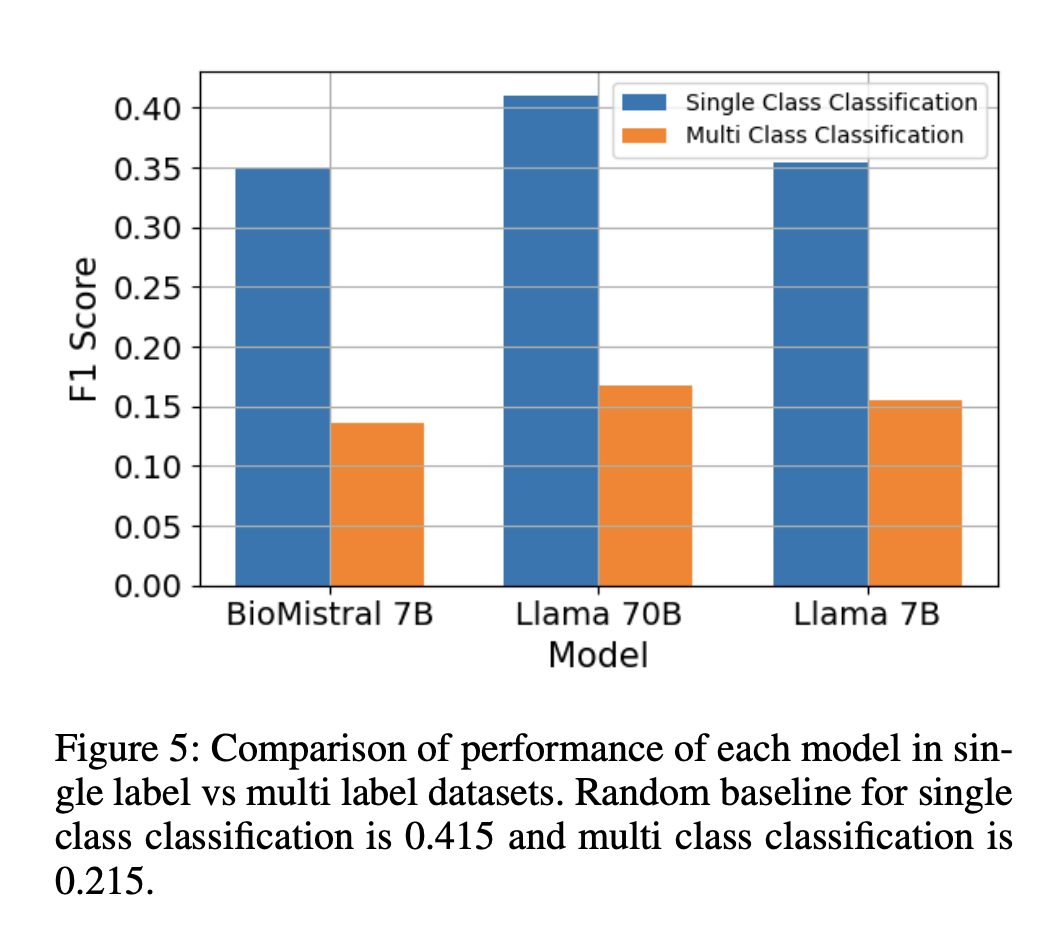

Los resultados de la evaluación revelan que las técnicas de razonamiento y mejora del conocimiento generalmente no mejoran el rendimiento. Standard Prompting arroja consistentemente las puntuaciones F1 más altas para las tareas de clasificación en todos los modelos, con BioMistral-7B, Llama-2-70B y Llama-2-7B con puntuaciones de 36,48 %, 40,34 % y 34,92 %, respectivamente. Los métodos complejos como CoT Prompting y RAG a menudo deben tener un mejor rendimiento que Standard Prompting. Los modelos más grandes, como Llama-2-70B, mejoran significativamente, especialmente en tareas que requieren razonamiento avanzado. Sin embargo, los conjuntos de datos multilingües y privados muestran un rendimiento inferior, y las tareas de alta complejidad aún necesitan mejorarse, y las técnicas RAG muestran beneficios inconsistentes.

El estudio compara los LLM en Clasificación Médica y NER, revelando importantes perspectivas. A pesar de las técnicas avanzadas como CoT y RAG, Standard Prompting supera consistentemente a estos métodos en todas las tareas. Esto subraya una limitación fundamental en la generalización y efectividad de los LLM en la extracción de información biomédica estructurada. Los resultados destacan que los métodos de propulsión avanzados actuales deben traducirse mejor a las tareas biomédicas, enfatizando la necesidad de integrar el conocimiento específico del dominio y las capacidades de razonamiento para mejorar el desempeño de los LLM en aplicaciones de atención médica del mundo real.

Echa un vistazo a la Papel. Todo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!. Si te gusta nuestro trabajo, te encantará nuestro hoja informativa..

No olvides unirte a nuestro Más de 49 000 suscriptores de ML en Reddit

Encuentra lo próximo Seminarios web sobre IA aquí

Sana Hassan, pasante de consultoría en Marktechpost y estudiante de doble titulación en el IIT Madrás, es un apasionado de la aplicación de la tecnología y la IA para abordar los desafíos del mundo real. Con un gran interés en resolver problemas prácticos, aporta una perspectiva nueva a la intersección de la IA y las soluciones de la vida real.