Los transformadores generativos preentrenados de gran tamaño han demostrado un rendimiento excepcional en diversas tareas de generación de lenguaje natural, utilizando grandes conjuntos de datos de entrenamiento para capturar la lógica del lenguaje humano. Sin embargo, adaptar estos modelos para ciertas aplicaciones mediante un ajuste fino plantea desafíos importantes. La eficiencia computacional del ajuste fino depende en gran medida del tamaño del modelo, lo que hace que sea costoso para los investigadores trabajar con modelos grandes. El ajuste fino en conjuntos de datos más pequeños plantea un riesgo de olvido catastrófico, donde el modelo se sobreajusta a un dominio de tarea específico y pierde conocimiento importante obtenido durante el preentrenamiento. Debido a este problema, las habilidades de razonamiento, como la generalización compositiva y el sentido común, enfrentan problemas al evaluar el modelo.

Los métodos existentes incluyen el ajuste rápido, que implica agregar tokens o vectores entrenables a la entrada y optimizar sus incrustaciones. Este método permite la adaptación a nuevas tareas con datos mínimos, lo que reduce el riesgo de olvido catastrófico. El segundo método es el algoritmo NeuroAlly-Decomposed Oracles (NADO), que proporciona un punto intermedio a través de un modelo de transformador más pequeño para controlar el modelo base sin cambiar sus parámetros. Sin embargo, quedan preguntas sobre sus prácticas de entrenamiento óptimas para discrepancias de distribución significativas y la reducción de costos adicionales asociados con el entrenamiento del módulo NADO. El último método es el algoritmo GeLaTo, un marco innovador para mejorar la generación de texto autorregresivo mediante la integración de modelos probabilísticos manejables (TPM).

Un equipo de investigadores de la Universidad de California en Los Ángeles, Amazon AGI y Samsung Research America han presentado los oráculos de descomposición neuronal desenredados según normas (DiNADO), una parametrización mejorada del algoritmo NADO. Mejora la convergencia de NADO durante el ajuste fino supervisado y las etapas posteriores y se centra en la singularidad de los óptimos paramétricos globales. La ineficiencia de la estimación de gradiente se maneja utilizando NADO con señales dispersas de la función de señal de control, lo que muestra cómo mejorar la eficiencia de la estimación de muestra y gradiente. Además, una combinación natural de DiNADO con enfoques como LoRA permite actualizaciones del modelo base a través de una formulación contrastiva y mejora la capacidad del modelo NADO al tiempo que mejora el rendimiento en tiempo de inferencia.

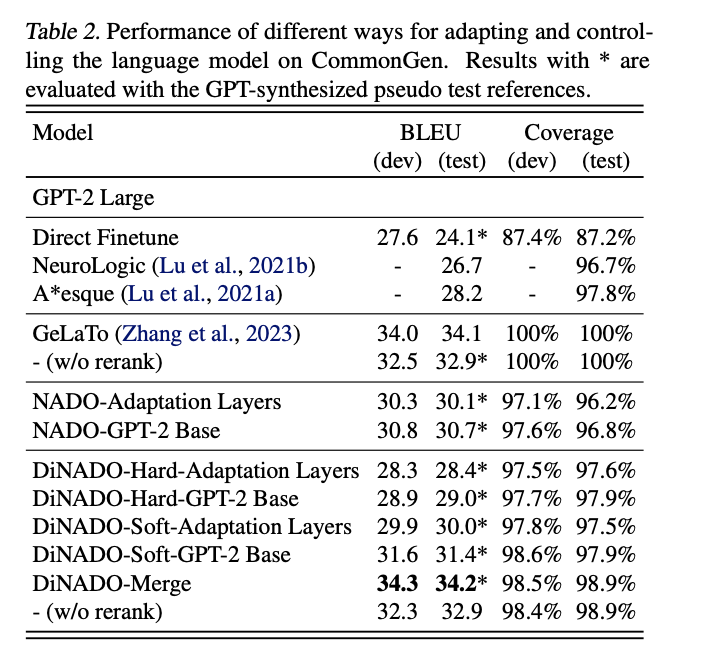

La evaluación de DiNADO se realiza mediante dos tareas principales: traducción automática formal (FormalMT) y generación con restricciones léxicas (LCG). En el caso de FormalMT, se utilizan una referencia formal y un clasificador binario para aproximar la puntuación de formalidad. La tarea LCG utiliza el conjunto de datos CommonGen, que evalúa las capacidades de generalización compositiva y el razonamiento de sentido común de los modelos de generación de texto. Los experimentos se dividen en dos partes:

- Resultados utilizando una distribución base GPT-2-Large, evaluados por calidad de generación y controlabilidad.

- Un estudio de eficiencia de muestra sobre cómo diferentes diseños y técnicas de reponderación de objetivos mejoran la eficiencia de muestra de NADO.

Los resultados demuestran que DiNADO-Soft supera a DiNADO-Hard, ya que la estricta consistencia hacia adelante de DiNADO-Hard puede afectar el aprendizaje de la señal del oráculo. Los módulos NADO de mayor capacidad ofrecen mayor flexibilidad y capacidad de control con DiNADO-Merge, mostrando un rendimiento más generalizable. Además, el desenredo de normas de DiNADO ayuda a controlar el término de regularización por debajo de 0,5, lo que garantiza que las actualizaciones en la función R mejoren consistentemente la distribución compuesta. Esto contrasta con NADO simple, donde la divergencia en el término de regularización puede afectar la mejora del rendimiento, lo que resalta la dinámica de entrenamiento superior y la eficacia de DiNADO en tareas de generación de texto controladas.

En resumen, los investigadores introdujeron DiNADO, una parametrización mejorada del algoritmo NADO. Una de las principales ventajas de DiNADO es su compatibilidad con métodos de ajuste fino como LoRA, lo que permite una variante de NADO con mayor capacidad. Además, los investigadores realizaron un análisis teórico de los diseños defectuosos de la implementación de NADO original y sugirieron soluciones específicas. Este artículo aporta información valiosa y mejoras en el campo de la generación de lenguaje controlable, lo que podría abrir nuevos caminos para aplicaciones de generación de texto más eficientes y efectivas.

Echa un vistazo a la Papel. Todo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y LinkedInÚnete a nuestro Canal de Telegram. Si te gusta nuestro trabajo, te encantará nuestro hoja informativa..

No olvides unirte a nuestro Subreddit con más de 50 000 millones de usuarios

Sajjad Ansari es un estudiante de último año de la carrera de IIT Kharagpur. Como entusiasta de la tecnología, se adentra en las aplicaciones prácticas de la IA, centrándose en comprender el impacto de las tecnologías de IA y sus implicaciones en el mundo real. Su objetivo es articular conceptos complejos de IA de una manera clara y accesible.