La liberación de Lector-LM-0.5B y Lector-LM-1.5B El lanzamiento de Jina AI marca un hito importante en la tecnología de modelos de lenguaje pequeños (SLM). Estos modelos están diseñados para resolver un desafío único y específico: convertir HTML sin procesar y con ruido de la web abierta en un formato Markdown limpio. Si bien parece sencilla, esta tarea plantea desafíos complejos, en particular en el manejo del gran ruido en el contenido web moderno, como encabezados, pies de página y barras laterales. La serie Reader-LM tiene como objetivo abordar este desafío de manera eficiente, centrándose en la rentabilidad y el rendimiento.

Antecedentes y propósito

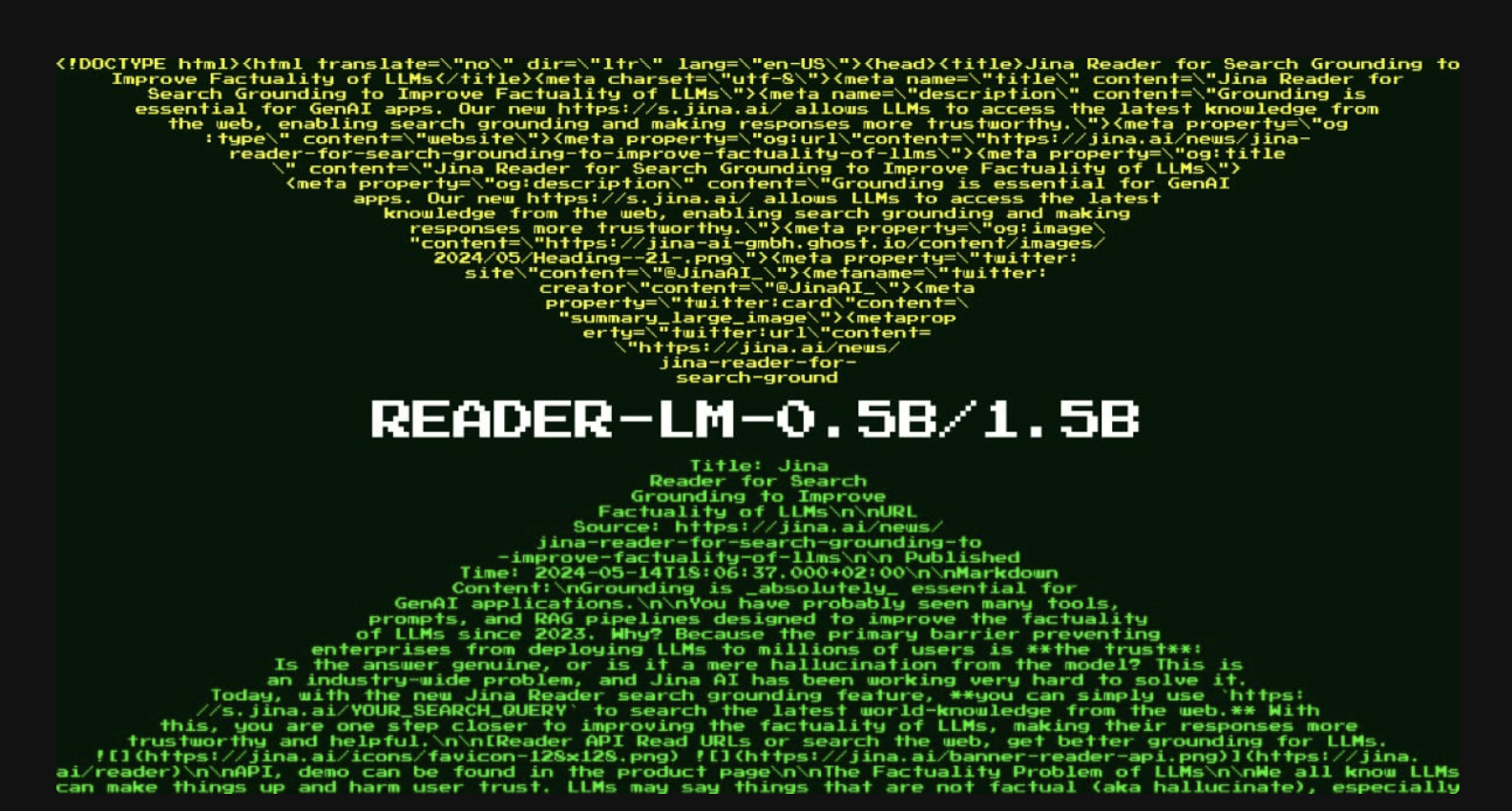

En abril de 2024, Jina AI presentó Jina Reader, una API que convierte cualquier URL en un Markdown adecuado para modelos de lenguaje grandes (LLM). Esta API se basa en herramientas como el paquete Readability de Mozilla para extraer el contenido principal de una página web, seguido de regex y la biblioteca Turndown para convertir HTML limpio en Markdown. Sin embargo, este método enfrentaba problemas, como el filtrado de contenido incorrecto y dificultades para convertir estructuras HTML complejas. A medida que llegaban los comentarios de los usuarios, Jina AI se dio cuenta de que parchear el flujo de trabajo existente con más patrones de regex y heurísticas no era una solución sostenible.

Para superar estas limitaciones, Jina AI se planteó una pregunta importante: ¿se podría resolver este problema de principio a fin utilizando un modelo de lenguaje? En lugar de depender de reglas seleccionadas manualmente, un modelo de lenguaje podría gestionar la tarea de conversión de HTML a Markdown de forma más eficiente, especialmente con menos de mil millones de parámetros, lo que haría posible su ejecución en el borde.

Introducción de los modelos Reader-LM

Jina AI lanzó dos pequeños modelos de lenguaje: Lector-LM-0.5B y Lector-LM-1.5BEstos modelos están entrenados específicamente para convertir HTML sin formato en Markdown, y ambos son multilingües y admiten hasta 256 000 tokens de longitud de contexto. Esta capacidad de manejar contextos grandes es fundamental, ya que el contenido HTML de los sitios web modernos suele contener más ruido que nunca, con CSS en línea, JavaScript y otros elementos que aumentan significativamente el recuento de tokens.

Si bien los modelos de lenguaje de gran tamaño son conocidos por sus altos requisitos computacionales, los modelos de lenguaje pequeños como Reader-LM están diseñados para ofrecer un rendimiento eficiente sin una infraestructura costosa. Reader-LM-0.5B y Reader-LM-1.5B superan a muchos modelos más grandes en la tarea específica de conversión de HTML a Markdown y, al mismo tiempo, tienen solo una fracción de su tamaño.

Arquitectura y especificaciones

Los modelos Reader-LM están diseñados para manejar entradas de contexto largas y realizar copias selectivas de HTML a Markdown. Esta tarea es más sencilla que las funciones LLM típicas, como la generación de texto o la escritura de código. Este comportamiento de copia selectiva se centra principalmente en identificar contenido relevante, omitir elementos innecesarios como barras laterales y encabezados, y formatear el contenido restante en sintaxis Markdown.

Especificaciones del modelo

- Lector-LM-0.5B: Con 494 millones de parámetros, este modelo cuenta con 24 capas, 896 tamaños ocultos y 14 encabezados de consulta. Es compacto pero capaz de gestionar de manera eficiente la tarea de copia selectiva.

- Lector-LM-1.5B: Este modelo más grande tiene 1.54 mil millones de parámetros, 28 capas, 1536 tamaños ocultos y 12 encabezados de consulta. Su rendimiento es mejor que el modelo más pequeño, especialmente cuando se trabaja con estructuras HTML más complejas.

Ambos modelos admiten una longitud de contexto de hasta 256 000 tokens, lo que resulta crucial para procesar el contenido HTML, a menudo extenso y ruidoso, que se encuentra en la Web. Su capacidad para gestionar contenido multilingüe los convierte en herramientas de aplicación globales versátiles.

Rendimiento y evaluación comparativa

El rendimiento de Reader-LM-0.5B y Reader-LM-1.5B se ha evaluado rigurosamente en comparación con varios modelos de lenguaje de gran tamaño, incluidos GPT-4o, Gemini-1.5-Flash, LLaMA-3.1-70B y Qwen2-7BInstruct. Los modelos se probaron utilizando métricas como ROUGE-L (para tareas de resumen y respuesta a preguntas), Token Error Rate (TER, que mide la tasa de contenido alucinado) y Word Error Rate (WER, que evalúa las discrepancias entre el markdown generado y el HTML original).

En estas evaluaciones, los modelos Reader-LM superaron a muchos modelos más grandes en términos de generación de markdowns limpios y precisos a partir de HTML. Por ejemplo, Reader-LM-1.5B logró una puntuación ROUGE-L de 0,72, un WER de 1,87 y un TER de 0,19, significativamente mejor que GPT-4o y otros modelos probados. Reader-LM-0.5B, aunque más pequeño, también arrojó resultados competitivos, especialmente en la tarea de conservación de la estructura, que es vital para convertir HTML en markdown.

Capacitación y desarrollo

Para entrenar los modelos Reader-LM fue necesario preparar pares de datos de alta calidad de HTML sin procesar y el Markdown correspondiente. Jina AI generó estos datos utilizando su API Jina Reader existente, complementada con HTML sintético generado por GPT-4o para fines de entrenamiento. El conjunto de datos de entrenamiento final contenía aproximadamente 2500 millones de tokens.

Los modelos fueron entrenados en dos etapas:

- HTML breve y sencillo: Esta etapa involucró hasta 32.000 tokens y 1.500 millones de tokens de entrenamiento.

- HTML largo y complejo: En esta etapa, las secuencias se ampliaron a 128 000 tokens con 1200 millones de tokens de entrenamiento. Una innovación clave durante esta etapa fue el uso del “mecanismo de atención en zigzag”, que mejoró el procesamiento de contextos largos.

A pesar de la complejidad de la conversión de HTML a Markdown, los modelos se optimizaron para manejar esta tarea de manera efectiva sin una sobrecarga computacional innecesaria. Aprovechan técnicas como la búsqueda contrastiva para evitar la degeneración de tokens y los bucles repetitivos durante la generación de Markdown.

Aplicaciones en el mundo real

Reader-LM está diseñado para su uso práctico tanto en entornos individuales como empresariales. Los modelos se pueden probar fácilmente con Google Colab y los entornos de producción pueden aprovechar plataformas como Azure y AWS, donde los modelos estarán disponibles próximamente. Reader-LM tiene licencia CC BY-NC 4.0 y ofrece opciones de uso comercial para empresas que buscan soluciones locales.

Los modelos son ideales para automatizar la extracción y limpieza de datos de la web abierta en entornos de producción. Al convertir HTML sin formato en Markdown limpio, Reader-LM permite un procesamiento de datos eficiente, lo que facilita que los LLM posteriores resuman, razonen y generen información a partir del contenido web. Además, sus capacidades multilingües amplían su aplicabilidad a varias industrias y regiones.

Conclusión

El lanzamiento de Reader-LM-0.5B y Reader-LM-1.5B representa un gran avance en la tecnología de modelos de lenguaje pequeños, especialmente diseñados para la conversión de HTML a Markdown. Estos modelos abordan una necesidad crítica de extracción de datos eficiente y rentable del contenido web ruidoso y a menudo abrumador que caracteriza a Internet moderno. Con su tamaño compacto, compatibilidad con contextos extensos y capacidades multilingües, los modelos Reader-LM ofrecen una herramienta poderosa para desarrolladores y empresas que buscan optimizar sus flujos de trabajo de datos.

Echa un vistazo a la 𝐑𝐞𝐚𝐝𝐞𝐫-𝐋𝐌-𝟎.𝟓𝐁, 𝐑𝐞𝐚𝐝𝐞𝐫-𝐋𝐌-1.𝟓𝐁 y Cuaderno de ColabTodo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!. Si te gusta nuestro trabajo, te encantará nuestro hoja informativa..

No olvides unirte a nuestro Subreddit con más de 50 000 millones de usuarios

Asif Razzaq es el director ejecutivo de Marktechpost Media Inc. Como ingeniero y emprendedor visionario, Asif está comprometido con aprovechar el potencial de la inteligencia artificial para el bien social. Su iniciativa más reciente es el lanzamiento de una plataforma de medios de inteligencia artificial, Marktechpost, que se destaca por su cobertura en profundidad de noticias sobre aprendizaje automático y aprendizaje profundo que es técnicamente sólida y fácilmente comprensible para una amplia audiencia. La plataforma cuenta con más de 2 millones de visitas mensuales, lo que ilustra su popularidad entre el público.