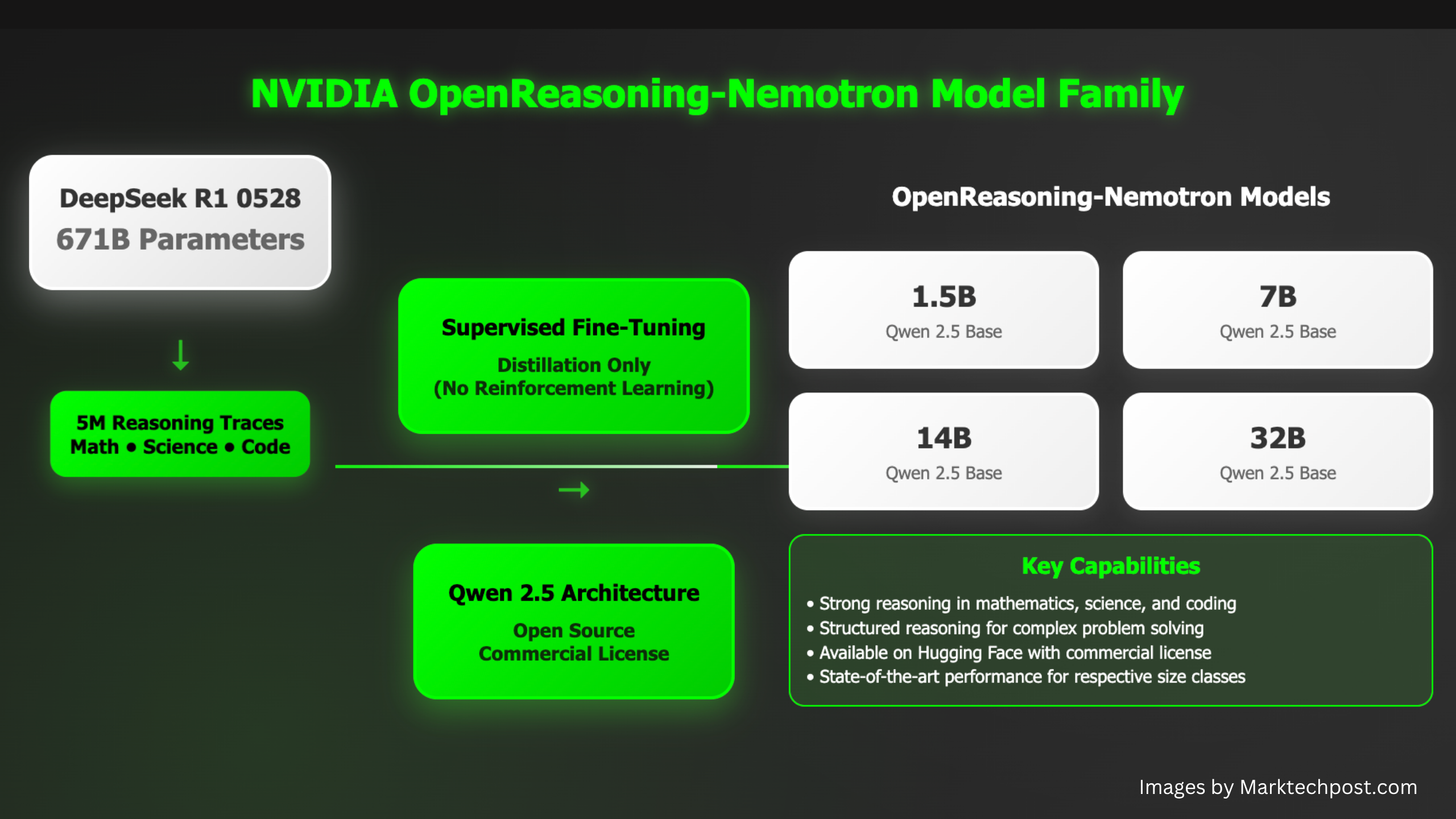

Nvidia ai ha introducido OpenRasoning-Nemotronuna familia de modelos de idiomas grandes (LLM) diseñados para sobresalir en tareas de razonamiento complejos en matemáticas, ciencias y código. Este modelo de suite: compresión 1.5B, 7B, 14B y 32B de versiones de parámetros-ha sido destilado del modelo 671B Deepseek R1 0528capturando sus capacidades de razonamiento de alto nivel en modelos significativamente más pequeños y más eficientes.

El lanzamiento posiciona a Nvidia como un contribuyente líder al ecosistema LLM de código abierto, entregando modelos que impulsan el rendimiento de última generación (SOTA) mientras permanecen comercialmente permisivos y ampliamente accesibles a través de Cara abrazada.

Descripción general del modelo y arquitectura

✅ Destilación de Deepseek R1 0528 (671b)

En el corazón de OpenRasoning-Nemotron se encuentra un Estrategia de destilación que transfiere la capacidad de razonamiento de Deepseek R1, un modelo masivo de parámetros 671B, en arquitecturas más pequeñas. El proceso prioriza Generalización de razonamiento sobre la predicción del token bruto, lo que permite que los modelos compactos funcionen de manera efectiva en tareas estructuradas de alta cognición.

El conjunto de datos de destilación enfatiza Matemáticas, ciencias y lenguajes de programaciónAlineando las capacidades del modelo con dominios de razonamiento clave.

📊 Variantes y especificaciones del modelo

| Nombre del modelo | Parámetros | Uso previsto | Página de la cara abrazada |

|---|---|---|---|

| OpenRasoning-Nemotron-1.5b | 1.5b | Razonamiento e inferencia de nivel de entrada | Enlace |

| OpenRasoning-Nemotron-7b | 7b | Razonamiento a mitad de escala, bueno para código/matemáticas | Enlace |

| OpenRasoning-Nemotron-14b | 14b | Capacidades de razonamiento avanzado | Enlace |

| OpenRasoning-Nemotron-32b | 32B | Rendimiento del modelo de frontera cercana en tareas lógicas intensivas en lógica | Enlace |

Todos los modelos son compatibles con Arquitecturas de transformadoresapoyo Cuantización FP16/INT8y están optimizados para NVIDIA GPU y NEMO marcos.

Puntos de referencia de rendimiento

Estos modelos se establecen Nuevos puntajes de pase de última generación@1 para su clase de tamaño a través de múltiples puntos de referencia de razonamiento:

| Modelo | GPQA | MMLU -Pro | HLE | LivecodeBench | Cicode | AIME24 | AIME25 | Hmmt Feb 2025 |

| 1.5b | 31.6 | 47.5 | 5.5 | 28.6 | 2.2 | 55.5 | 45.6 | 31.5 |

| 7b | 61.1 | 71.9 | 8.3 | 63.3 | 16.2 | 84.7 | 78.2 | 63.5 |

| 14b | 71.6 | 77.5 | 10.1 | 67.8 | 23.5 | 87.8 | 82.0 | 71.2 |

| 32B | 73.1 | 80.0 | 11.9 | 70.2 | 28.5 | 89.2 | 84.0 | 73.8 |

Todos los puntajes citados son pass@1 sin genselect.

🔍 Genselect (modo pesado)

Usando Selección generativa con 64 candidatos (“Genselect”), el rendimiento mejora, especialmente a 32B:

- 32b logra: AIME24 89.2 → 93.3, AIME25 84.0 → 90.0, Hmmt 73.8 → 96.7, LivecodeBench 70.2 → 75.3.

Esto demuestra un fuerte rendimiento de razonamiento emergente a escala.

Datos de capacitación y especialización de razonamiento

El corpus de entrenamiento es un subconjunto destilado y de alta calidad del conjunto de datos Deepseek R1 0528. Las características clave incluyen:

- Datos de razonamiento muy curados De Matemáticas, Ciencias y Disciplinas CS.

- Aviso de ingeniería Diseñado para reforzar las cadenas de pensamiento de varios pasos.

- Énfasis consistencia lógica, satisfacción de restriccióny razonamiento simbólico.

Esta curación deliberada garantiza una fuerte alineación con los problemas de razonamiento del mundo real que se encuentran tanto en la academia como en la aplicación. Ml dominios.

Integración abierta y del ecosistema

Los cuatro modelos OpenRasoning-Nemotron se lanzan bajo un licencia abierta y comercialmente permisivacon tarjetas modelo, scripts de evaluación y pesos listos para la inferencia disponibles en la cara abrazada:

Estos modelos están diseñados para conectarse a la Marco nvidia nemoy apoyo Tensorrt-llm, ONNXy Abrazando los transformadores de la cara Cadenas de herramientas, facilitando la implementación rápida en la producción y los entornos de investigación.

Casos de uso clave

- Tutores de matemáticas y solucionadores de teorema

- Agentes científicos de control de calidad y sistemas de razonamiento médico

- Asistentes de generación y depuración de código

- Respuesta de preguntas de múltiples saltos de la cadena de pensamiento

- Generación de datos sintéticos para dominios estructurados

Conclusión

Los modelos OpenRasoning-Nemotron de Nvidia ofrecen un camino pragmático de código abierto hacia Capacidad de razonamiento de escala sin costos de cómputo a escala fronteriza. Al destilarse del 671B Deepseek R1 y dirigirse a dominios de razonamiento de alta apalancamiento, estos modelos ofrecen un poderoso equilibrio de precisión, eficiencia y accesibilidad.

Para los desarrolladores, investigadores y empresas que trabajan en aplicaciones de IA intensivas en lógica, OpenRasoning-Nemotron proporciona una base convincente, libre de las compensaciones que a menudo acompañan modelos propietarios o sobregeneralizados.

🔍 Preguntas frecuentes (preguntas frecuentes)

Q1. ¿Qué puntos de referencia son compatibles?

GPQA, MMLU-Pro, HLE, LivecodeBench, Scicode, AIME 2024/25, Hmmt Feb 2025 (pase@1).

Q2. ¿Cuántos datos se usaron?

Un corpus de destilación de 5 millones de ejemplos de registro de razonamiento a través de dominios, generados por Deepseek -R1‑0528.

Q3. ¿Se utiliza el aprendizaje de refuerzo?

No, los modelos se capacitan puramente a través de SFT, preservando la eficiencia al tiempo que permite una futura investigación de RL.

Q4. ¿Puedo escalar el razonamiento con genselect?

Sí. El uso de Genselect aumenta significativamente el rendimiento: 32B salta de 73.8 a 96.7 en HMMT con 64 candidatos.

Mira el Detalle técnico. Todo el crédito por esta investigación va a los investigadores de este proyecto.

Oportunidad de patrocinio: Llegue a los desarrolladores de IA más influyentes en Estados Unidos y Europa. 1M+ lectores mensuales, 500k+ constructores comunitarios, infinitas posibilidades. [Explore Sponsorship]

Asif Razzaq es el CEO de MarktechPost Media Inc .. Como empresario e ingeniero visionario, ASIF se compromete a aprovechar el potencial de la inteligencia artificial para el bien social. Su esfuerzo más reciente es el lanzamiento de una plataforma de medios de inteligencia artificial, MarktechPost, que se destaca por su cobertura profunda de noticias de aprendizaje automático y de aprendizaje profundo que es técnicamente sólido y fácilmente comprensible por una audiencia amplia. La plataforma cuenta con más de 2 millones de vistas mensuales, ilustrando su popularidad entre el público.