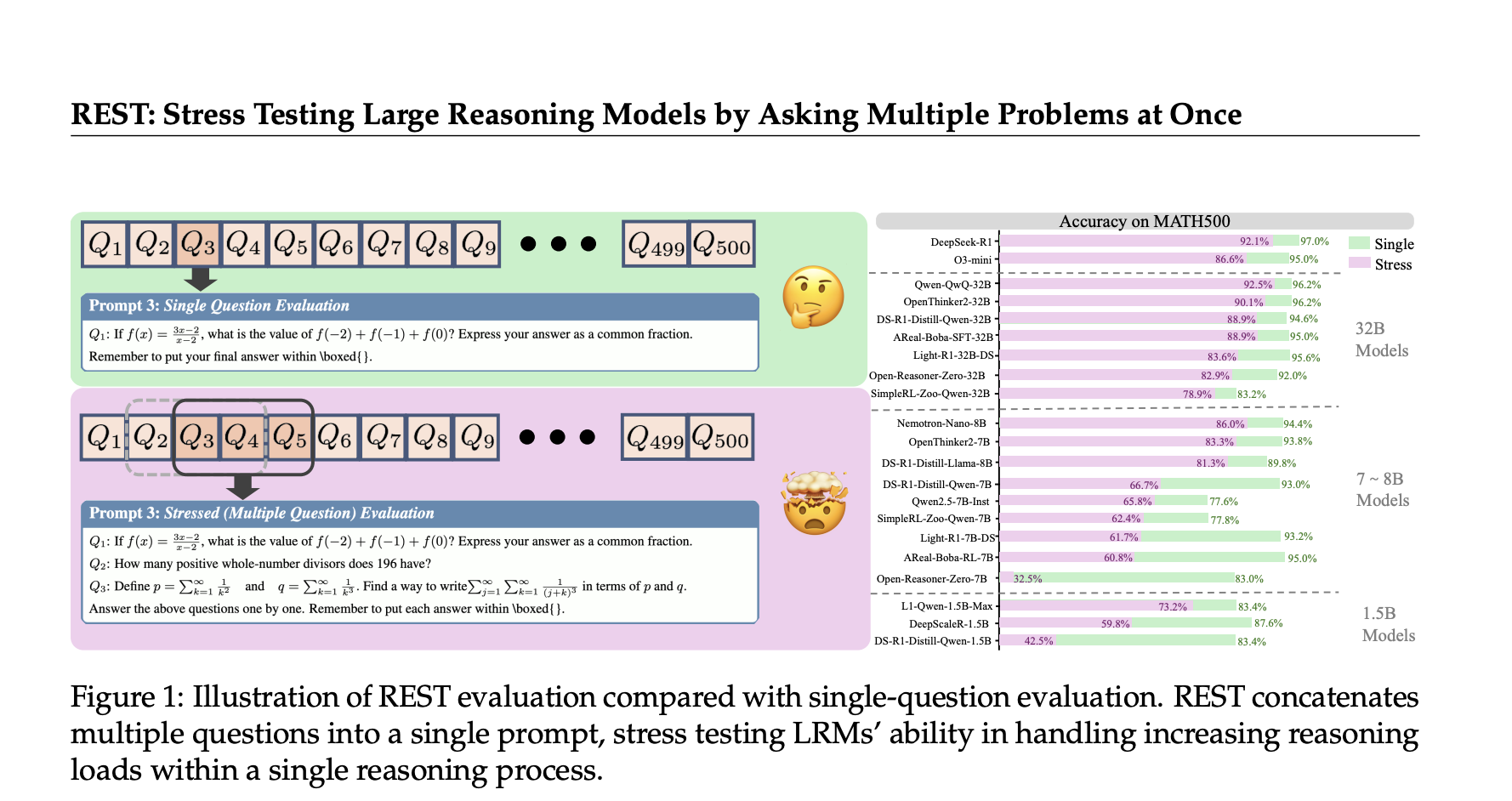

Los grandes modelos de razonamiento (LRM) han avanzado rápidamente, exhibiendo un rendimiento impresionante en tareas complejas de resolución de problemas en dominios como las matemáticas, la codificación y el razonamiento científico. Sin embargo, los enfoques de evaluación actual se centran principalmente en las pruebas de una sola pregunta, lo que revela limitaciones significativas. Este artículo presenta REST (evaluación de razonamiento a través de pruebas simultáneas) -Un nuevo marco de prueba de tensión de problemas múltiples diseñado para empujar LRM más allá de la resolución de problemas aisladas y reflejar mejor sus capacidades de razonamiento de contexto múltiple del mundo real.

Por qué los puntos de referencia de evaluación actuales no tienen grandes modelos de razonamiento

La mayoría de los puntos de referencia actuales, como GSM8K y Math, evalúan LRM haciendo una pregunta a la vez. Si bien es efectivo para el desarrollo inicial del modelo, este enfoque de preguntas aisladas enfrenta dos inconvenientes críticos:

- Disminución del poder discriminativo: Muchos LRM de última generación ahora logran puntajes casi perfectos en puntos de referencia populares (por ejemplo, Deepseek-R1 alcanzando una precisión del 97% en Math500). Estos resultados saturados hacen que sea cada vez más difícil distinguir mejoras del modelo verdaderas, forzando la costosa creación continua de conjuntos de datos más duros para diferenciar las capacidades.

- Falta de evaluación de contexto múltiple del mundo real: Las aplicaciones del mundo real, como la tutoría educativa, el soporte técnico o la multitarea de asistentes de IA, requieren razonamiento en múltiples preguntas potencialmente interferentes simultáneamente. Las pruebas de una sola pregunta no capturan estos desafíos dinámicos y de problemas múltiples que reflejan la verdadera carga cognitiva y la robustez del razonamiento.

Introducción de descanso: prueba de estrés LRM con múltiples problemas a la vez

Para abordar estos desafíos, los investigadores de la Universidad de Tsinghua, Opendatalab, el Laboratorio de AI de Shanghai y la Universidad Renmin se desarrollaron DESCANSARun método de evaluación simple pero poderoso que prueba simultáneamente LRM en múltiples preguntas en un solo mensaje.

- Reconstrucción de referencia múltiple: REST reutiliza los puntos de referencia existentes concatenando múltiples preguntas en un mensaje, ajustando el nivel de estrés Parámetro que controla cuántas preguntas se presentan simultáneamente.

- Evaluación integral: REST evalúa las competencias de razonamiento crítico más allá de la resolución básica de problemas, incluida asignación de prioridad contextual, Resistencia de interferencia de problema cruzadoy gestión de carga cognitiva dinámica.

- Amplia aplicabilidad: El marco se valida en 34 LRM avanzados que varían de 1.500 millones a 671 mil millones de parámetros, probados en 7 puntos de referencia diversos en diferentes niveles de dificultad (desde GSM8K simples hasta desafiantes AIME y GPQA).

REST revela ideas clave sobre las habilidades de razonamiento LRM

La evaluación del resto descubre varios hallazgos innovadores:

1. Degradación significativa del rendimiento bajo estrés de múltiples problemas

Incluso LRMS de última generación Al igual que Deepseek-R1, muestre caídas de precisión notables al manejar múltiples preguntas juntas. Por ejemplo, la precisión de Deepseek-R1 en puntos de referencia desafiantes como AIME24 cae casi por casi 30% en reposo en comparación con las pruebas de preguntas aisladas. Esto contradice suposiciones previas de que los modelos de idiomas grandes son inherentemente capaces de multitarea sin esfuerzo en los problemas.

2. Potencia discriminativa mejorada entre modelos similares

REST amplifica drásticamente las diferencias entre los modelos con puntajes casi idénticos. En Math500, por ejemplo:

- R1-7B y R1-32B lograr precisiones cercanas de una sola cantidad de 93% y 94.6%, respectivamente.

- Bajo reposo, la precisión de R1-7B se desploma 66.75% mientras que R1-32B mantiene un alto 88.97%revelando un marcado 22% de brecha de rendimiento.

De manera similar, entre los modelos del mismo tamaño como AREEAL-BOBA-RL-7B y OpentHinker2-7B, REST captura diferencias significativas en las habilidades de manejo de problemas múltiples que las evaluaciones de preguntas únicas enmascaran.

3. Los métodos posteriores a la capacitación pueden no garantizar un razonamiento robusto de problemas múltiples

Los modelos ajustados con aprendizaje de refuerzo o ajuste supervisado en el razonamiento de un solo problema a menudo no pueden preservar sus ventajas en la configuración de múltiples cuentas de REST. Esto requiere replantes de estrategias de capacitación para optimizar la robustez del razonamiento en escenarios realistas de contexto múltiple.

4. El entrenamiento de “Long2Short” mejora el rendimiento bajo estrés

Modelos entrenados con Técnicas de “Long2Short” – que fomentan las cadenas de razonamiento concisas y eficientes – Mantenga una mayor precisión bajo reposo. Esto sugiere una vía prometedora para diseñar modelos más adecuados para el razonamiento simultáneo de problemas múltiples.

Cómo el descanso estimula los desafíos de razonamiento realistas

Al aumentar el carga cognitiva En los LRM a través de la presentación de problemas simultáneos, REST simula las demandas del mundo real donde los sistemas de razonamiento deben priorizar dinámicamente, evitar el problema excesivo y resistir la interferencia de las tareas concurrentes.

REST también analiza sistemáticamente los tipos de error, revelando modos de falla comunes como:

- Omisión de la pregunta: Ignorando preguntas posteriores en un mensaje de múltiples preguntas.

- Errores de resumen: Resumiendo incorrectamente las respuestas entre los problemas.

- Errores de razonamiento: Errores lógicos o de cálculo dentro del proceso de razonamiento.

Estas ideas matizadas son en gran medida invisibles en las evaluaciones de una sola pregunta.

Configuración de evaluación práctica y cobertura de referencia

- REST Evaluado 34 LRMS Tamaños de expansión de Parámetros de 1.5b a 671B.

- Los puntos de referencia probados incluyen:

- Simple: GSM8K

- Medio: Math500, AMC23

- Desafiante: AIME24, AIME25, GPQA Diamond, LivecodeBench

- Los parámetros de generación de modelos se establecen de acuerdo con las pautas oficiales, con límites de token de salida de 32k para modelos de razonamiento.

- El uso del conjunto de herramientas OpenCompass estandarizado garantiza resultados consistentes y reproducibles.

Conclusión: Descansa como un paradigma de evaluación LRM realista a prueba de futuro

REST constituye un salto significativo hacia adelante en la evaluación de grandes modelos de razonamiento mediante:

- Dirigir la saturación de referencia: Revitaliza los conjuntos de datos existentes sin reemplazos completos costosos.

- Reflejando demandas de tareas múltiples del mundo real: Prueba modelos en condiciones de carga cognitiva realistas y altas.

- Desarrollo del modelo de guía: Destaca la importancia de los métodos de entrenamiento como Long2Short para mitigar el pensamiento excesivo y fomentar el enfoque de razonamiento adaptativo.

En resumen, REST allana el camino para la evaluación comparativa más confiable, robusta y relevante para la aplicación de los sistemas de IA de razonamiento de próxima generación.

Mira el Papel, Página del proyecto y Código. Todo el crédito por esta investigación va a los investigadores de este proyecto. Suscríbete ahora a nuestro boletín de IA

Sajjad Ansari es un pregrado de último año de IIT Kharagpur. Como entusiasta de la tecnología, profundiza en las aplicaciones prácticas de la IA con un enfoque en comprender el impacto de las tecnologías de IA y sus implicaciones del mundo real. Su objetivo es articular conceptos complejos de IA de manera clara y accesible.