La capacitación de aprendizaje de refuerzo a gran escala (RL) de modelos de idiomas en tareas de razonamiento se ha convertido en una técnica prometedora para dominar habilidades complejas de resolución de problemas. Actualmente, métodos como Openi’s O1 y Deepseek’s R1-Zero, han demostrado un notable fenómeno de escenario de tiempo de entrenamiento. El rendimiento de referencia de los modelos y la longitud de respuesta aumentan de manera consistente y constante sin ningún signo de saturación a medida que el cálculo de entrenamiento escala. Inspirados por estos avances, los investigadores de este documento han explorado este nuevo fenómeno de escala mediante la realización de capacitación RL a gran escala directamente en modelos base y se han referido a este enfoque como capacitación razonador-cero.

Investigadores de Stepfun y la Universidad de Tsinghua han propuesto que el estacionamiento abierto-Zero (ORZ), una implementación de código abierto de la capacitación RL orientada al razonamiento a gran escala para los modelos de idiomas. Representa un avance significativo en la realización de técnicas de capacitación avanzadas de RL accesibles para la comunidad de investigación más amplia. Orz mejora diversas habilidades de razonamiento bajo recompensas verificables, incluidas las tareas de aritmética, lógica, codificación y razonamiento de sentido común. Aborda desafíos críticos en la estabilidad del entrenamiento, la optimización de la longitud de la respuesta y las mejoras de rendimiento de referencia a través de una estrategia de capacitación integral. A diferencia de los enfoques anteriores que proporcionaron detalles de implementación limitados, Orz ofrece información detallada sobre su metodología y las mejores prácticas.

El marco ORZ utiliza el QWEN2.5- {7b, 32b} como modelo base, e implementa el entrenamiento RL directo a gran escala sin pasos preliminares de ajuste fino. El sistema aprovecha una versión escalada del algoritmo PPO estándar, optimizado específicamente para tareas orientadas al razonamiento. El conjunto de datos de capacitación consiste en pares de respuesta cuidadosamente seleccionados que se centran en tareas de razonamiento STEM, matemáticas y diversas. La arquitectura incorpora una plantilla de inmediato especializada diseñada para mejorar las capacidades de cálculo de inferencia. La implementación se basa en OpenRLHF, con mejoras significativas que incluyen un entrenador flexible, generación de colocación de GPU y mecanismos avanzados de soporte de descarga de descarga para una capacitación eficiente a gran escala.

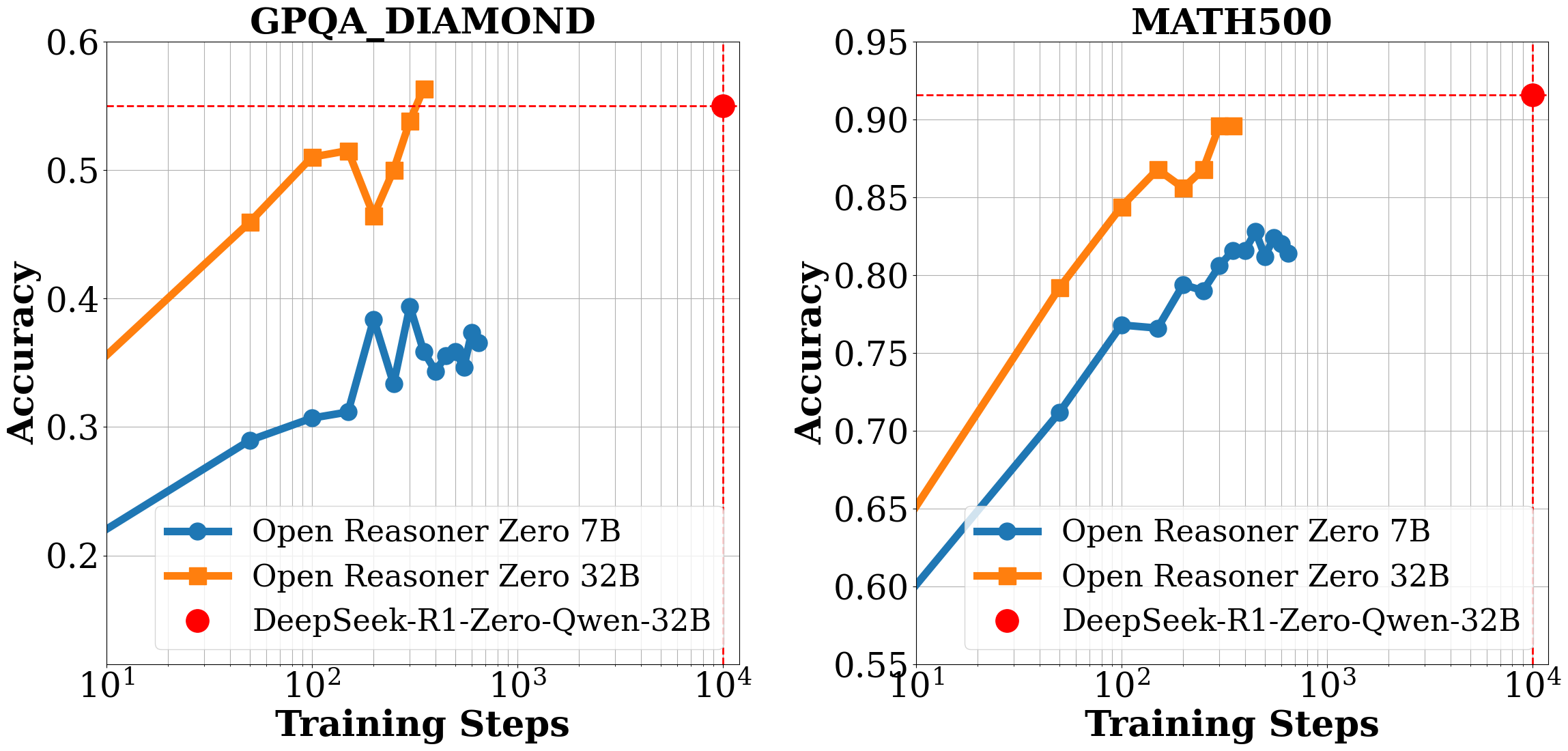

Los resultados de la capacitación demuestran mejoras significativas de rendimiento en múltiples métricas para las variantes 7B y 32B de Rautser-Zero. Las curvas de entrenamiento revelan mejoras consistentes en las métricas de recompensa y la longitud de la respuesta, con un fenómeno notable de “momento de paso” que indica mejoras repentinas en las capacidades de razonamiento. Durante la escala de la longitud de respuesta vs Deepseek-R1-Zero, el modelo abierto-RAYER-ZERO-32B logra longitudes de respuesta comparables a Deepseek-R1-Zero (671B MOE) con solo 1/5.8 de los pasos de entrenamiento. Esta eficiencia valida la efectividad del enfoque minimalista para la capacitación RL a gran escala.

Los principales resultados experimentales muestran que Open-Resterer-Zero funciona excepcionalmente bien en múltiples métricas de evaluación, particularmente en la configuración 32B. Logra resultados superiores en comparación con Deepseek-R1-Zero-Qwen2.5-32b en el punto de referencia de diamantes GPQA, al tiempo que requiere solo 1/30 de los pasos de entrenamiento, mostrando una notable eficiencia de entrenamiento. Además, la variante 7B exhibe una dinámica de aprendizaje interesante, con mejoras de precisión constantes y patrones de crecimiento de longitud de respuesta dramática. Se ha observado un fenómeno distintivo de “momento paso” durante la evaluación, caracterizado por aumentos repentinos tanto en la longitud de recompensa como de respuesta, particularmente evidente en GPQA Diamond y AIME2024 Benchmarks.

En este documento, los investigadores introdujeron el estacionamiento abierto-Zero, que representa un hito significativo en la democratización de la capacitación RL orientada al razonamiento a gran escala para los modelos de idiomas. La investigación muestra que un enfoque simplificado que utiliza PPO de vainilla con GAE y funciones de recompensa basadas en reglas puede lograr resultados competitivos en comparación con los sistemas más complejos. La implementación exitosa sin regularización de KL demuestra que las modificaciones arquitectónicas complejas pueden no ser necesarias para lograr fuertes capacidades de razonamiento. Al obtener abierta la tubería de capacitación y compartir ideas detalladas, este trabajo establece una base para futuras investigaciones en la escala de habilidades de razonamiento del modelo de lenguaje, y esto es solo el comienzo de una nueva tendencia de escala en el desarrollo de la IA.

Verificar el Papel y Página de Github. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, siéntete libre de seguirnos Gorjeo Y no olvides unirte a nuestro Subreddit de 80k+ ml.

Sajjad Ansari es un pregrado de último año de IIT Kharagpur. Como entusiasta de la tecnología, profundiza en las aplicaciones prácticas de la IA con un enfoque en comprender el impacto de las tecnologías de IA y sus implicaciones del mundo real. Su objetivo es articular conceptos complejos de IA de manera clara y accesible.