Los LLM se utilizan ampliamente para la IA conversacional, la generación de contenido y la automatización empresarial. Sin embargo, equilibrar el rendimiento con la eficiencia computacional es un desafío clave en este campo. Muchos modelos de última generación requieren recursos de hardware extensos, lo que los hace poco prácticos para empresas más pequeñas. La demanda de soluciones de IA rentables ha llevado a los investigadores a desarrollar modelos que entreguen un alto rendimiento con requisitos computacionales más bajos.

La capacitación y la implementación de modelos de IA presentan obstáculos para investigadores y empresas. Los modelos a gran escala requieren una potencia computacional sustancial, lo que los hace costosos de mantener. Además, los modelos de IA deben manejar tareas multilingües, garantizar una alta precisión de seguimiento de instrucciones y admitir aplicaciones empresariales como análisis de datos, automatización y codificación. Las soluciones actuales del mercado, aunque efectivas, a menudo exigen infraestructura más allá del alcance de muchas empresas. El desafío es optimizar los modelos de IA para el procesamiento de la eficiencia sin comprometer la precisión o la funcionalidad.

Varios modelos de IA actualmente dominan el mercado, incluidos GPT-4O y Deepseek-V3. Estos modelos se destacan en el procesamiento y generación del lenguaje natural, pero requieren hardware de alta gama, a veces que necesitan hasta 32 GPU para operar de manera efectiva. Si bien proporcionan capacidades avanzadas en la generación de texto, soporte multilingüe y codificación, sus dependencias de hardware limitan la accesibilidad. Algunos modelos también luchan con la precisión de la instrucción a nivel empresarial y la integración de herramientas. Las empresas necesitan soluciones de IA que mantengan un rendimiento competitivo al tiempo que minimizan los costos de infraestructura y implementación. Esta demanda ha impulsado los esfuerzos para optimizar los modelos de idiomas para funcionar con requisitos mínimos de hardware.

Investigadores de Cohere introducidos Comandar unun modelo AI de alto rendimiento, diseñado específicamente para aplicaciones empresariales que requieren máxima eficiencia. A diferencia de los modelos convencionales que requieren grandes recursos computacionales, el Comando A opera en solo dos GPU mientras mantiene el rendimiento competitivo. El modelo comprende 111 mil millones de parámetros y admite una longitud de contexto de 256k, lo que lo hace adecuado para aplicaciones empresariales que involucran el procesamiento de documentos de forma larga. Su capacidad para manejar eficientemente las tareas de agente crítica y multilingüe de negocios lo distingue de sus predecesores. El modelo se ha optimizado para proporcionar una generación de texto de alta calidad al tiempo que reduce los costos operativos, por lo que es una alternativa rentable para las empresas con el objetivo de aprovechar la IA para diversas aplicaciones.

La tecnología subyacente del comando A está estructurada alrededor de una arquitectura de transformador optimizada, que incluye tres capas de atención deslizante de la ventana, cada una con un tamaño de ventana de 4096 tokens. Este mecanismo mejora el modelado de contexto local, lo que permite que el modelo retenga detalles importantes en las entradas de texto extendidas. Una cuarta capa incorpora la atención global sin incrustaciones posicionales, lo que permite interacciones de token sin restricciones en toda la secuencia. El entrenamiento supervisado y de preferencia supervisado del modelo refina aún más su capacidad para alinear las respuestas con las expectativas humanas con respecto a la precisión, la seguridad y la ayuda. Además, el Comando A admite 23 idiomas, lo que lo convierte en uno de los modelos de IA más versátiles para las empresas con operaciones globales. Sus capacidades de chat están preconfiguradas para el comportamiento interactivo, lo que permite aplicaciones de IA conversacionales sin interrupciones.

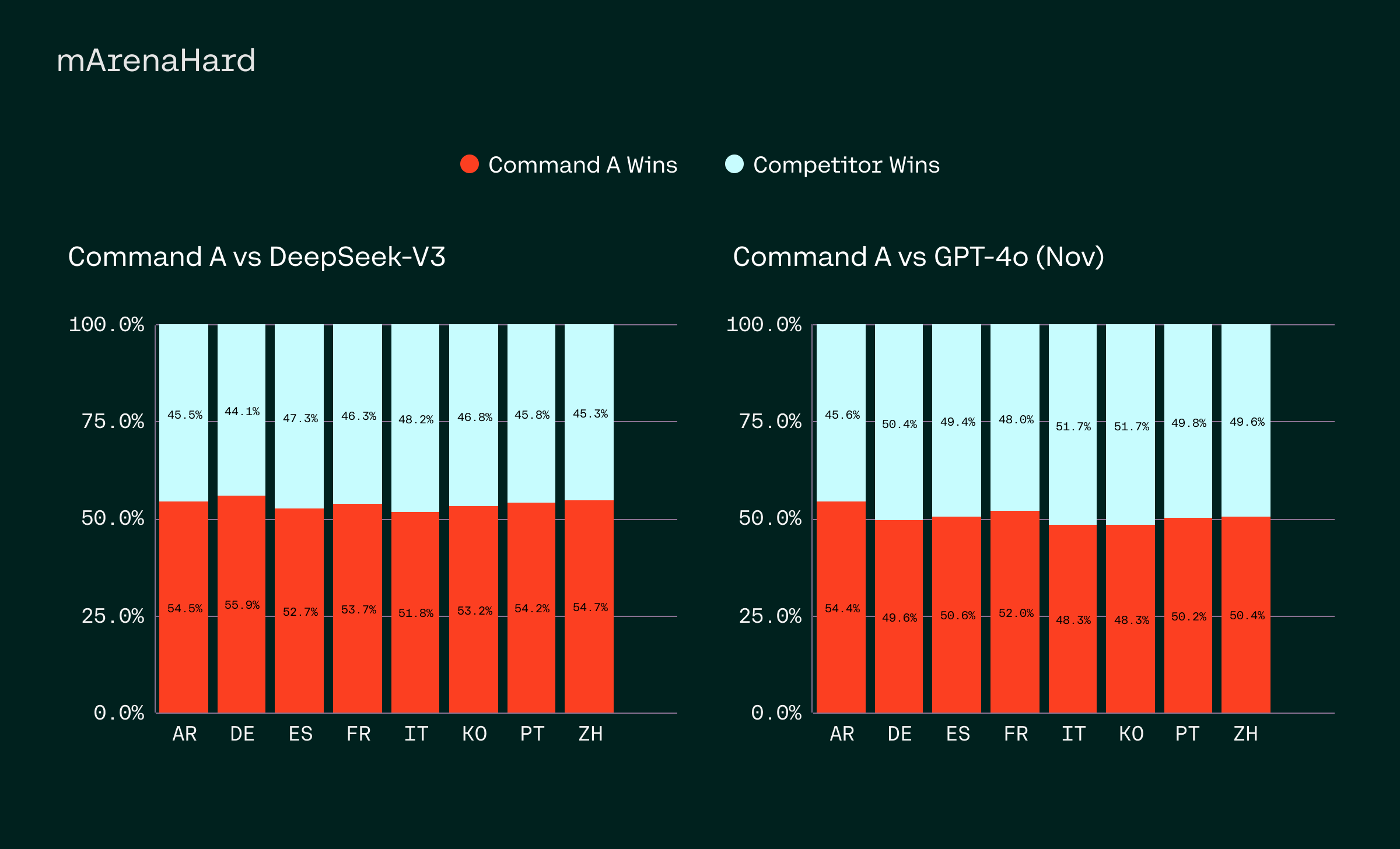

Las evaluaciones de rendimiento indican que el Comando A compite favorablemente con los principales modelos de IA como GPT-4O y Deepseek-V3 en varios puntos de referencia centrados en la empresa. El modelo logra una tasa de generación de tokens de 156 fichas por segundo, 1.75 veces más alta que GPT-4O y 2.4 veces más alta que Deepseek-V3, lo que lo convierte en uno de los modelos más eficientes disponibles. Con respecto a la eficiencia de rentabilidad, las implementaciones privadas del Comando A son hasta un 50% más baratas que las alternativas basadas en API, reduciendo significativamente la carga financiera para las empresas. El comando A también sobresale en tareas de seguimiento de instrucciones, consultas basadas en SQL y generación de recuperación acuática (TRAPO) Aplicaciones. Ha demostrado una alta precisión en las evaluaciones de datos empresariales del mundo real, superando a sus competidores en casos de uso comercial multilingüe.

En una comparación directa del desempeño de la tarea empresarial, los resultados de la evaluación humana muestran que el comandar un rendimiento constante supera a sus competidores en fluidez, fidelidad y utilidad de respuesta. Las capacidades preparadas para la empresa del modelo incluyen una generación sólida de recuperación de retiros con citas verificables, uso avanzado de herramientas de agente y medidas de seguridad de alto nivel para proteger datos comerciales confidenciales. Sus capacidades multilingües se extienden más allá de la simple traducción, lo que demuestra una competencia superior en la respuesta con precisión en los dialectos específicos de la región. Por ejemplo, las evaluaciones de los dialectos árabes, incluidos el árabe egipcio, saudita, sirio y marroquí, revelaron que el comando A ofreció respuestas más precisas y contextualmente apropiadas que los principales modelos de IA. Estos resultados enfatizan su fuerte aplicabilidad en entornos empresariales globales donde la diversidad del lenguaje es crucial.

Varias conclusiones clave de la investigación incluyen:

- El comando A opera en solo dos GPU, reduciendo significativamente los costos computacionales al tiempo que mantiene un alto rendimiento.

- Con 111 mil millones de parámetros, el modelo está optimizado para aplicaciones a escala empresarial que requieren un procesamiento de texto extenso.

- El modelo admite una longitud de contexto de 256k, lo que le permite procesar documentos empresariales más largos de manera más efectiva que los modelos competidores.

- El comando A está capacitado en 23 idiomas, asegurando una alta precisión y relevancia contextual para las empresas globales.

- Logra 156 fichas por segundo, 1.75x más alto que GPT-4O y 2.4x más alto que Deepseek-V3.

- El modelo supera constantemente a los competidores en las evaluaciones empresariales del mundo real, sobresaliendo en tareas SQL, agente y basadas en herramientas.

- Las capacidades avanzadas de RAG con citas verificables lo hacen muy adecuado para aplicaciones de recuperación de información empresarial.

- Las implementaciones privadas del comando A pueden ser hasta un 50% más baratas que los modelos basados en API.

- El modelo incluye características de seguridad de grado empresarial, asegurando el manejo seguro de datos comerciales confidenciales.

- Demuestra una alta competencia en los dialectos regionales, lo que lo hace ideal para empresas que operan en regiones lingüísticamente diversas.

Verificar el Modelo en la cara abrazada. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, siéntete libre de seguirnos Gorjeo Y no olvides unirte a nuestro Subreddit de 80k+ ml.

Asif Razzaq es el CEO de MarktechPost Media Inc .. Como empresario e ingeniero visionario, ASIF se compromete a aprovechar el potencial de la inteligencia artificial para el bien social. Su esfuerzo más reciente es el lanzamiento de una plataforma de medios de inteligencia artificial, MarktechPost, que se destaca por su cobertura profunda de noticias de aprendizaje automático y de aprendizaje profundo que es técnicamente sólido y fácilmente comprensible por una audiencia amplia. La plataforma cuenta con más de 2 millones de vistas mensuales, ilustrando su popularidad entre el público.