Los modelos de lenguajes grandes (LLM) se improvisan constantemente gracias a los avances en inteligencia artificial y aprendizaje automático. Los LLM están logrando avances significativos en subcampos de la IA, incluido el procesamiento del lenguaje natural, la comprensión del lenguaje natural, la generación del lenguaje natural y la visión por computadora. Estos modelos se entrenan en conjuntos de datos masivos a escala de Internet para desarrollar modelos generalistas que puedan manejar una variedad de tareas visuales y lingüísticas. El crecimiento se atribuye a la disponibilidad de grandes conjuntos de datos y arquitecturas bien pensadas que pueden escalar eficazmente con los datos y el tamaño del modelo.

Los LLM se han extendido con éxito a la robótica en los últimos tiempos. Sin embargo, aún es necesario lograr un agente encarnado generalista que aprenda a realizar muchas tareas de control a través de acciones de bajo nivel a partir de una gran cantidad de conjuntos de datos no seleccionados. Los enfoques actuales sobre los agentes encarnados generalistas enfrentan dos obstáculos principales, que son los siguientes.

- Supuesto de trayectorias casi expertas: debido a la grave limitación de la cantidad de datos disponibles, muchos métodos existentes para la clonación de comportamiento se basan en trayectorias casi expertas. Esto implica que los agentes son menos flexibles para diferentes tareas, ya que requieren demostraciones de alta calidad y similares a las de expertos para aprender.

- Ausencia de métodos de control continuo escalables: los conjuntos de datos grandes y no seleccionados no pueden manejarse eficazmente mediante varios métodos de control continuo escalables. Muchos de los algoritmos de aprendizaje por refuerzo (RL) existentes se basan en hiperparámetros específicos de tareas y están optimizados para el aprendizaje de una sola tarea.

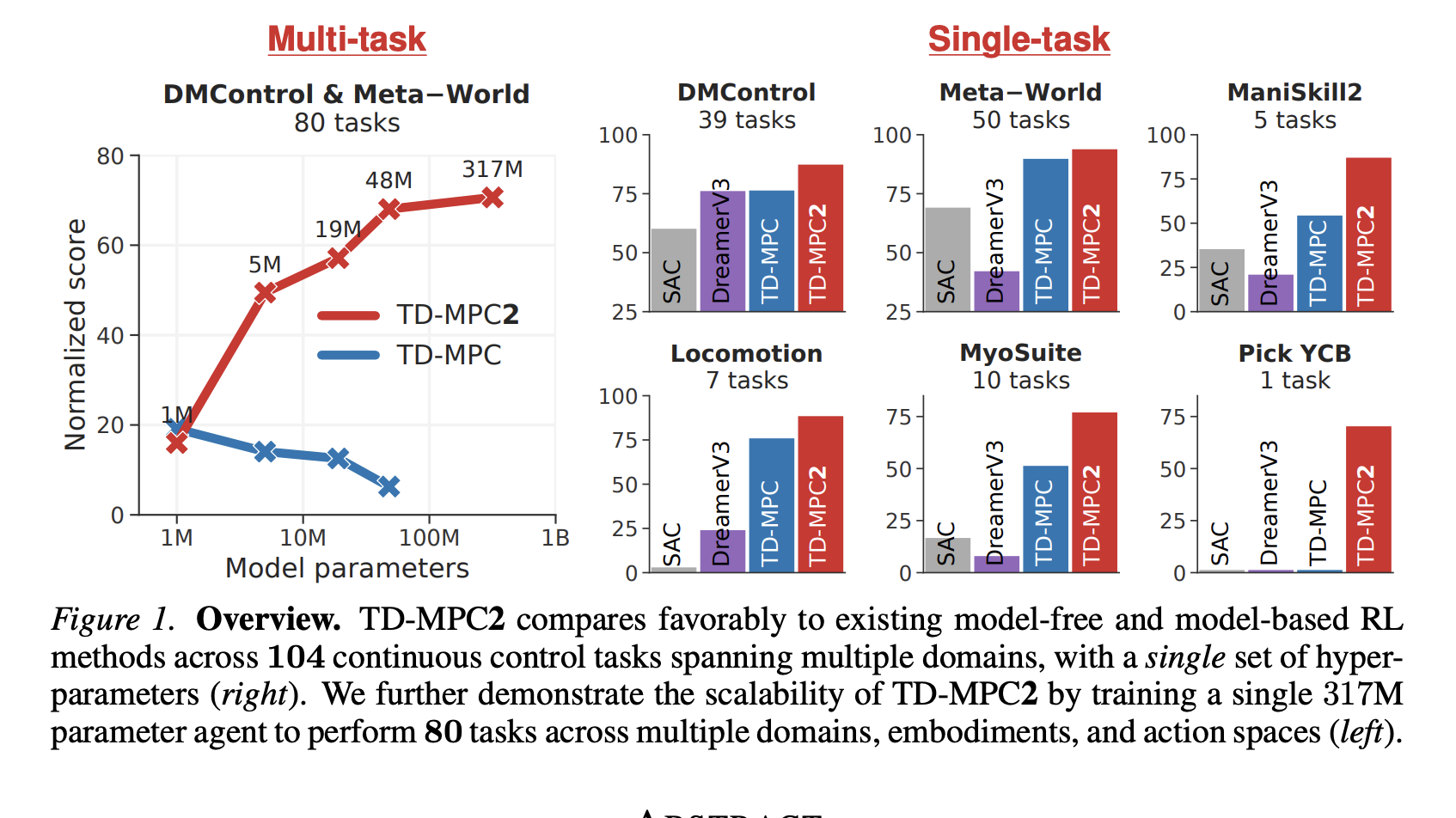

Como solución a estos desafíos, un equipo de investigadores ha introducido recientemente TD-MPC2, una expansión de la familia TD-MPC (Control predictivo del modelo de distribución de trayectoria) de algoritmos RL basados en modelos. Se han utilizado grandes conjuntos de datos no seleccionados que abarcan varios dominios de tareas, realizaciones y espacios de acción para entrenar TD-MPC2, un sistema para construir modelos mundiales generalistas. Una de las características importantes es que no requiere ajuste de hiperparámetros.

Los elementos principales de TD-MPC2 son los siguientes.

- Optimización de trayectoria local en el espacio latente: sin necesidad de un decodificador, TD-MPC2 lleva a cabo una optimización de trayectoria local en el espacio latente de un modelo mundial implícito entrenado.

- Robustez algorítmica: al repasar nuevamente decisiones de diseño importantes, el algoritmo se vuelve más resistente.

- Arquitectura para numerosas realizaciones y espacios de acción: sin requerir experiencia previa en el dominio, la arquitectura se crea cuidadosamente para admitir conjuntos de datos con múltiples realizaciones y espacios de acción.

El equipo ha compartido que, tras la evaluación, TD-MPC2 habitualmente funciona mejor que los enfoques basados y sin modelos que se utilizan actualmente para una variedad de tareas de control continuo. Funciona especialmente bien en subconjuntos difíciles, como tareas de recoger y colocar y de locomoción. Las mayores capacidades del agente demuestran escalabilidad a medida que crecen los tamaños de modelos y datos.

El equipo ha resumido algunas características notables del TD-MPC2, que son las siguientes.

- Rendimiento mejorado: cuando se utiliza en una variedad de tareas de RL, TD-MPC2 proporciona mejoras con respecto a los algoritmos básicos.

- Coherencia con un único conjunto de hiperparámetros: una de las ventajas clave de TD-MPC2 es su capacidad para producir resultados impresionantes con un único conjunto de hiperparámetros de manera confiable. Esto agiliza el procedimiento de ajuste y facilita la aplicación a una variedad de trabajos.

- Escalabilidad: las capacidades del agente aumentan a medida que crecen tanto el modelo como el tamaño de los datos. Esta escalabilidad es esencial para gestionar trabajos más complicados y adaptarse a diversas situaciones.

El equipo ha entrenado a un solo agente con un recuento sustancial de parámetros de 317 millones para realizar 80 tareas, lo que demuestra la escalabilidad y eficacia de TD-MPC2. Estas tareas requieren varias realizaciones, es decir, formas físicas del agente y espacios de acción en múltiples dominios de tareas. Esto demuestra la versatilidad y solidez del TD-MPC2 para abordar una amplia gama de dificultades.

Revisar la Papel y Proyecto. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de 32k+ ML, Comunidad de Facebook de más de 40.000 personas, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

también estamos en Telegrama y WhatsApp.

Tanya Malhotra es estudiante de último año de la Universidad de Estudios de Petróleo y Energía, Dehradun, y cursa BTech en Ingeniería Informática con especialización en Inteligencia Artificial y Aprendizaje Automático.

Es una entusiasta de la Ciencia de Datos con buen pensamiento analítico y crítico, junto con un ardiente interés en adquirir nuevas habilidades, liderar grupos y gestionar el trabajo de manera organizada.