Los modelos de fundaciones multimodales (MFM) como GPT-4O, Géminis y Claude han mostrado un rápido progreso recientemente, especialmente en demostraciones públicas. Si bien sus habilidades lingüísticas están bien estudiadas, su verdadera capacidad para comprender la información visual sigue sin estar clara. La mayoría de los puntos de referencia utilizados hoy en día se centran en gran medida en tareas basadas en texto, como VQA o clasificación, que a menudo reflejan las fortalezas del lenguaje más que las capacidades visuales. Estas pruebas también requieren salidas de texto, lo que dificulta la evaluación de habilidades visuales o comparar MFM con modelos específicos de la visión. Además, los aspectos críticos como la percepción 3D, la segmentación y la agrupación, que son centrales para la comprensión visual, todavía se pasan por alto en gran medida en las evaluaciones actuales.

Los MFM han demostrado un fuerte rendimiento en las tareas que combinan la comprensión visual y del lenguaje, como el subtítulos y la respuesta de las preguntas visuales. Sin embargo, su efectividad en tareas que requieren una comprensión visual detallada sigue sin estar clara. La mayoría de los puntos de referencia actuales se basan en salidas basadas en texto, lo que dificulta la comparación de MFM con los modelos solo de visión de manera justa. Algunos estudios intentan adaptar conjuntos de datos de visión para MFM al convertir las anotaciones en texto, pero esta limitación restringe la evaluación a los resultados del lenguaje. También se han explorado estrategias de solicitación para ayudar a los MFM a abordar las tareas visuales al romperlas en subtareas manejables, aunque la reproducibilidad sigue siendo un desafío en algunos casos.

Los investigadores de EPFL evaluaron varios modelos de fundamento multimodal populares, como GPT-4O, Gemini 2.0 Flash y Claude 3.5 soneto en las tareas centrales de visión por computadora, incluida la segmentación, la detección de objetos y la predicción de profundidad, utilizando conjuntos de datos como Coco e Imagenet. Dado que la mayoría de los MFM están diseñados para emitir texto y solo son accesibles a través de API, desarrollaron un marco de cadena rápida para traducir estas tareas visuales en formatos compatibles con texto. Sus hallazgos muestran que, si bien los MFM son generalistas competentes, no tienen modelos de visión especializados, especialmente en tareas geométricas. GPT-4O se destacó, funcionando mejor en 4 de 6 tareas. El conjunto de herramientas de evaluación será de código abierto.

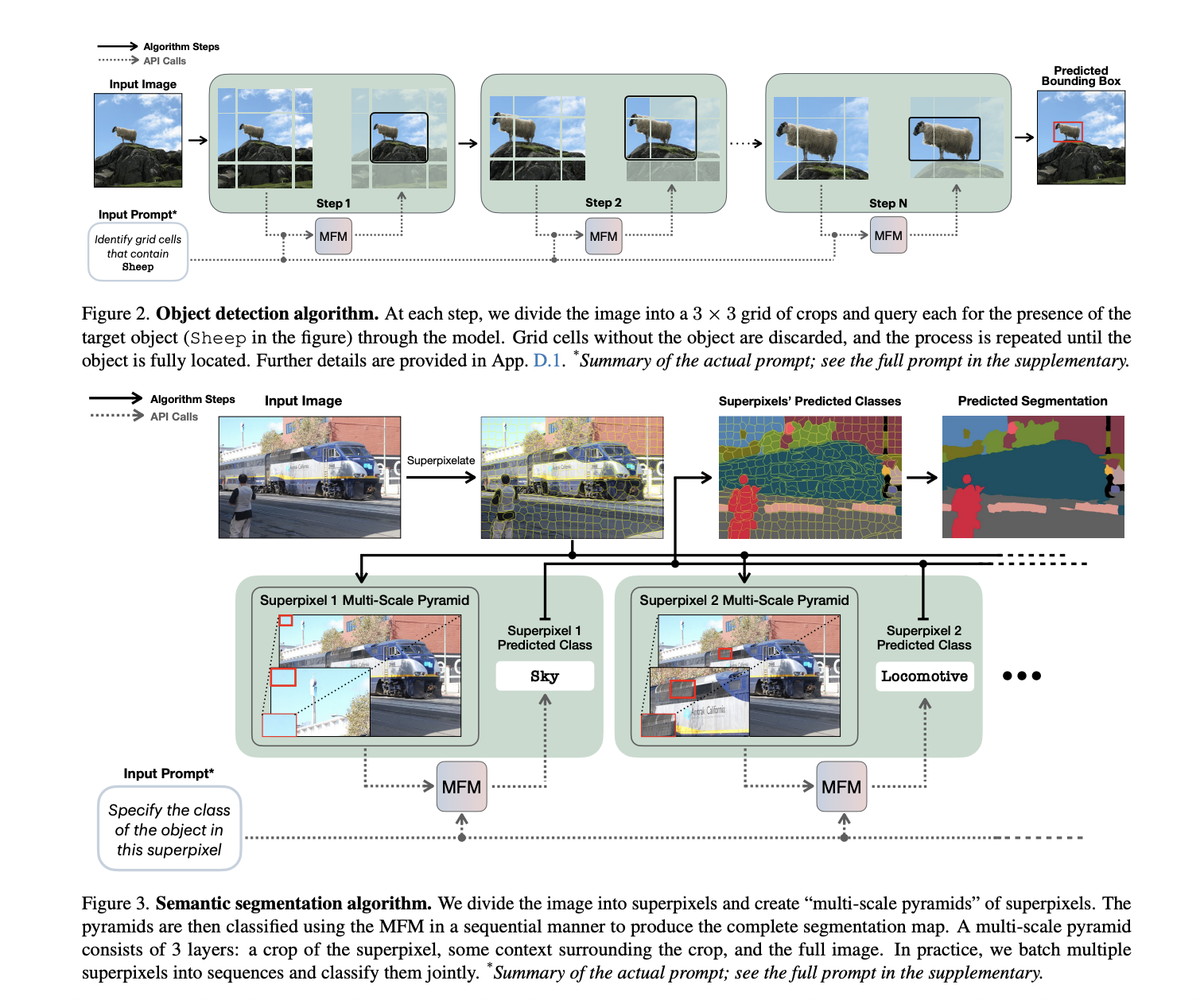

Para evaluar las MFM en tareas de visión, el estudio diseñó una estrategia de encadenamiento rápida, dividiendo tareas complejas en subtareas más simples y amigables con el lenguaje. Por ejemplo, en lugar de predecir las cajas delimitadoras directamente, el modelo identifica primero los objetos presentes, luego los ubica a través del cultivo de imágenes recursivas. Para la segmentación y la agrupación, las imágenes se dividen en superpíxeles, que son más fáciles de etiquetar y comparar. La profundidad y las normales de la superficie se estiman utilizando clasificaciones por pares de regiones de superpíxeles. Este diseño modular aprovecha la fuerza de MFM en la clasificación y similitud, mientras que los controles de calibración aseguran comparaciones justas. El método es flexible y el rendimiento mejora con la solicitud de grano más fino.

El estudio evalúa varios MFM, incluidos GPT-4, Gemini Flash y Claude 3.5, en múltiples tareas, como la clasificación de imágenes, la detección de objetos y la segmentación. El uso de conjuntos de datos como ImageNet, Coco e HyperSim, los resultados muestran que GPT-4O alcanza el 77.2%en Imagenet y 60.62 AP50 para la detección de objetos, superado por modelos especializados como VIT-G (90.94%) y Co-Detr (91.30%). Los resultados de segmentación semántica muestran GPT-4O a 44.89 Miou, mientras que OneFormer lidera con 65.52. Los MFM manejan la distribución de cambios razonablemente bien, pero se retrasa en un razonamiento visual preciso. El estudio también introduce una rápida encadenamiento y líneas de base Oracle para evaluar el rendimiento superior.

En conclusión, el estudio introduce un marco de evaluación comparativa para evaluar las capacidades visuales de las MFM, como GPT-4O, Gemini y Claude, al convertir las tareas de visión estándar en formatos rápidos. Los resultados muestran que los MFM funcionan mejor en tareas semánticas que las geométricas, con GPT-4O liderando en general. Sin embargo, todos los MFM se retrasan significativamente detrás de los modelos de visión específicos de la tarea. A pesar de ser generalistas capacitados principalmente en datos de texto de imagen, muestran un progreso prometedor, especialmente modelos de razonamiento más nuevos, como O3, en tareas 3D. Las limitaciones incluyen un alto costo de inferencia y sensibilidad rápida. Aún así, este marco proporciona un enfoque unificado para evaluar la comprensión visual de MFM, estableciendo las bases para futuros avances.

Mira el Papel, Página de Github y Proyecto. Todo el crédito por esta investigación va a los investigadores de este proyecto.

Conozca el boletín de AI Dev leídos por 40k+ desarrolladores e investigadores de Nvidia, Openai, DeepMind, Meta, Microsoft, JP Morgan Chase, Amgen, Aflac, Wells Fargo y 100 más [SUBSCRIBE NOW]

Sana Hassan, una pasante de consultoría en MarktechPost y estudiante de doble grado en IIT Madras, le apasiona aplicar tecnología e IA para abordar los desafíos del mundo real. Con un gran interés en resolver problemas prácticos, aporta una nueva perspectiva a la intersección de la IA y las soluciones de la vida real.