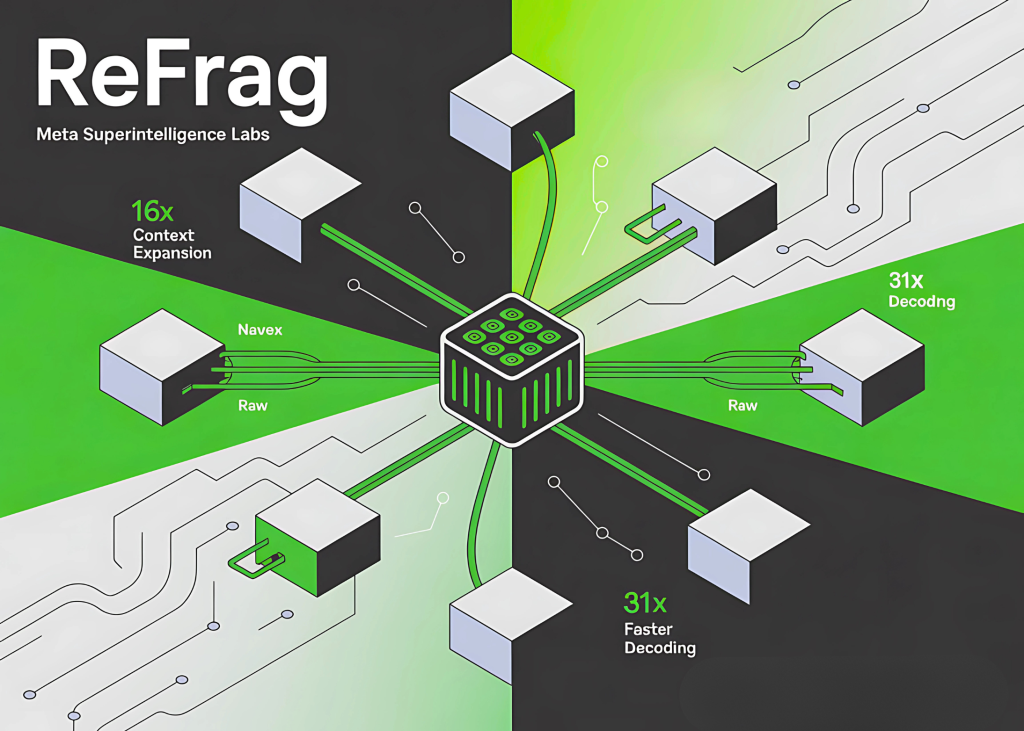

Un equipo de investigadores de Meta Superintelligence Labs, la Universidad Nacional de Singapur y la Universidad de Rice ha presentado Refrag (representación para trapo)un marco de decodificación que reconsidere la eficiencia de generación de recuperación (trapo) de recuperación. Refrag extiende las ventanas de contexto de LLM por 16 × y logra hasta un Aceleración de 30.85 × en el tiempo de primera vez (TTFT) sin comprometer la precisión.

¿Por qué el contexto largo es un cuello de botella para LLM?

El mecanismo de atención en modelos de lenguaje grande escala cuadráticamente con la longitud de entrada. Si un documento es el doble de largo, el costo de cálculo y memoria puede crecer cuatro veces. Esto no solo ralentiza la inferencia, sino que también aumenta el tamaño del caché del valor clave (KV), lo que hace que las aplicaciones de contexto grande sean poco prácticos en los sistemas de producción. En la configuración de RAG, la mayoría de los pasajes recuperados contribuyen poco a la respuesta final, pero el modelo aún paga el precio cuadrático completo para procesarlos.

¿Cómo se comprime y acorta el contexto de refrigio?

Refrag presenta un codificador liviano que divide pasajes recuperados en trozos de tamaño fijo (por ejemplo, 16 fichas) y comprime cada uno en un denso Fragmento de incrustación. En lugar de alimentar miles de tokens crudos, el decodificador procesa esta secuencia más corta de incrustaciones. El resultado es un 16 × Reducción en la longitud de secuenciasin cambios en la arquitectura LLM.

¿Cómo se alcanza la aceleración?

Al acortar la secuencia de entrada del decodificador, el refrigerio reduce el cálculo de atención cuadrática y encoge el caché de KV. Los resultados empíricos muestran 16.53 × aceleración TTFT en K = 16 y 30.85 × Aceleración en K = 32superando con creces el Cepe de estado previo (que logró solo 2–8 ×). El rendimiento también mejora hasta 6.78 × en comparación con las líneas de base de la llama.

¿Cómo se preserva la precisión de refrigerio?

Una política de aprendizaje de refuerzo (RL) supervisa la compresión. Identifica los fragmentos más densos en la información y les permite evitar la compresión, alimentando tokens crudos directamente en el decodificador. Esta estrategia selectiva garantiza que los detalles críticos, como números exactos o entidades raras, no se pierdan. En múltiples puntos de referencia, la perplejidad mantenida o mejorada de refrigeria en comparación con CEPE mientras opera a una latencia mucho más baja.

¿Qué revelan los experimentos?

Refrag fue provocado en tokens 20B del Corpus Slimpajama (libros + ARXIV) y se probó en conjuntos de datos de contexto largo, incluidos Libro, ARXIV, PG19 y Prueba. En puntos de referencia de rag, tareas de conversación de múltiples vueltas y resumen de documentos largos, Refrag superó constantemente las líneas de base fuertes:

- Extensión de contexto 16 × Beyond Standard Llama-2 (tokens 4K).

- ~ 9.3% de mejora de la perplejidad sobre Cepe en cuatro conjuntos de datos.

- Una mejor precisión en la configuración de retriefer débil, donde dominan los pasajes irrelevantes, debido a la capacidad de procesar más pasajes bajo el mismo presupuesto de latencia.

Resumen

Refrag muestra que los LLM de contexto largo no tienen que ser lentos o hambrientos de memoria. Al comprimir los pasajes recuperados en incrustaciones compactas, expandir selectivamente solo los importantes y repensar cómo funciona la decodificación de trapo, los laboratorios de meta superinteligencia han permitido procesar entradas mucho más grandes mientras se ejecutan dramáticamente más rápido. Esto hace que las aplicaciones de gran contexto, como analizar informes completos, manejar conversaciones de giro múltiple o escalar sistemas de trapo empresarial, no solo factibles pero eficientes, sin comprometer la precisión.

Preguntas frecuentes

Q1. ¿Qué es Frag?

Refrag (representación para RAG) es un marco de decodificación de los laboratorios de meta superinteligencia que comprime los pasajes recuperados en incrustaciones, lo que permite una inferencia de contexto más rápido y más largo en LLM.

Q2. ¿Cuánto más rápido es el refrigerador en comparación con los métodos existentes?

Refrag se entrega a 30.85 × Tiempo a primera vez más rápido (TTFT) y 6.78 × Mejora de rendimiento en comparación con las líneas de base de la llama, al tiempo que supera a Cepe.

Q3. ¿La compresión reduce la precisión?

No. Una política de aprendizaje de refuerzo asegura que los fragmentos críticos sigan sin comprimir, preservando los detalles clave. A través de los puntos de referencia, la precisión mantenida o mejorada de refrigeria en relación con los métodos anteriores.

Q4. ¿Dónde estará disponible el código?

Meta Superintelligence Labs lanzará refrigerio en Github en FacebookResearch/Frag

Mira el Papel aquí. No dude en ver nuestro Página de Github para tutoriales, códigos y cuadernos. Además, siéntete libre de seguirnos Gorjeo Y no olvides unirte a nuestro Subreddit de 100k+ ml y suscribirse a Nuestro boletín.

Asif Razzaq es el CEO de MarktechPost Media Inc .. Como empresario e ingeniero visionario, ASIF se compromete a aprovechar el potencial de la inteligencia artificial para el bien social. Su esfuerzo más reciente es el lanzamiento de una plataforma de medios de inteligencia artificial, MarktechPost, que se destaca por su cobertura profunda de noticias de aprendizaje automático y de aprendizaje profundo que es técnicamente sólido y fácilmente comprensible por una audiencia amplia. La plataforma cuenta con más de 2 millones de vistas mensuales, ilustrando su popularidad entre el público.