Desde noviembre de 2020, LÍNEA se ha embarcado en un viaje transformador de investigación y desarrollo para crear y aprovechar el poder de un modelo de lenguaje avanzado a gran escala diseñado específicamente para el idioma japonés. Como un hito significativo en este viaje, la unidad de desarrollo Massive LM de LINE ha anunció el lanzamiento de sus modelos en japonés, “Japanese-large-lm”, como software de código abierto (OSS). Este lanzamiento está preparado para impactar significativamente tanto a la comunidad de investigación como a las empresas que buscan aprovechar los modelos lingüísticos de vanguardia.

Estos modelos de lenguaje vienen en dos variantes: el modelo de 3600 millones (3,6B) de parámetros y el modelo de 1700 millones (1,7B) de parámetros, acertadamente denominado modelo 3,6B y modelo 1,7B. Al revelar estos modelos y compartir sus conocimientos integrales sobre la construcción de modelos de lenguaje, LINE tiene como objetivo brindar un vistazo a las complejidades de su enfoque y contribuir al avance del campo.

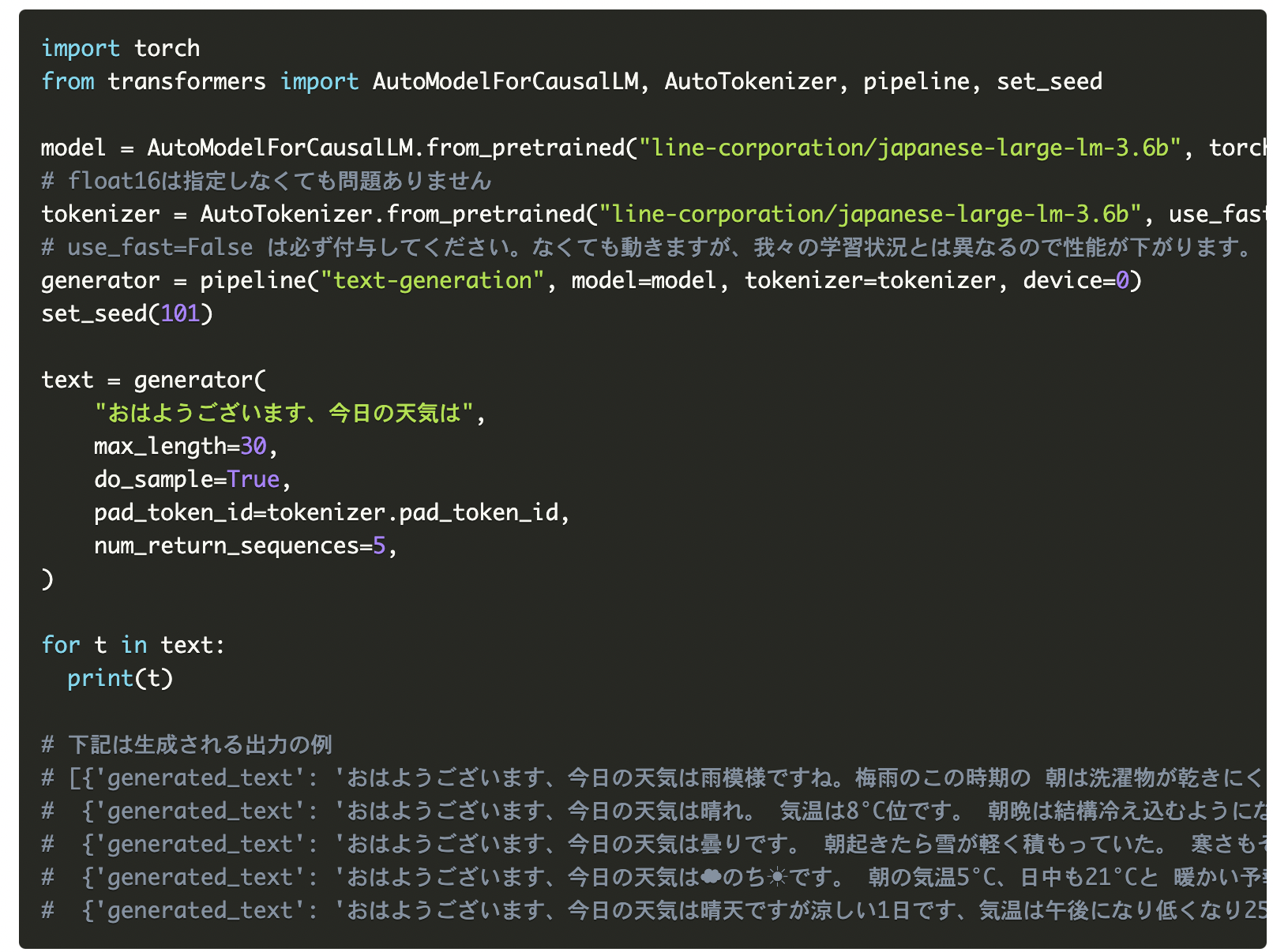

Se puede acceder a los modelos 1.7B y 3.6B a través de HuggingFace Hub (modelo 1.7B, modelo 3.6B), que ofrece una integración perfecta en varios proyectos a través del popular biblioteca de transformadores. La licencia de estos modelos bajo Apache License 2.0 garantiza que un amplio espectro de usuarios, incluidos investigadores y entidades comerciales, puedan aprovechar sus capacidades para diversas aplicaciones.

Una piedra angular en el desarrollo de cualquier modelo de lenguaje de alto rendimiento radica en utilizar un conjunto de datos de entrenamiento extenso y de alta calidad. LINE aprovechó su propio corpus web japonés, un repositorio enriquecido con diversos datos textuales para lograr esto. Sin embargo, el desafío que plantea el contenido derivado de la web es su ruido inherente, incluido el código fuente y las oraciones no japonesas. La respuesta de LINE fue emplear procesos de filtrado meticulosos impulsados por el hoji char biblioteca SSO. Estos procesos fueron fundamentales para destilar un conjunto de datos de alta calidad a gran escala, formando la base de la solidez de los modelos.

La eficiencia en el entrenamiento de modelos fue una consideración clave, y LINE estuvo a la altura de las circunstancias implementando técnicas innovadoras como el paralelismo 3D y Puntos de control de activación. Estos avances facilitaron la asimilación eficiente de datos voluminosos, empujando efectivamente los límites de la capacidad computacional. Sorprendentemente, el modelo 1.7B se desarrolló utilizando solo 4000 horas de GPU en una GPU A100 de 80 GB, un testimonio de la eficacia de su enfoque de aprendizaje.

En particular, la trayectoria de desarrollo de este modelo de idioma japonés divergió de la de HyperCLOVA. Construido a lo largo de una línea de desarrollo distinta, supervisada meticulosamente por la unidad de desarrollo Massive LM dedicada de LINE, este modelo es un testimonio del compromiso de LINE de crear modelos excepcionales previamente entrenados para el idioma japonés. Su objetivo general se mantiene firme: integrar conocimientos y lecciones de su amplia experiencia con modelos de lenguaje a gran escala.

LINE profundizó en las puntuaciones de perplejidad (PPL) y las tasas de precisión para las tareas de comprensión lectora y respuesta a preguntas para evaluar la eficacia de los modelos. PPL proporciona información sobre las capacidades predictivas del modelo, mientras que las tasas de precisión ofrecen medidas de rendimiento tangibles. Los resultados fueron prometedores, con los modelos de LINE mostrando un rendimiento competitivo en varias tareas, rivalizando con los modelos establecidos en el campo.

Apuntalando su éxito hubo una serie de consejos invaluables para el entrenamiento efectivo de modelos de lenguaje a gran escala. Estos abarcan consideraciones para el ajuste fino, el hiperparámetro Adam’s beta2, tasas de aprendizaje óptimas y la aplicación de un programador de tasa de aprendizaje juicioso. Al profundizar en estas complejidades técnicas, LINE ha desarrollado modelos potentes y ha compartido conocimientos que benefician a la comunidad en general.

En conclusión, el lanzamiento de LINE de los modelos de idioma japonés 1.7B y 3.6B marca un avance significativo en el procesamiento del lenguaje natural. Su compromiso de lanzar modelos ajustados en el futuro subraya su dedicación para mejorar las capacidades de los modelos de lenguaje. A medida que LINE continúa avanzando, la comunidad global espera ansiosamente el impacto duradero de sus contribuciones continuas.

Revisar la Artículo de referencia. Todo el crédito de esta investigación es para los investigadores de este proyecto. Además, no olvides unirte nuestro 29k+ ML SubReddit, 40k+ comunidad de Facebook, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias de investigación de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, síguenos en Gorjeo

Niharika es pasante de consultoría técnica en Marktechpost. Ella es una estudiante de tercer año, actualmente cursando su B.Tech del Instituto Indio de Tecnología (IIT), Kharagpur. Es una persona muy entusiasta con un gran interés en el aprendizaje automático, la ciencia de datos y la inteligencia artificial y una ávida lectora de los últimos desarrollos en estos campos.