La necesidad de conjuntos de datos musicales a gran escala con subtítulos en lenguaje natural es una dificultad para la producción de texto a música, que aborda esta investigación. Aunque se encuentran disponibles conjuntos de datos con subtítulos de fuente cerrada, su escasez impide que avance la investigación sobre la creación de texto a música. Para abordar esto, los investigadores sugieren el modelo Music Understanding LLaMA (MU-LLaMA), destinado a subtítulos y respuesta a preguntas musicales. Para ello, utiliza un enfoque para crear muchos pares de preguntas y respuestas musicales a partir de conjuntos de datos de subtítulos de audio que ya están disponibles.

Las técnicas de creación de texto a música que se utilizan actualmente tienen límites y los conjuntos de datos suelen ser de código cerrado debido a restricciones de licencia. Basándose en el modelo LLaMA de Meta y utilizando la arquitectura Music Understanding Encoder-Decoder, un equipo de investigación de ARC Lab, Tencent PCG y la Universidad Nacional de Singapur presentan MU-LLaMA. En particular, el estudio describe cómo se utiliza el modelo MERT como codificador de música, lo que permite que el modelo comprenda la música y responda a consultas. Al crear automáticamente subtítulos para una gran cantidad de archivos de música a partir de recursos públicos, este novedoso método busca cerrar la brecha.

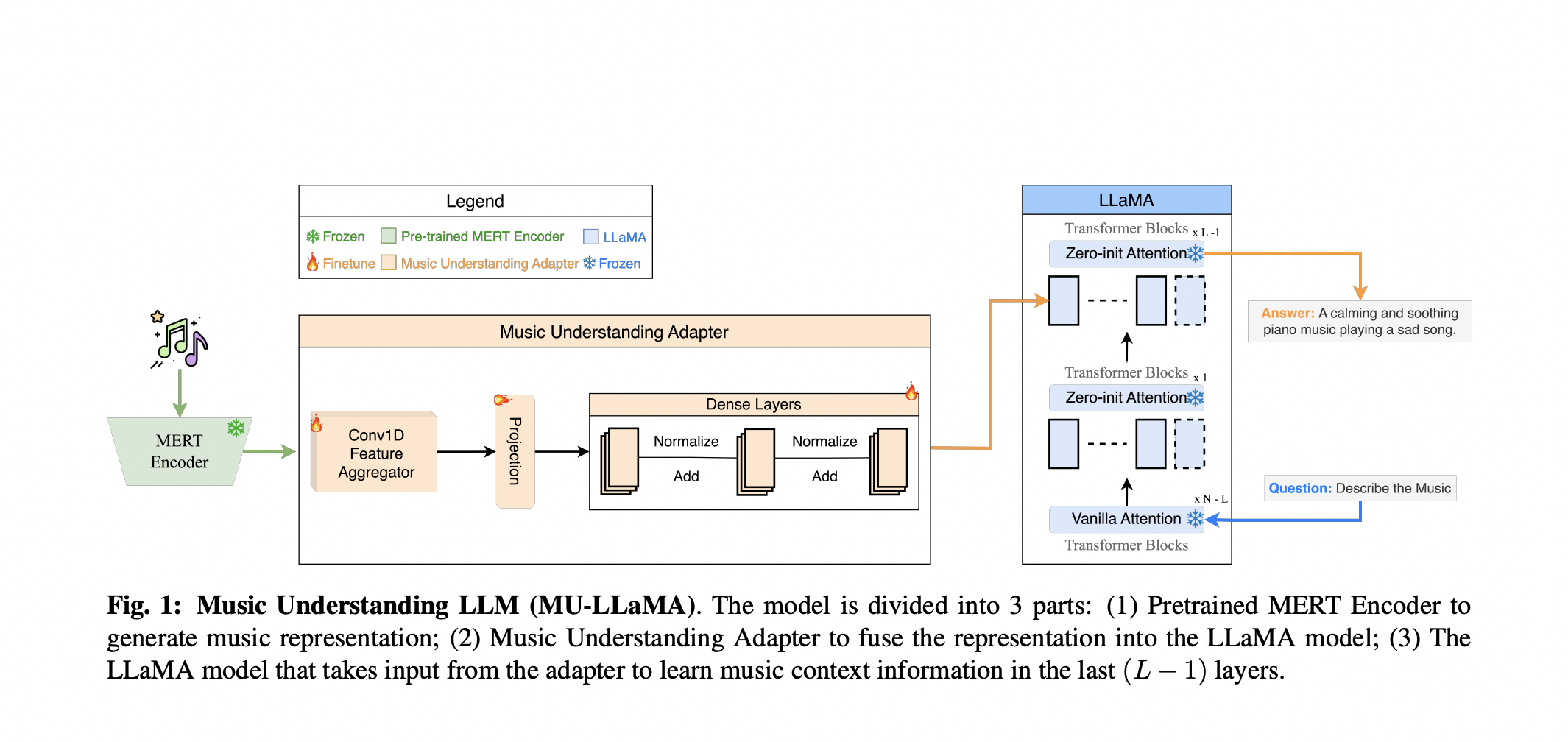

La metodología de MU-LLaMA se basa en una arquitectura bien diseñada, que comienza con un codificador MERT congelado que produce incrustaciones de características musicales. Después de eso, estas incrustaciones son procesadas por una red neuronal gruesa con tres subbloques y una capa convolucional 1D. La capa lineal, la función de activación de SiLU y los componentes de normalización están incluidos en cada subbloque y están conectados mediante conexiones de salto. Las últimas capas (L-1) del modelo LLaMA utilizan la incrustación resultante, que proporciona información de contexto musical crucial para el procedimiento de respuesta a preguntas. El adaptador de comprensión musical se modifica durante el entrenamiento, pero el codificador MERT y las capas Transformer de LLaMA están congeladas. Con este método, MU-LLaMA puede producir subtítulos y responder a consultas basadas en el contexto de la música.

BLEU, METEOR, ROUGE-L y BERT-Score son las principales medidas de generación de texto utilizadas para evaluar el desempeño de MU-LLaMA. Se utilizan dos subtareas principales para probar el modelo: responder preguntas musicales y subtítulos musicales. Se realizan comparaciones con modelos existentes basados en modelos de lenguaje grande (LLM) para abordar cuestiones musicales, específicamente el modelo LTU y el adaptador LLaMA con codificador ImageBind. En cada métrica, MU-LLaMA obtiene mejores resultados que modelos comparables, lo que demuestra su capacidad para responder de forma precisa y contextual a preguntas sobre música. MU-LLaMA tiene competencia de Whisper Audio Captioning (WAC), MusCaps, LTU y LP-MusicCaps en subtítulos musicales. Los resultados destacan la capacidad de MU-LLaMA para producir subtítulos de alta calidad para archivos de música al demostrar su superioridad en los criterios BLEU, METEOR y ROUGE-L.

En conclusión, MU-LLaMA promete abordar los problemas que generan la conversión de texto a música y, al mismo tiempo, demuestra mejoras en la respuesta a preguntas musicales y en los subtítulos. El proceso sugerido para producir numerosos pares de preguntas y respuestas musicales a partir de conjuntos de datos existentes contribuye sustancialmente al tema. El hecho de que MU-LLaMA funcione mejor que los modelos existentes indica que tiene el potencial de cambiar el entorno de generación de texto a música al proporcionar un método confiable y adaptable.

Revisar la Papel y GitHub. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Unirse nuestro SubReddit de más de 35.000 ml, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

Madhur Garg es pasante de consultoría en MarktechPost. Actualmente está cursando su Licenciatura en Ingeniería Civil y Ambiental en el Instituto Indio de Tecnología (IIT), Patna. Comparte una gran pasión por el aprendizaje automático y disfruta explorando los últimos avances en tecnologías y sus aplicaciones prácticas. Con un gran interés en la inteligencia artificial y sus diversas aplicaciones, Madhur está decidido a contribuir al campo de la ciencia de datos y aprovechar su impacto potencial en diversas industrias.