Los avances recientes en los modelos de lenguaje grande (LLM) han impulsado el campo de la interpretación y ejecución de instrucciones. A pesar de estos avances, los LLM todavía enfrentan errores al recordar y componer el conocimiento mundial, lo que genera inexactitudes en las respuestas. Para abordar esto, se ha propuesto la integración de herramientas auxiliares, como el uso de motores de búsqueda o calculadoras durante la inferencia, para mejorar el razonamiento. Sin embargo, los LLM existentes con herramientas mejoradas enfrentan desafíos a la hora de aprovechar eficientemente las herramientas para el razonamiento de varios pasos, particularmente en el manejo de llamadas de herramientas intercaladas y minimizar los tiempos de espera de inferencia.

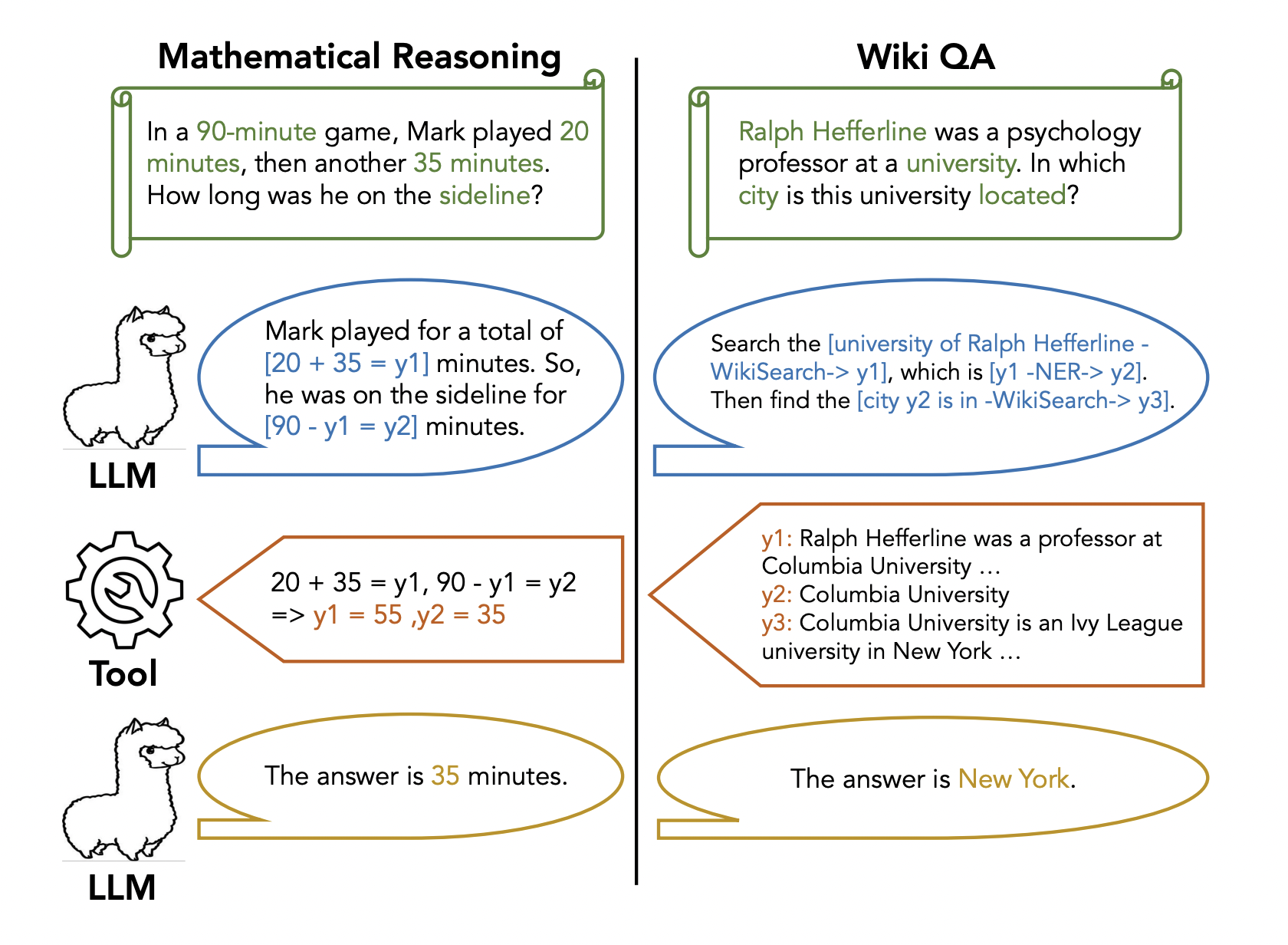

En respuesta a estos desafíos, esta investigación de EPFL y Meta presenta la Cadena de abstracción (CoA) Método de razonamiento, un enfoque sólido y eficiente para que los LLM realicen un razonamiento de varios pasos con herramientas. La idea central se ilustra en la Figura 1, donde los LLM se afinan para crear cadenas de razonamiento con marcadores de posición abstractos (por ejemplo, y1, y2, y3). Posteriormente, estos marcadores de posición se reemplazan con conocimientos específicos obtenidos de herramientas externas, como calculadoras o motores de búsqueda web, cimentando las generaciones de respuestas finales.

Además, a diferencia de los métodos anteriores en los que la decodificación de LLM y las llamadas API se entrelazan, el razonamiento CoA promueve una planificación eficaz al alentar a los LLM a interconectar múltiples llamadas a herramientas y adoptar estrategias de razonamiento más factibles. La cadena abstracta de razonamiento permite a los LLM centrarse en estrategias de razonamiento generales y holísticos sin generar conocimiento específico de la instancia para los parámetros del modelo. En particular, el desacoplamiento del razonamiento general y el conocimiento de un dominio específico permite el procesamiento paralelo, donde los LLM pueden generar la siguiente cadena abstracta mientras las herramientas llenan la cadena actual, acelerando así el proceso de inferencia general.

Para capacitar a los LLM para el razonamiento CoA, los autores construyen datos de ajuste reutilizando conjuntos de datos de respuesta a preguntas de código abierto existentes (Cobbe et al., 2021; Miao et al., 2020; Yang et al., 2018). Se solicita a LLaMa-70B que reescriba las respuestas como cadenas abstractas, reemplazando operaciones específicas con marcadores de posición abstractos. Los seguimientos de CoA resultantes se validan utilizando herramientas especializadas en el dominio para garantizar la precisión.

El método CoA se evalúa en dos dominios: razonamiento matemático y respuesta a preguntas de Wikipedia (Wiki QA). Para el razonamiento matemático, los LLM se entrenan con datos CoA construidos reescribiendo el conjunto de entrenamiento GSM8K (Cobbe et al., 2021). CoA supera las líneas de base de ajuste fino regulares y de pocas tomas en conjuntos de datos tanto dentro como fuera de la distribución, lo que demuestra su eficacia en tareas de razonamiento de varios pasos. El método CoA también demuestra un rendimiento superior en comparación con la línea base de Toolformer.

En el dominio Wiki QA, HotpotQA (Yang et al., 2018) se utiliza para construir datos CoA de ajuste fino. CoA supera las líneas de base, incluido Toolformer, y logra una notable capacidad de generalización en diversos conjuntos de datos de respuesta a preguntas (WebQuestions, NaturalQuestions, TriviaQA). Las herramientas de dominio, como un motor de búsqueda de Wikipedia y un conjunto de herramientas de reconocimiento de entidades nombradas, mejoran aún más el rendimiento de CoA.

Los resultados de la evaluación en ambos dominios indican mejoras significativas con el método CoA, lo que produce un aumento de precisión promedio de aproximadamente 7,5% y 4,5% para el razonamiento matemático y Wiki QA, respectivamente. Estas mejoras se mantienen en los conjuntos de pruebas dentro y fuera de la distribución, beneficiando particularmente las preguntas que requieren un razonamiento complejo en cadena de pensamiento. CoA también muestra velocidades de inferencia más rápidas, superando a los métodos de aumento anteriores en razonamiento matemático y tareas de control de calidad de Wiki.

En conclusión, el método de razonamiento CoA propuesto separa el razonamiento general del conocimiento de dominio específico, fomentando un razonamiento de varios pasos más sólido en los LLM. Su eficiencia en el uso de herramientas contribuye a una inferencia más rápida, lo que lo convierte en un enfoque prometedor para diversos escenarios de razonamiento. Los experimentos sobre razonamiento matemático y Wiki QA subrayan la versatilidad y eficacia del método CoA, lo que sugiere su potencial para aplicaciones más amplias para mejorar el rendimiento de LLM en diversos dominios.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 36k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

Vineet Kumar es pasante de consultoría en MarktechPost. Actualmente está cursando su licenciatura en el Instituto Indio de Tecnología (IIT), Kanpur. Es un entusiasta del aprendizaje automático. Le apasiona la investigación y los últimos avances en Deep Learning, Computer Vision y campos relacionados.