Los modelos de lenguajes grandes (LLM) con cientos de miles de millones de parámetros han mejorado significativamente el rendimiento en diversas tareas. El ajuste de los LLM en conjuntos de datos específicos mejora el rendimiento en comparación con las indicaciones durante la inferencia, pero genera altos costos debido al volumen de parámetros. La adaptación de rango bajo (LoRA) es un método popular de ajuste eficiente de parámetros para LLM, pero actualizar los pesos de los bloques LoRA de manera eficiente es un desafío debido a la larga ruta de cálculo del modelo.

Se han propuesto varios métodos de ajuste eficiente de parámetros (PEFT) para abordar este problema. Los métodos PEFT congelan todos los parámetros en el modelo original y solo ajustan algunos en los módulos recién agregados. Entre ellos, uno de los métodos PEFT más populares es LoRA. LoRA congela la mayoría de los parámetros en el modelo original y solo actualiza algunos en los módulos agregados. Emplea una adaptación de bajo rango, fusionando matrices paralelas a capas lineales congeladas durante la inferencia. Sin embargo, el largo camino hacia atrás de LoRA plantea desafíos. La integración de LoRA con ResNet y Transformers introduce complejidades de diseño, lo que afecta el flujo de gradiente durante el entrenamiento.

Investigadores de la Escuela de Ingeniería y Ciencias de la Computación de la Universidad de Beihang, Beijing, China, y Microsoft han presentado ResLoRA, un marco mejorado de LoRA. ResLoRA consta principalmente de dos partes: bloques ResLoRA y enfoques de fusión. Los bloques ResLoRA agregan rutas residuales a los bloques LoRA durante el entrenamiento, mientras que los enfoques combinados convierten ResLoRA en bloques LoRA durante la inferencia. Los investigadores también afirmaron que, hasta donde saben, ResLoRA es el primer trabajo que combina la ruta residual con LoRA.

Diseñaron tres bloques inspirados en ResNet: acceso directo de entrada, acceso directo de bloque y acceso directo medio, agregando rutas residuales a los bloques LoRA. Estas estructuras tienen como objetivo optimizar el flujo de gradiente durante el entrenamiento y son esenciales para un ajuste eficiente de los parámetros. Surge un problema importante cuando ResLoRA introduce una estructura no simple, a diferencia de LoRA, que se fusiona perfectamente con capas lineales. Para abordar este problema, han diseñado un enfoque de fusión. Para estructuras de atajos de bloques, la fusión se basa en los pesos de los bloques anteriores. La precisión de los factores de escala, determinada mediante normas de Frobenius, garantiza una fusión precisa de los modelos. Dos enfoques, basados en pesos de entrada y de bloque, facilitan una integración perfecta y minimizan la latencia en la inferencia.

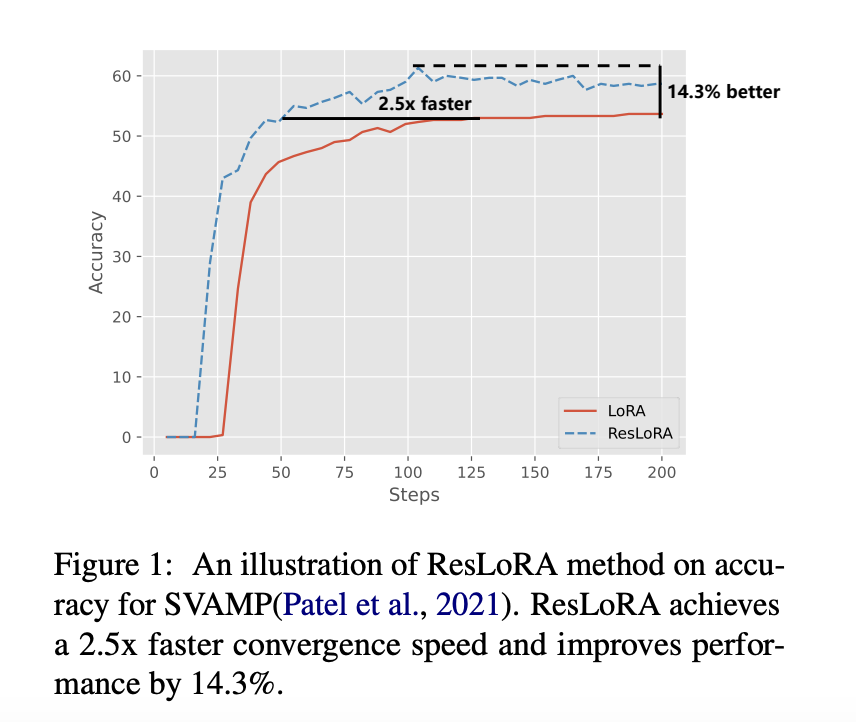

En extensos experimentos que abarcan la generación y comprensión del lenguaje natural (NLG) (NLU), ResLoRA supera a las variantes de LoRA como AdaLoRA, LoHA y LoKr. ResLoRA y ResLoRAbs superan consistentemente a LoRA en los puntos de referencia NLG y NLU, mostrando mejoras en la precisión que van del 10,98 % al 36,85 %. ResLoRA también demostró un entrenamiento más rápido y una calidad de generación de imágenes superior que LoRA en la tarea de conversión de texto a imagen.

Para concluir, investigadores de la Escuela de Ingeniería y Ciencias de la Computación de la Universidad de Beihang, Beijing, China, y Microsoft presentaron ResLoRA., un marco mejorado para LoRA. ResLoRA introduce rutas residuales durante el entrenamiento y emplea enfoques de fusión para eliminar rutas durante la inferencia. Supera al LoRA original y a otros métodos básicos en tareas de NLG, NLU y de conversión de texto a imagen. Los resultados confirman La eficacia de ResLoRA, logrando resultados superiores con menos pasos de entrenamiento y sin parámetros entrenables adicionales.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 38k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

También te puede gustar nuestro Cursos GRATUITOS de IA….

Asjad es consultor interno en Marktechpost. Está cursando B.Tech en ingeniería mecánica en el Instituto Indio de Tecnología, Kharagpur. Asjad es un entusiasta del aprendizaje automático y el aprendizaje profundo que siempre está investigando las aplicaciones del aprendizaje automático en la atención médica.