Los modelos de lenguaje grande (LLM) y potentes codificadores de visión se combinan para crear modelos de lenguaje-visión grande (LVLM). Modelos como GPT-4 y otros grandes sistemas de modelos de visión y lenguaje han demostrado una competencia sobresaliente en tareas que involucran imágenes del mundo real de situaciones naturales, lo que marca un desarrollo significativo en el campo de la Inteligencia Artificial (IA).

Estos modelos híbridos demuestran una combinación notable de habilidades perceptivas y cognitivas que evocan la cognición humana, demostrando una capacidad notable para interpretar e interactuar con imágenes del mundo real. Pero incluso con su amplia gama de talentos, los LVLM han tenido dificultades para manejar ideas abstractas, especialmente en disciplinas como la física y las matemáticas que requieren un mayor grado de razonamiento abstracto. Esta limitación se debe principalmente al hecho de que durante sus períodos de entrenamiento, no estuvieron expuestos a datos especializados y específicos de un dominio, en particular datos que incluían figuras abstractas y complicadas que se encuentran con frecuencia en la literatura científica.

La eficacia de los LVLM disminuye en imágenes abstractas, incluidas formas geométricas y gráficos científicos intrincados. Esta deficiencia se debe principalmente al hecho de que históricamente el dominio científico no ha estado bien representado en los conjuntos de datos utilizados para entrenar estos modelos, lo que ha dejado una brecha de aprendizaje que afecta la capacidad de los modelos para comprender y razonar sobre material científico abstracto.

Para abordar esto, un equipo de investigadores ha introducido una nueva estrategia llamada Multimodal ArXiv, que es un gran esfuerzo para mejorar la comprensión del material científico por parte de los LVLM. Esto hace uso de la abundancia de datos disponibles en el repositorio arXiv, que es conocido por tener una biblioteca considerable de preimpresiones académicas en varios campos científicos.

La creación de ArXivCap, un extenso conjunto de datos con cifras científicas bien elegidas y leyendas informativas, es el proyecto central de este esfuerzo. A diferencia de conjuntos de datos anteriores que utilizaban figuras de IA o estaban restringidos a tareas simples de subtítulos relacionadas con la informática, ArXivCap proporciona una colección más rica y variada de figuras académicas reales de una amplia gama de disciplinas científicas. Preserva la integridad estructural de las subfiguras e incorpora los títulos de los artículos originales, con 6,4 millones de imágenes y 3,9 millones de títulos procedentes de 572.000 publicaciones, lo que lo convierte en una base sólida para una variedad de tareas de evaluación.

Para aumentar aún más la utilidad de este conjunto de datos, se produjo una gran colección de 100.000 combinaciones de preguntas y respuestas de opción múltiple que se crearon, especialmente para las figuras en ArXivCap, utilizando GPT-4V. Con desafíos específicos que imitan entornos de resolución de problemas científicos del mundo real, se espera que esta característica, llamada ArXivQA, desempeñe un papel vital en la mejora de las capacidades de razonamiento científico de los LVLM.

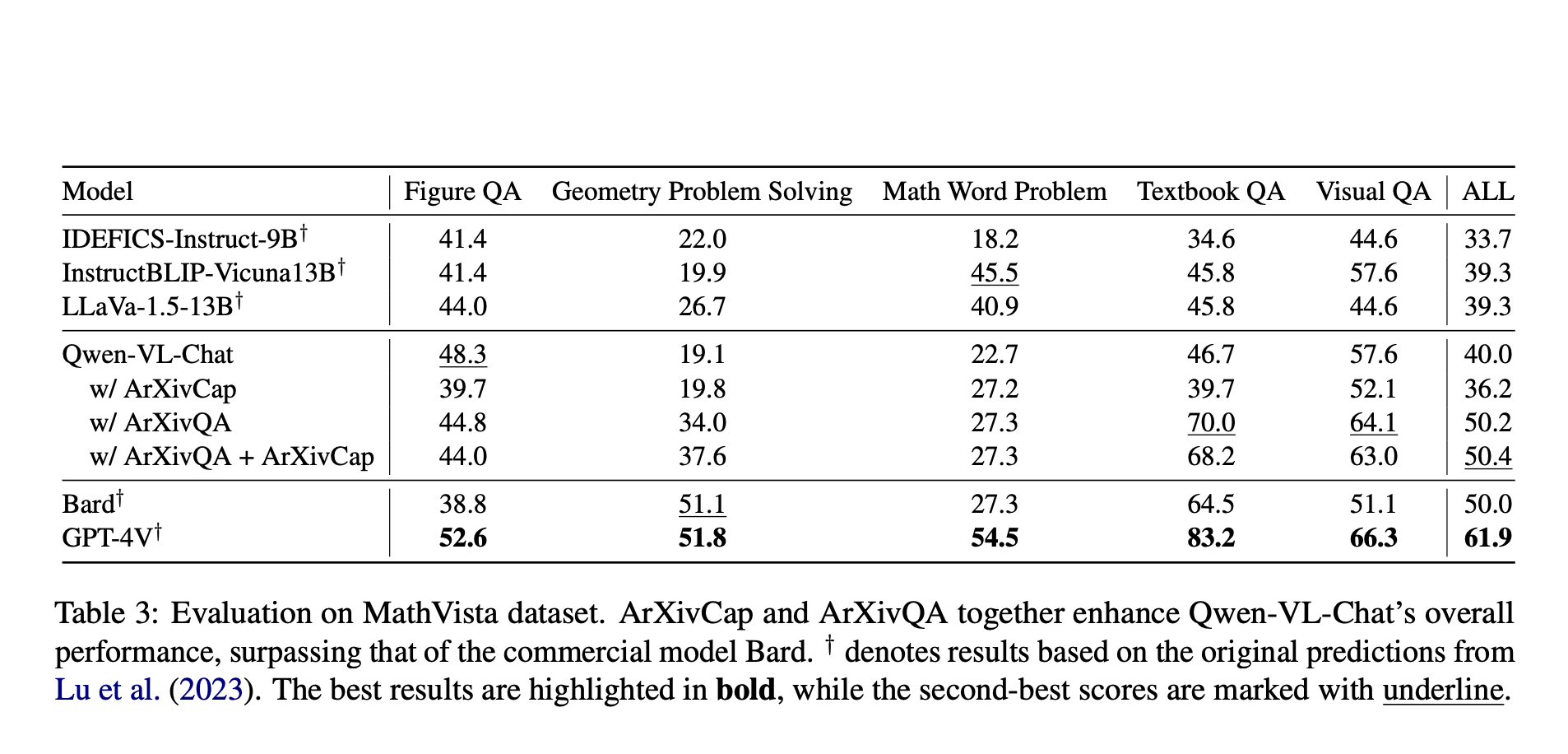

El equipo ha compartido que la eficacia del enfoque Multimodal ArXiv se ha examinado exhaustivamente, con evaluaciones centradas en dos métricas de rendimiento principales: la capacidad de razonamiento de los modelos, como lo demuestra su precisión en las tareas de respuesta a preguntas, y su capacidad generativa, como se demuestra en Tareas similares a la generación de subtítulos. Se han obtenido importantes mejoras de rendimiento gracias a la adición del conjunto de datos ArXivQA, como se ve en un aumento notable en la precisión en MathVista, un punto de referencia creado especialmente para evaluar las habilidades de razonamiento matemático multimodal. Esto destaca cómo la capacitación en un dominio específico puede mejorar significativamente el rendimiento de LVLM.

El estudio de ArXivCap ha facilitado la creación de otros cuatro desafíos generativos, todos los cuales tienen diferentes niveles de dificultad y están destinados a evaluar qué tan bien los modelos pueden comprender y expresar ideas científicas en el lenguaje. Estas actividades pueden ser tan simples como subtitular una sola figura o tan sofisticadas como crear resúmenes y títulos basados en pares de figura y leyenda. Pruebas exhaustivas, incluidas evaluaciones de modelos propietarios y de código abierto como GPT-4V y Bard, han demostrado que, si bien el entrenamiento específico en el conjunto de datos ArXivCap produce mejoras significativas, los LVLM actuales todavía tienen dificultades para interpretar y describir cifras científicas con precisión.

El equipo ha compartido que las evaluaciones de errores manuales han demostrado que los LVLM todavía tienen dificultades con algunos aspectos de la comprensión visual y la producción de subtítulos, como interpretaciones erróneas del contexto visual, reconocimiento inexacto y una inclinación a simplificar los subtítulos generados. Estos resultados muestran dónde se han logrado avances y señalan el camino a seguir para futuros estudios que intentarán superar los obstáculos restantes para ayudar a los LVLM a comprender el contenido científico más profundamente.

Revisar la Papel y Proyecto. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 38k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

También te puede gustar nuestro Cursos GRATUITOS de IA….

Tanya Malhotra es estudiante de último año de la Universidad de Estudios de Petróleo y Energía, Dehradun, y cursa BTech en Ingeniería Informática con especialización en Inteligencia Artificial y Aprendizaje Automático.

Es una entusiasta de la Ciencia de Datos con buen pensamiento analítico y crítico, junto con un ardiente interés en adquirir nuevas habilidades, liderar grupos y gestionar el trabajo de manera organizada.