Los modelos de lenguaje actuales son asombrosamente brillantes… para los generalistas. Pregúnteles sobre historia, ciencia o actualidad; Lo deslumbrarán con muchos datos y conocimientos. Pero cuando se trata de temas especializados y específicos. Ahí es donde incluso el cerebro de IA más poderoso puede volverse un poco confuso.

Imagínese que es un médico que intenta obtener ayuda para investigar una afección médica poco común. O un abogado que busca sentencias sobre una cuestión jurídica oscura. Los modelos de lenguaje típicos necesitan un conocimiento del dominio más profundo. Es como pedirle a un estudiante sobresaliente que evalúe la física cuántica: son brillantes, pero no tanto.

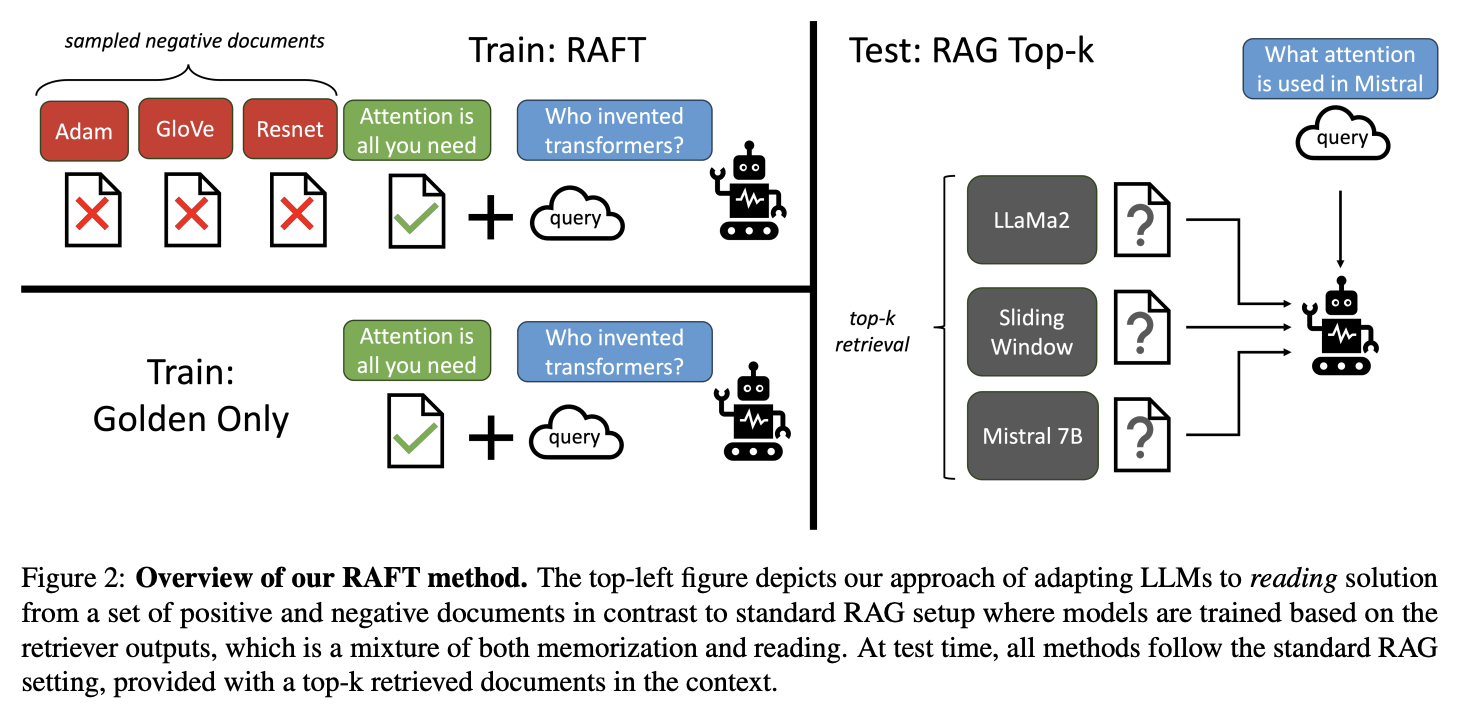

Un equipo de investigadores de UC Berkeley propone introducir RAFT (Retrieval Augmented Fine Tuning), un nuevo enfoque ingenioso que podría ser la Piedra Rosetta para traducir entre IA generalizada y experiencia hiperespecífica. Es una manera de llenar esos modelos de lenguaje altamente capaces pero generalistas con documentación y conocimiento especializado. Si bien herramientas como GPT-3 deslumbran con sus amplias capacidades, su rendimiento se vuelve inestable cuando se requieren conocimientos de un dominio específico. Los métodos tradicionales, como el aumento de recuperación, permiten que los modelos hagan referencia a documentos, pero no los optimizan para el dominio de destino. El ajuste supervisado los expone a datos de dominio pero carece de conexión con evidencia recuperable.

RAFT combina lo mejor de ambos mundos a través de un novedoso proceso de capacitación que imita un entorno de “examen a libro abierto”:

1) Se entrena en pares pregunta-respuesta del dominio especializado.

2) Pero también recibe indicaciones similares a las de una prueba con una combinación de documentos “oracle” relevantes y documentos “distractores” irrelevantes.

3) Aprender a examinar todo eso, citar citas pertinentes y desarrollar un razonamiento de “cadena de pensamiento” de varios pasos.

Utilizando distractores y evidencia obtenida, RAFT entrena de manera efectiva modelos de lenguaje en comprensión de dominios y habilidades de enfoque. Cuando se evaluó en términos de referencia de codificación, biomedicina y respuesta general a preguntas, RAFT demostró mejoras dramáticas con respecto a los enfoques de ajuste tradicionales.

Los resultados de la evaluación demuestran la clara superioridad de RAFT sobre las líneas de base existentes en una variedad de dominios especializados. Cuando se probó en conjuntos de datos como literatura biomédica de PubMed, preguntas generales de HotpotQA y puntos de referencia de codificación como HuggingFace y TorchHub, RAFT superó consistentemente a los modelos de lenguaje estándar y los métodos de ajuste específicos de dominio. En comparación con el modelo base LLaMA2, RAFT exhibió ganancias espectaculares, mejorando en un asombroso 35,25 % en HotpotQA y un 76,35 % en la evaluación de codificación TorchHub. También superó significativamente los enfoques de ajuste específico de dominio, aumentando el rendimiento en un 30,87 % en HotpotQA y un 31,41 % en los conjuntos de datos de HuggingFace en comparación con esos métodos. Incluso frente al potente GPT-3.5, RAFT demostró una clara ventaja a la hora de aprovechar el contexto proporcionado y el conocimiento del dominio para resolver preguntas especializadas con precisión. Los resultados resaltan la eficacia de RAFT para dotar a los modelos de lenguaje de una comprensión adecuada del tema en todos los dominios técnicos.

Más que un simple progreso incremental, RAFT representa un cambio de paradigma en el desbloqueo del dominio del dominio para la IA del lenguaje. Estamos hablando de asistentes digitales y chatbots que pueden guiarte de forma experta en todo, desde la genética hasta la cocina gourmet.

Si bien los modelos de lenguaje actuales son poderosos generalistas, RAFT ofrece un camino hacia una verdadera especialización en IA y experiencia en la materia. Combinado con su razonamiento general existente, esto podría abrir nuevas fronteras sin precedentes en industrias como la atención médica, el derecho, la ciencia y el desarrollo de software.

Al unir las fortalezas del razonamiento general y la experiencia específica, RAFT despeja el camino hacia un futuro en el que la IA del lenguaje trascienda de ser “expertos en todos los oficios” para convertirse en verdaderas autoridades en la materia. Es un paso fundamental en la creación de una inteligencia artificial que iguale o supere el dominio humano en todos los dominios de conocimiento imaginables.

Revisar la Papel y Github. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Únete a nuestro Canal de telegramas, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro SubReddit de 38k+ ML

Vibhanshu Patidar es pasante de consultoría en MarktechPost. Actualmente cursa una licenciatura en el Instituto Indio de Tecnología (IIT) Kanpur. Es un entusiasta de la robótica y el aprendizaje automático con una habilidad especial para desentrañar las complejidades de los algoritmos que unen la teoría y las aplicaciones prácticas.