Recientemente, ha habido un desempeño notable en tareas clínicas de preguntas y respuestas (QA) por parte de modelos de lenguaje grandes (LLM) como Med-PaLM 2 y GPT-4. Por ejemplo, Med-PaLM 2 produjo respuestas a preguntas de salud de los consumidores que eran competitivas con las de los médicos humanos, y un sistema basado en GPT-4 logró el 90,2 % en la tarea MedQA. Pero estos modelos tienen muchos problemas. Son costosos de entrenar y operar y ecológicamente insostenibles porque sus recuentos de parámetros pueden llegar a miles de millones, lo que requiere clústeres informáticos dedicados. Los investigadores sólo pueden acceder a estos grandes modelos a través de una API paga. Por lo tanto, los investigadores y profesionales no pueden analizar estos modelos, y sólo las personas que tienen acceso a los pesos y la arquitectura del modelo pueden investigar mejoras.

Un enfoque nuevo y prometedor, conocido como IA en el dispositivo o IA perimetral, utiliza dispositivos locales como teléfonos o tabletas para ejecutar modelos de lenguaje. Esta tecnología tiene un inmenso potencial en biomedicina y ofrece soluciones como la difusión de información médica después de eventos catastróficos o en áreas con servicio de Internet limitado o nulo. A pesar de los desafíos que plantean su tamaño y su naturaleza cerrada, modelos como GPT-4 y Med-PaLM 2 pueden adaptarse para la IA en el dispositivo, abriendo nuevas vías para la investigación y aplicación en el campo.

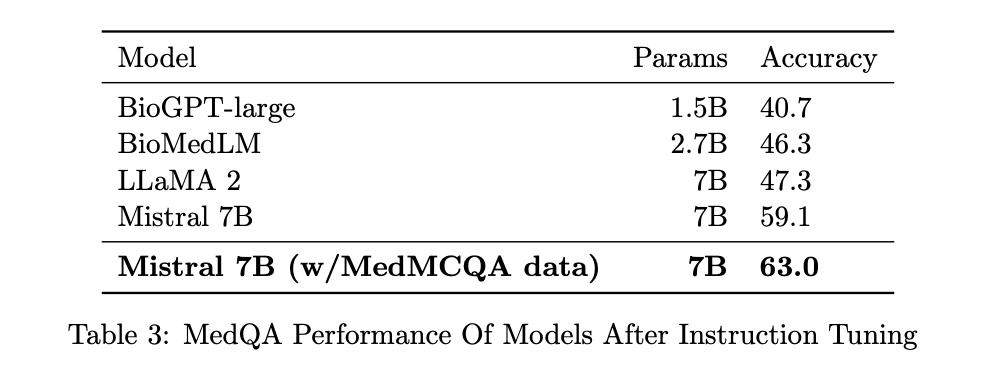

En un contexto biomédico, son aplicables dos tipos de modelos. Solo se utilizó texto biomédico de PubMed para entrenar modelos específicos de dominio más pequeños (<3B parámetros) como BioGPT-large y BioMedLM. Los modelos de parámetros 7B más grandes, como LLaMA 2 y Mistral 7B, son más potentes que sus homólogos más pequeños. Sin embargo, fueron capacitados en textos amplios en inglés y no tenían un enfoque biológico. Aún está en el aire qué tan bien funcionan estos modelos y cuál es el más adecuado para aplicaciones clínicas de control de calidad.

Para garantizar hallazgos completos y confiables, un equipo de investigadores de la Universidad de Stanford, el University College de Londres y la Universidad de Cambridge realizaron una evaluación rigurosa de los cuatro modelos en el dominio de control de calidad clínico. Utilizaron dos tareas populares, MedQA (preguntas similares a las del USMLE) y MultiMedQA Long Form Answering (respuesta abierta a consultas de salud de los consumidores), que evalúan la capacidad de comprender y razonar sobre escenarios médicos y escribir párrafos informativos respondiendo a preguntas de salud.

La actividad de cuatro opciones de MedQA es similar al USMLE en que formula una pregunta con cuatro respuestas posibles. Esta prueba comúnmente evalúa la capacidad de un modelo de lenguaje para utilizar información médica y razonar sobre situaciones clínicas. Algunas preguntas pueden buscar información médica particular (como síntomas de esquizofrenia), mientras que otras pueden plantear un escenario clínico y solicitar el mejor diagnóstico o el siguiente paso (como, “Un hombre de 27 años presenta…”).

Hay 1273 casos de prueba, 10178 instancias de capacitación y 1272 ejemplos de desarrollo en el conjunto de datos de MedQA. Para cada ejemplo se proporcionó una respuesta rápida y esperada. A los cuatro modelos se les enseñó a usar el mismo mensaje y ofrecer la misma respuesta, solo la palabra “Respuesta:” acompañada de la letra que representa la elección correcta. Comparación de modelos de cuatro vías Al actualizar todos sus parámetros, los cuatro modelos se ajustaron utilizando las 10178 instancias de entrenamiento. Los investigadores utilizaron el mismo formato, datos de entrenamiento y código de entrenamiento para todos los modelos para asegurarse de poder compararlos de manera justa. Para conseguir que los modelos fueran perfectos, utilizaron el paquete Hugging Face.

Al fusionar los datos de entrenamiento de MedQA con el conjunto de entrenamiento MedMCQA más grande, que incluye 182822 ejemplos más, se ajustó el modelo de mayor rendimiento (Mistral 7B), lo que permitió a los investigadores profundizar en las capacidades de los modelos de tamaño mediano. Las investigaciones han demostrado que el uso de estos datos para la formación mejora el rendimiento de MedQA. En esta etapa, entrenaron el modelo para producir la carta correcta y el texto completo de la respuesta mediante una solicitud algo más compleja. Se utilizó un barrido de hiperparámetros comparable para encontrar los valores óptimos. Recuerde que el objetivo principal de estas pruebas era optimizar el rendimiento del Mistral 7B en lugar de proporcionar una evaluación precisa de los modelos de la competencia.

Para entrenar el modelo para el trabajo de respuesta a preguntas de formato largo de MultiMedQA, los investigadores lo alimentaron con consultas relacionadas con la salud que los usuarios suelen enviar a los motores de búsqueda. Tres conjuntos de datos (LiveQA, MedicationQA y HealthSearchQA) contribuyen a las cuatro mil preguntas. LiveQA también incluye respuestas a preguntas frecuentes. De manera similar a una respuesta a una página de preguntas frecuentes relacionadas con la salud, se prevé que el sistema produzca una respuesta detallada de uno o dos párrafos. El conjunto completo de preguntas cubre enfermedades infecciosas, enfermedades crónicas, deficiencias dietéticas, salud reproductiva, problemas de desarrollo, uso de medicamentos, interacciones farmacéuticas, medidas preventivas y una serie de otros temas de salud del consumidor.

Estos hallazgos tienen implicaciones prácticas para el campo de la biomedicina. Mistral 7 B obtuvo el mejor rendimiento en ambas pruebas, lo que demuestra su potencial para tareas de respuesta a preguntas clínicas. BioMedLM, aunque menos voluminoso que las versiones 7B, también mostró un rendimiento respetable. Para aquellos con recursos computacionales, BioGPT-large puede proporcionar resultados satisfactorios. Sin embargo, los investigadores notaron que los modelos de dominio específico obtuvieron peores resultados en ambas tareas que los modelos a mayor escala entrenados en inglés genérico, que podrían haber incorporado el corpus PubMed. La cuestión de si un modelo de especialidad biomédica más grande superaría significativamente a Mistral 7B sigue abierta, lo que destaca la necesidad de una revisión médica experta de los resultados del modelo antes de su aplicación clínica.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Únete a nuestro Canal de telegramas, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro SubReddit de más de 40.000 ml

Dhanshree Shenwai es ingeniero en informática y tiene una buena experiencia en empresas de tecnología financiera que cubren el ámbito financiero, tarjetas y pagos y banca con un gran interés en las aplicaciones de IA. Le entusiasma explorar nuevas tecnologías y avances en el mundo en evolución de hoy que facilita la vida de todos.