Los LLM han demostrado capacidades impresionantes en el manejo de tareas complejas de preguntas y respuestas, respaldadas por avances en arquitecturas de modelos y métodos de entrenamiento. Las técnicas como la incitación por cadena de pensamiento (CoT) han ganado popularidad para mejorar la explicación y precisión de las respuestas al guiar al modelo a través de pasos de razonamiento intermedios. Sin embargo, la incitación por CoT puede dar como resultado resultados más largos, lo que aumenta el tiempo necesario para la generación de respuestas debido al proceso de decodificación palabra por palabra de los transformadores autorregresivos. Esto crea desafíos para mantener conversaciones interactivas, lo que resalta la necesidad de métricas para evaluar la concisión de los resultados y estrategias para reducir las cadenas de razonamiento demasiado largas.

Investigadores del Departamento de Excelencia en Robótica e IA de la Scuola Superiore Sant’Anna y Mediavoice Srl analizaron cómo la longitud de salida afecta el tiempo de inferencia de LLM. Propusieron nuevas métricas para evaluar la concisión y la corrección. Introdujeron una estrategia de ingeniería de indicaciones refinada, Constrained-Chain-of-Thought (CCoT), que limita la longitud de salida para mejorar la precisión y el tiempo de respuesta. Los experimentos con LLaMA2-70b en el conjunto de datos GSM8K mostraron que restringir el razonamiento a 100 palabras mejoró la precisión y redujo la longitud de salida. El estudio enfatiza la necesidad de brevedad en el razonamiento LLM y destaca la efectividad variable de CCoT en diferentes tamaños de modelo.

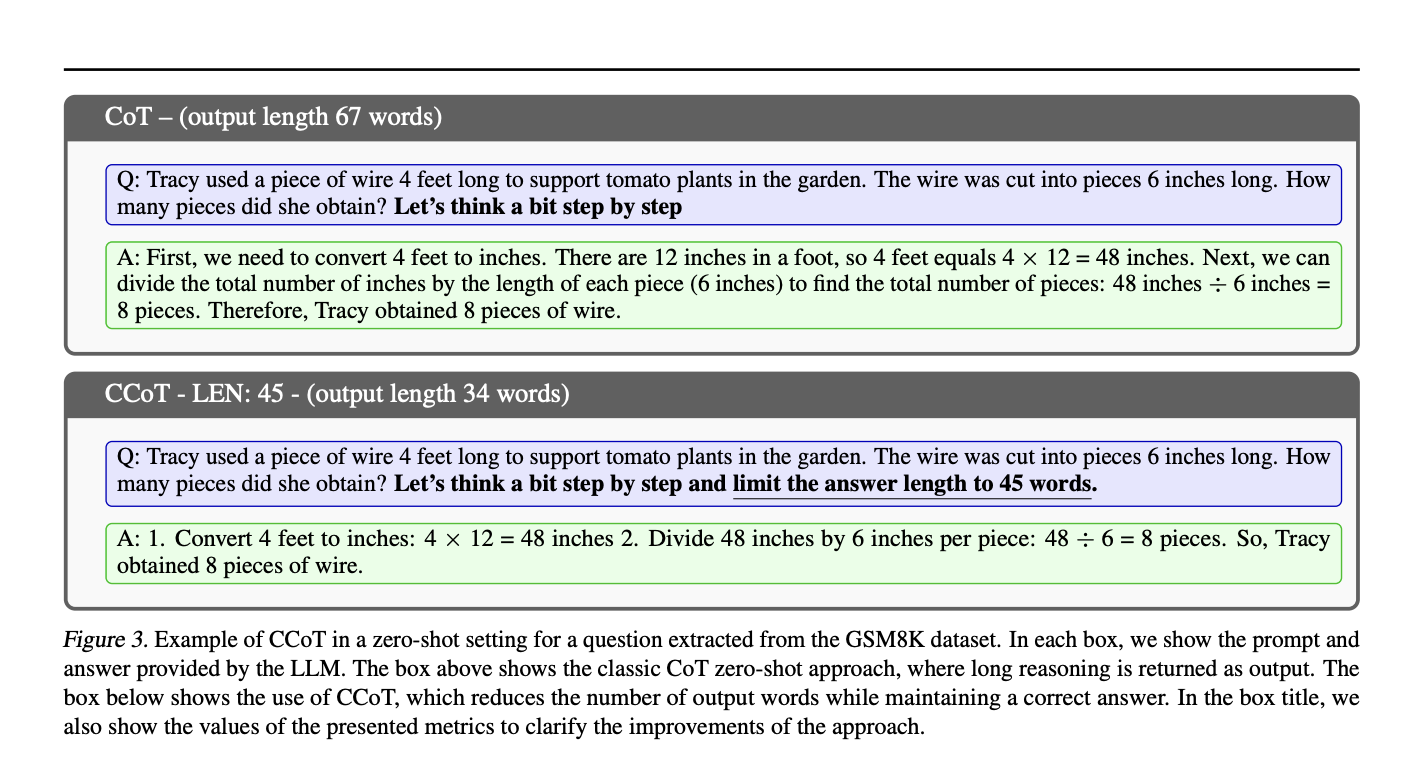

Las investigaciones recientes sobre los LLM se han centrado en mejorar la precisión, lo que a menudo conduce a respuestas más largas y detalladas. Estos resultados extendidos pueden causar alucinaciones, donde el modelo genera información plausible pero incorrecta y explicaciones demasiado largas que oscurecen información clave. Se han desarrollado varias técnicas de ingeniería de indicaciones para abordar esto, incluida la indicación CoT, que mejora el razonamiento pero aumenta el tiempo de respuesta. El estudio introduce métricas para evaluar tanto la concisión como la corrección y propone un enfoque CoT refinado, CCoT, para controlar la longitud de los resultados manteniendo la calidad.

El tiempo de generación de salida de los LLM está influenciado por factores como la arquitectura del modelo, el preprocesamiento, la decodificación y el mensaje utilizado. Las salidas más largas generalmente aumentan el tiempo de respuesta debido a la naturaleza iterativa de los modelos autorregresivos. Las pruebas en varios modelos (Falcon-7b/40b, Llama2-7b/70b) mostraron que a medida que aumenta la longitud de la salida, también lo hace el tiempo de generación. La indicación CoT, que mejora la exactitud de la respuesta, también alarga las salidas y los tiempos de generación. Para abordar esto, se propone un enfoque CCoT, que limita la longitud de la salida manteniendo la precisión, lo que reduce el tiempo de generación de manera efectiva.

Los experimentos evalúan la eficacia del enfoque CCoT en comparación con el CoT clásico, centrándose en la eficiencia, la precisión y la capacidad de controlar la longitud de salida. Utilizando el conjunto de datos GSM8K, se probaron varios LLM (por ejemplo, Llama2-70b, Falcon-40b). Los resultados muestran que CCoT reduce el tiempo de generación y puede mejorar o mantener la precisión. El estudio también introduce nuevas métricas (HCA, SCA, CCA) para evaluar el rendimiento del modelo, considerando la corrección y la concisión. Los modelos más grandes como Llama2-70b se benefician más de CCoT, mientras que los modelos más pequeños tienen dificultades. CCoT demuestra una eficiencia mejorada y una precisión concisa, especialmente para LLM más grandes.

El estudio destaca la importancia de la concisión en la generación de textos por parte de los LLM y presenta CCoT como una técnica de ingeniería rápida para controlar la longitud de salida. Los experimentos muestran que los modelos más grandes como Llama2-70b y Falcon-40b se benefician de CCoT, pero los modelos más pequeños necesitan ayuda para cumplir con las restricciones de longitud. El estudio también propone nuevas métricas para evaluar el equilibrio entre concisión y corrección. Las investigaciones futuras explorarán la integración de estas métricas en el ajuste fino del modelo y examinarán cómo la concisión afecta fenómenos como las alucinaciones o el razonamiento incorrecto en los LLM.

Revisar la Papel. Todo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!. Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Más de 47 000 suscriptores de ML en Reddit

Encuentra lo próximo Seminarios web sobre IA aquí

Sana Hassan, pasante de consultoría en Marktechpost y estudiante de doble titulación en el IIT Madrás, es un apasionado de la aplicación de la tecnología y la IA para abordar los desafíos del mundo real. Con un gran interés en resolver problemas prácticos, aporta una perspectiva nueva a la intersección de la IA y las soluciones de la vida real.