La demanda de modelos abiertos y personalizables que puedan ejecutarse de manera eficiente en varias plataformas de hardware ha crecido, y Meta está a la vanguardia en la atención a esta demanda. Meta publicó en código abierto el lanzamiento de Llama 3.2que incluye modelos LLM de visión de tamaño pequeño y mediano (11B y 90B), junto con modelos livianos de solo texto (1B y 3B) diseñados para dispositivos móviles y de borde, disponibles en versiones preentrenadas y ajustadas con instrucciones. Llama 3.2 Aborda estas necesidades con un conjunto de modelos livianos y robustos, que se han optimizado para diversas tareas, incluidas aplicaciones basadas en texto y visión. Estos modelos están diseñados especialmente para dispositivos de borde, lo que hace que la IA sea más accesible para desarrolladores y empresas.

Variantes del modelo lanzadas

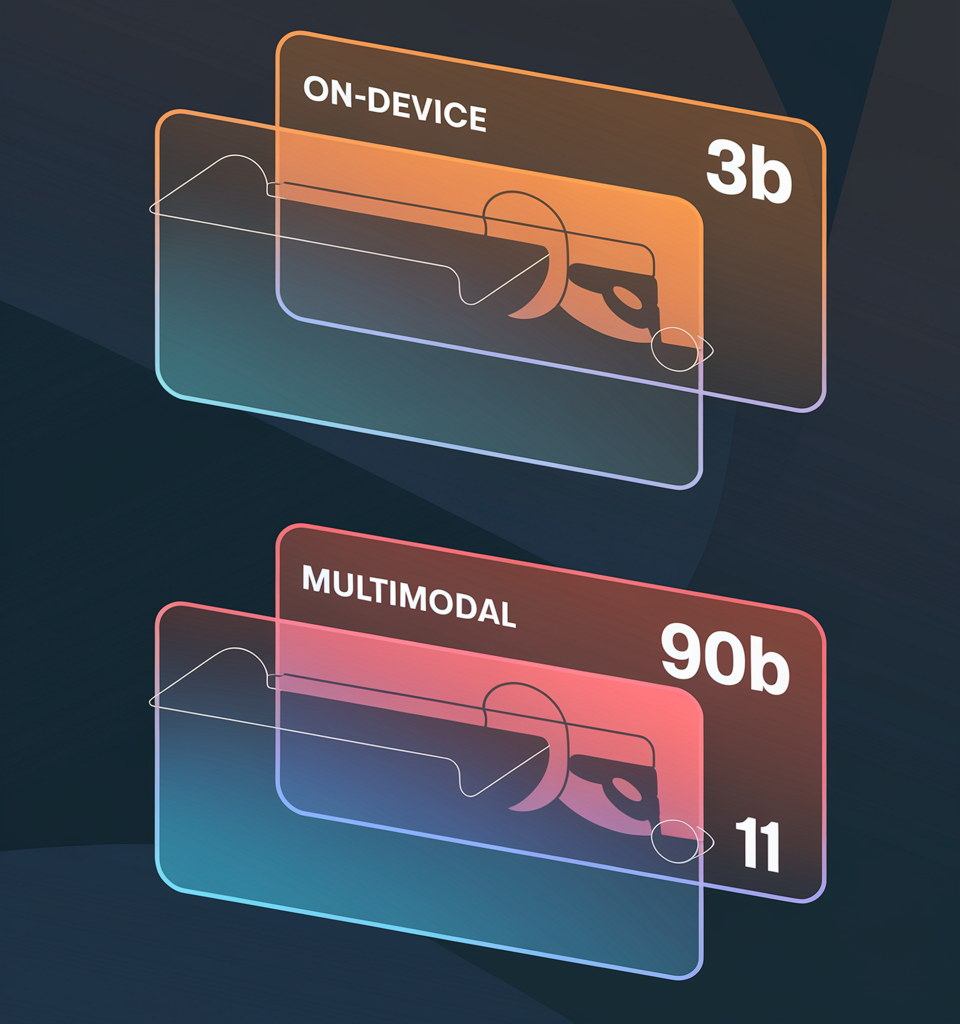

El Llama 3.2 lanzó dos categorías de modelos en esta iteración de la Serie Llama:

- LLM en Visión (11B y 90B): Estos son los modelos más grandes para tareas complejas de razonamiento de imágenes, como comprensión a nivel de documento, fundamento visual y subtítulos de imágenes. Son competitivos con otros modelos cerrados del mercado y los superan en varios puntos de referencia de comprensión de imágenes.

- LLM de solo texto ligero (1B y 3B): Estos modelos más pequeños están diseñados para aplicaciones de inteligencia artificial de vanguardia. Ofrecen un rendimiento sólido para tareas de resumen, seguimiento de instrucciones y reescritura de indicaciones, manteniendo al mismo tiempo un bajo consumo computacional. Los modelos también tienen una longitud de contexto de token de 128 000, lo que mejora significativamente con respecto a las versiones anteriores.

Están disponibles versiones de estos modelos tanto entrenadas previamente como optimizadas con instrucciones, con el apoyo de Qualcomm, MediaTek y Arm, lo que garantiza que los desarrolladores puedan implementar estos modelos directamente en dispositivos móviles y de borde. Los modelos están disponibles para su descarga y uso inmediatos a través de llama.com, Hugging Face y plataformas asociadas como AMD, AWS, Google Cloud y Dell.

Avances técnicos y apoyo al ecosistema

Una de las mejoras más notables en Llama 3.2 es la introducción de una arquitectura basada en adaptadores para los modelos de visión, donde los codificadores de imágenes se integran con modelos de texto entrenados previamente. Esta arquitectura permite un razonamiento profundo de los datos de texto e imágenes, lo que amplía significativamente los casos de uso de estos modelos. Los modelos entrenados previamente se sometieron a un ajuste exhaustivo, incluido el entrenamiento con datos de pares de texto e imágenes ruidosos a gran escala y el entrenamiento posterior con conjuntos de datos de dominio de alta calidad.

El sólido soporte del ecosistema de Llama 3.2 es otro factor crítico en su potencial revolucionario. Con asociaciones con empresas tecnológicas líderes, AWS, Databricks, Dell, Microsoft Azure, NVIDIA y otras, Llama 3.2 se ha optimizado tanto para entornos locales como en la nube. Además, las distribuciones de Llama Stack simplifican la implementación para los desarrolladores, ofreciendo soluciones llave en mano para entornos de borde, nube y en el dispositivo. Las distribuciones, como PyTorch Antorcha Ejecutora para implementaciones en dispositivos y Ollama para configuraciones de nodo único, consolidan aún más la versatilidad de estos modelos.

Métricas de rendimiento

Las variantes de Llama 3.2 ofrecen un rendimiento impresionante en tareas de texto y visión. Los modelos livianos de solo texto 1B y 3B, optimizados para dispositivos móviles y de borde, se destacan en resumen, seguimiento de instrucciones y reescritura de indicaciones, al tiempo que mantienen una longitud de contexto de token de 128K. Estos modelos superan a competidores como Gemma 2.6B y Phi 3.5-mini en varios puntos de referencia. En el lado de la visión, los modelos 11B y 90B demuestran capacidades superiores en comprensión de imágenes, razonamiento y tareas de base visual, superando a modelos cerrados como Claude 3 Haiku y GPT4o-mini en puntos de referencia clave. Estos modelos unen de manera eficiente el razonamiento de texto e imagen, lo que los hace ideales para aplicaciones multimodales.

El poder de los modelos ligeros

La introducción de modelos livianos en Llama 3.2, especialmente las variantes 1B y 3B, es crucial para la computación de borde y las aplicaciones sensibles a la privacidad. La ejecución local en dispositivos móviles garantiza que los datos permanezcan en el dispositivo, lo que mejora la privacidad del usuario al evitar el procesamiento basado en la nube. Esto es particularmente beneficioso en escenarios como resumir mensajes personales o generar elementos de acción a partir de reuniones sin enviar información confidencial a servidores externos. Meta empleó técnicas de poda y destilación de conocimiento para lograr tamaños de modelo pequeños y, al mismo tiempo, conservar un alto rendimiento. Los modelos 1B y 3B se podaron a partir de modelos Llama 3.1 más grandes, utilizando poda estructurada para eliminar parámetros menos importantes sin sacrificar la calidad general del modelo. La destilación de conocimiento se utilizó para impartir conocimiento de modelos más grandes, lo que mejoró aún más el rendimiento de estos modelos livianos.

Llama 3.2 Vision: potenciando el razonamiento de imágenes con los modelos 11B y 90B

Los modelos LLM de visión 11B y 90B de Llama 3.2 están diseñados para tareas avanzadas de razonamiento y comprensión de imágenes, lo que introduce una arquitectura de modelo completamente nueva que integra a la perfección las capacidades de imagen y texto. Estos modelos pueden manejar la comprensión a nivel de documento, subtítulos de imágenes y tareas de base visual. Por ejemplo, los modelos 11B y 90B pueden analizar gráficos comerciales para determinar el mejor mes de ventas o navegar por datos visuales complejos, como mapas, para brindar información sobre el terreno o las distancias. El mecanismo de atención cruzada, desarrollado mediante la integración de un codificador de imágenes entrenado previamente con el modelo de lenguaje, permite que estos modelos se destaquen en la extracción de detalles de las imágenes y la creación de subtítulos significativos y coherentes que cierran la brecha entre el texto y los datos visuales. Esta arquitectura hace que los modelos 11B y 90B compitan con modelos cerrados como Claude 3 Haiku y GPT4o-mini en los puntos de referencia de razonamiento visual, superándolos en tareas que requieren una comprensión multimodal profunda. Se han optimizado para realizar ajustes finos e implementaciones de aplicaciones personalizadas utilizando herramientas de código abierto como Torchtune y Torchchat.

Conclusiones clave del lanzamiento de Llama 3.2:

- Presentaciones de nuevos modelos: Llama 3.2 presenta dos nuevas categorías de modelos: los modelos livianos de solo texto 1B y 3B y los modelos multimodales de visión 11B y 90B. Los modelos 1B y 3B, diseñados para su uso en dispositivos móviles y de borde, aprovechan 9 billones de tokens para el entrenamiento, lo que proporciona un rendimiento de vanguardia para tareas de resumen, seguimiento de instrucciones y reescritura. Estos modelos más pequeños son ideales para aplicaciones en dispositivos debido a sus menores demandas computacionales. Mientras tanto, los modelos de visión 11B y 90B más grandes aportan capacidades multimodales a la suite Llama, sobresaliendo en tareas complejas de comprensión de imágenes y texto y diferenciándolos de las versiones anteriores.

- Longitud del contexto mejorado: Uno de los avances más importantes de Llama 3.2 es la compatibilidad con una longitud de contexto de 128K, en particular en los modelos 1B y 3B. Esta longitud de contexto extendida permite procesar simultáneamente una entrada más extensa, lo que mejora las tareas que requieren un análisis de documentos extenso, como el resumen y el razonamiento a nivel de documento. También permite que estos modelos gestionen grandes cantidades de datos de manera eficiente.

- Destilación de conocimiento para modelos livianos: Los modelos 1B y 3B de Llama 3.2 se benefician de un proceso de destilación de modelos más grandes, específicamente las variantes 8B y 70B de Llama 3.1. Este proceso de destilación transfiere conocimiento de los modelos más grandes a los más pequeños, lo que permite que los modelos livianos logren un rendimiento competitivo con una sobrecarga computacional significativamente reducida, lo que los hace muy adecuados para entornos con recursos limitados.

- Modelos de visión entrenados con datos masivos: Los modelos de lenguaje de visión (VLM), 11B y 90B, se entrenaron en un conjunto masivo de datos de 6 mil millones de pares de imágenes y texto, lo que los dotó de sólidas capacidades multimodales. Estos modelos integran un MLP de tipo CLIP con activación GeLU para el codificador de visión, a diferencia de la arquitectura MLP de Llama 3, que utiliza SwiGLU. Esta elección de diseño mejora su capacidad para manejar tareas complejas de comprensión visual, lo que los hace muy eficaces para el razonamiento de imágenes y la interacción multimodal.

- Arquitectura de visión avanzada: Los modelos de visión de Llama 3.2 incorporan características arquitectónicas avanzadas, como la norma de capa normal para el codificador de visión en lugar de la norma de capa RMS que se observa en otros modelos, e incluyen un multiplicador de compuerta aplicado a los estados ocultos. Este mecanismo de compuerta utiliza una función de activación tanh para escalar el vector de -1 a 1, lo que ayuda a ajustar con precisión las salidas de los modelos de visión. Estas innovaciones arquitectónicas contribuyen a mejorar la precisión y la eficiencia en las tareas de razonamiento visual.

- Métricas de rendimiento: Las evaluaciones de los modelos de Llama 3.2 muestran resultados prometedores. El modelo 1B obtuvo una puntuación de 49,3 en la MMLU, mientras que el modelo 3B obtuvo una puntuación de 63,4. El modelo multimodal de visión 11B obtuvo una puntuación de 50,7 en la MMMU, mientras que el modelo 90B obtuvo una puntuación de 60,3 en el lado de la visión. Estas métricas resaltan la ventaja competitiva de los modelos de Llama 3.2 en tareas basadas en texto y visión, especialmente en comparación con otros modelos líderes.

- Integración con UnslothAI para mayor velocidad y eficiencia: Los modelos 1B y 3B están completamente integrados con UnslothAI, lo que permite un ajuste fino dos veces más rápido, una inferencia dos veces más rápida y un uso de VRAM un 70 % menor. Esta integración mejora aún más la usabilidad de estos modelos en aplicaciones en tiempo real. Se está trabajando para integrar los modelos VLM 11B y 90B en el marco de UnslothAI, lo que extenderá estos beneficios de velocidad y eficiencia a los modelos multimodales más grandes.

Estos avances hacen de Llama 3.2 un conjunto de modelos potente y versátil adecuado para una amplia gama de aplicaciones, desde soluciones de IA livianas en el dispositivo hasta tareas multimodales más complejas que requieren comprensión de imágenes y texto a gran escala.

Conclusión

El lanzamiento de Llama 3.2 representa un hito importante en la evolución de los modelos de visión e inteligencia artificial de borde. Su arquitectura abierta y personalizable, su sólido soporte de ecosistema y sus modelos livianos y centrados en la privacidad ofrecen una solución atractiva para desarrolladores y empresas que buscan integrar la inteligencia artificial en sus aplicaciones de borde y en dispositivos. La disponibilidad de modelos pequeños y grandes garantiza que los usuarios puedan seleccionar la variante que mejor se adapte a sus recursos computacionales y casos de uso.

Echa un vistazo a la Modelos en la cara abrazada y DetallesTodo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!. Si te gusta nuestro trabajo, te encantará nuestro hoja informativa..

No olvides unirte a nuestro Subreddit con más de 50 000 millones de usuarios

Asif Razzaq es el director ejecutivo de Marktechpost Media Inc. Como ingeniero y emprendedor visionario, Asif está comprometido con aprovechar el potencial de la inteligencia artificial para el bien social. Su iniciativa más reciente es el lanzamiento de una plataforma de medios de inteligencia artificial, Marktechpost, que se destaca por su cobertura en profundidad de noticias sobre aprendizaje automático y aprendizaje profundo que es técnicamente sólida y fácilmente comprensible para una amplia audiencia. La plataforma cuenta con más de 2 millones de visitas mensuales, lo que ilustra su popularidad entre el público.