Los modelos de lenguaje grande (LLM) a veces aprenden cosas que no queremos que aprendan y comprendan. Es importante encontrar formas de eliminar o ajustar este conocimiento para mantener la IA precisa y en control. Sin embargo, editar o “desaprender” conocimientos específicos en estos modelos es muy difícil. Los métodos habituales para hacer esto a menudo terminan afectando otra información o información general del modelo, lo que puede afectar sus capacidades generales. Además, es posible que los cambios realizados no siempre duren.

En trabajos recientes, los investigadores han utilizado métodos como el rastreo causal para localizar componentes clave para la generación de resultados, mientras que técnicas más rápidas como el parche de atribución ayudan a identificar partes importantes más rápidamente. Los métodos de edición y desaprendizaje intentan eliminar o cambiar cierta información en un modelo para mantenerlo seguro y justo. Pero a veces, los modelos pueden aprender o mostrar información no deseada. Los métodos actuales para editar y desaprender conocimientos a menudo afectan otras capacidades del modelo y carecen de solidez, ya que ligeras variaciones en las indicaciones aún pueden generar el conocimiento original. Incluso con medidas de seguridad, aún pueden producir respuestas dañinas a ciertas indicaciones, lo que demuestra que todavía es difícil controlar completamente su comportamiento.

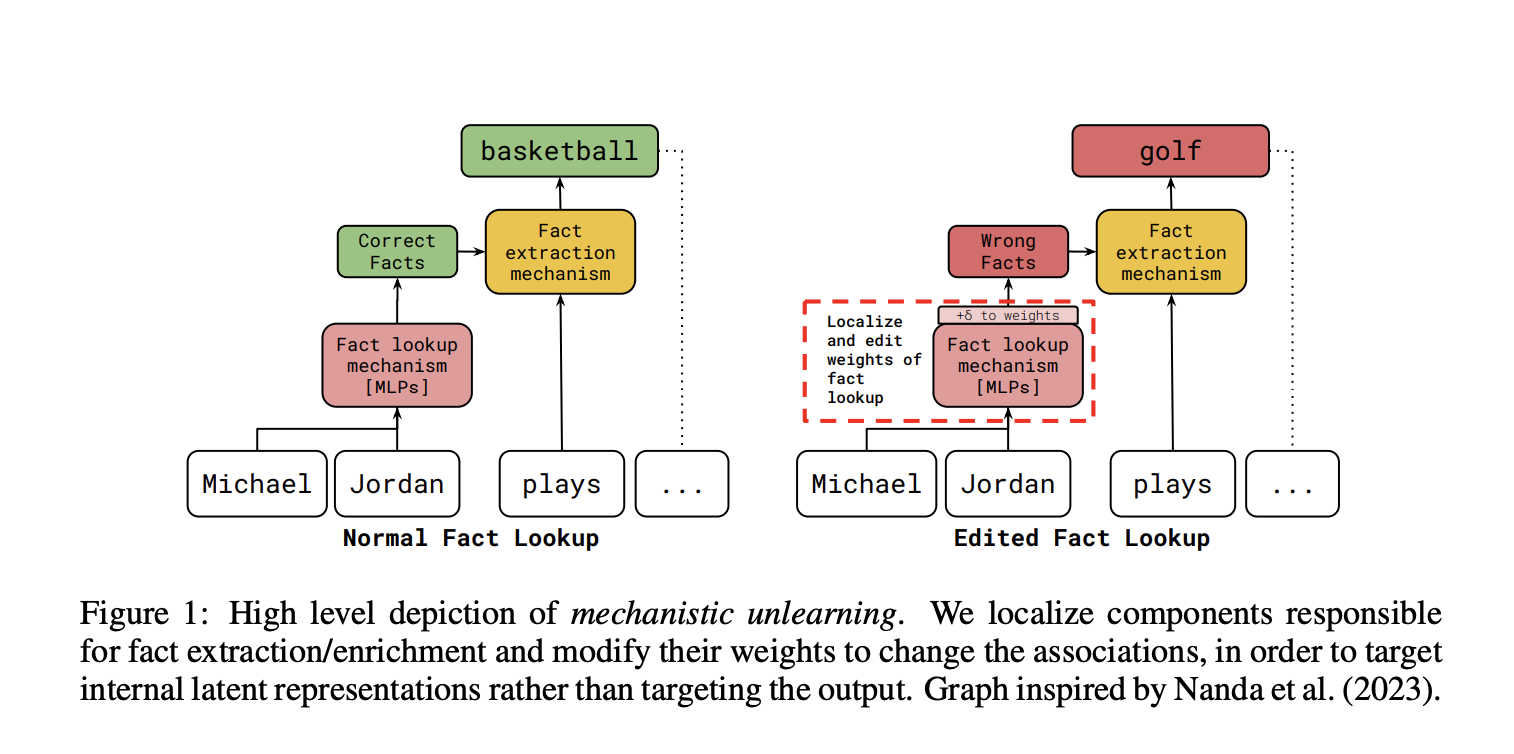

Un equipo de investigadores de la Universidad de Maryland, el Instituto de Tecnología de Georgia, la Universidad de Bristol, y Google Deep Mind proponer Desaprendizaje mecanicista. Desaprendizaje mecanicista es un nuevo método de IA que utiliza interpretabilidad mecanicista para localizar y editar componentes específicos del modelo asociados con mecanismos de recuperación de hechos. Este enfoque tiene como objetivo hacer que las ediciones sean más sólidas y reducir los efectos secundarios no deseados.

El estudio examina métodos para eliminar información de los modelos de IA y descubre que muchos fallan cuando cambian las indicaciones o los resultados. Al centrarse en partes específicas de modelos como Gemma-7B y Gemma-2-9B que son responsables de la recuperación de hechos, un enfoque basado en gradientes resulta más eficaz y eficiente. Este método reduce la memoria oculta mejor que otros, ya que requiere solo unos pocos cambios en el modelo y se generaliza en diversos datos. Al centrarse en estos componentes, el método garantiza que el conocimiento no deseado se desaprende de manera efectiva y resiste los intentos de reaprendizaje. Los investigadores demuestran que este enfoque conduce a ediciones más sólidas en diferentes formatos de entrada/salida y reduce la presencia de conocimiento latente en comparación con los métodos existentes.

Los investigadores llevaron a cabo experimentos para probar métodos para desaprender y editar información en dos conjuntos de datos: Datos deportivos y Contrafact. En el conjunto de datos Sports Facts, trabajaron para eliminar asociaciones con atletas de baloncesto y cambiar los deportes de 16 atletas al golf. En el conjunto de datos de CounterFact, se centraron en intercambiar respuestas correctas por incorrectas para 16 hechos. Utilizaron dos técnicas principales: Seguimiento de salida (que incluye rastreo causal y parches de atribución) y Localización de búsqueda de hechos. Los resultados mostraron que la localización manual conducía a una mayor precisión y solidez, especialmente en las pruebas de opción múltiple. El método de interpretabilidad manual también fue fuerte frente a los intentos de reaprender la información. Además, el análisis del conocimiento subyacente sugirió que una edición efectiva dificulta la recuperación de información previa en las capas del modelo. Las pruebas de enmascaramiento de peso mostraron que los métodos de optimización cambian principalmente los parámetros relacionados con la extracción de hechos en lugar de los utilizados para buscar hechos, lo que enfatiza la necesidad de mejorar el proceso de búsqueda de hechos para una mayor solidez. Por lo tanto, este enfoque tiene como objetivo hacer que las ediciones sean más sólidas y reducir los efectos secundarios no deseados.

En conclusión, este artículo presenta una solución prometedora al problema del desaprendizaje sólido del conocimiento en los LLM mediante el uso Interpretabilidad mecanicista para apuntar y editar con precisión componentes específicos del modelo, mejorando así la efectividad y solidez del proceso de desaprendizaje. El trabajo propuesto también sugiere desaprender/editar como un potencial banco de pruebas para diferentes métodos de interpretabilidad, que podrían eludir la falta inherente de verdad fundamental en la interpretabilidad.

Mira el Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de telegramas y LinkedIn Grarriba. Si te gusta nuestro trabajo, te encantará nuestro hoja informativa.. No olvides unirte a nuestro SubReddit de más de 55.000 ml.

[Upcoming Live Webinar- Oct 29, 2024] La mejor plataforma para ofrecer modelos optimizados: motor de inferencia Predibase (promocionado)

Divyesh es pasante de consultoría en Marktechpost. Está cursando un BTech en Ingeniería Agrícola y Alimentaria en el Instituto Indio de Tecnología de Kharagpur. Es un entusiasta de la ciencia de datos y el aprendizaje automático que quiere integrar estas tecnologías líderes en el ámbito agrícola y resolver desafíos.