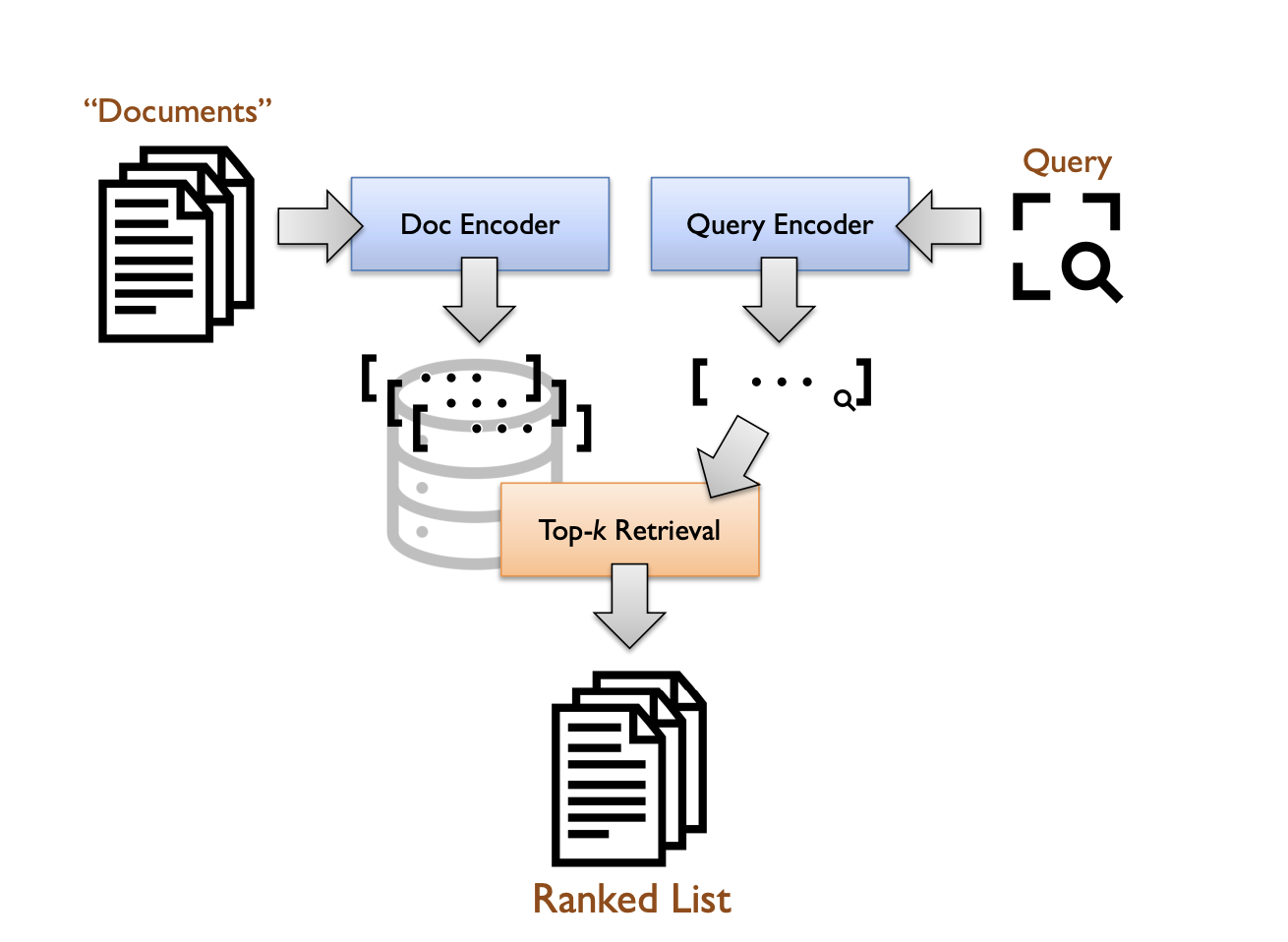

Últimamente, se han producido avances significativos en la aplicación de redes neuronales profundas al campo de la búsqueda en el aprendizaje automático, con un énfasis específico en el aprendizaje de representación dentro de la arquitectura bicodificadora. En este marco, diversos tipos de contenido, incluidas consultas, pasajes e incluso multimedia, como imágenes, se transforman en “incrustaciones” compactas y significativas representadas como vectores densos. Estos modelos de recuperación densos, construidos sobre esta arquitectura, sirven como piedra angular para mejorar los procesos de recuperación dentro de modelos de lenguaje grandes (LLM). Este enfoque ha ganado popularidad y ha demostrado ser muy eficaz para mejorar las capacidades generales de los LLM dentro del ámbito más amplio de la IA generativa actual.

La narrativa sugiere que debido a la necesidad de manejar numerosos vectores densos, las empresas deberían incorporar un “almacén de vectores” o una “base de datos de vectores” dedicada en su “pila de IA”. Un nicho de mercado de nuevas empresas está promoviendo activamente estas tiendas de vectores como componentes innovadores y esenciales de la arquitectura empresarial contemporánea. Ejemplos notables incluyen Pinecone, Weaviate, Chroma, Milvus y Qdrant, entre otros. Algunos defensores han llegado incluso a proponer que estas bases de datos vectoriales podrían eventualmente suplantar a las bases de datos relacionales de larga data.

Este artículo presenta un contrapunto a esta narrativa. Los argumentos giran en torno a un análisis sencillo de costo-beneficio, considerando que la búsqueda representa una aplicación existente y establecida en muchas organizaciones, lo que lleva a importantes inversiones previas en estas capacidades. La infraestructura de producción está dominada por el amplio ecosistema centrado en la biblioteca de búsqueda de código abierto Lucene, impulsado principalmente por plataformas como Elasticsearch, OpenSearch y Solr.

La imagen de arriba muestra una arquitectura bicodificadora estándar, donde los codificadores generan representaciones vectoriales densas (incrustaciones) a partir de consultas y documentos (pasajes). La recuperación se enmarca como una búsqueda de k vecinos más cercanos en el espacio vectorial. Los experimentos se centraron en la colección de pruebas de clasificación de pasajes de MS MARCO, construida sobre un corpus que comprende aproximadamente 8,8 millones de pasajes extraídos de la web. Para la evaluación se utilizaron las consultas de desarrollo estándar y las consultas de TREC 2019 y TREC 2020 Deep Learning Tracks.

Los hallazgos sugieren que hoy es posible construir un prototipo de búsqueda vectorial utilizando incrustaciones de OpenAI directamente con Lucene. La creciente popularidad de la incorporación de API respalda nuestros argumentos. Estas API simplifican el complejo proceso de generar vectores densos a partir de contenido, haciéndolo más accesible para los profesionales. De hecho, Lucene es todo lo que necesita cuando crea ecosistemas de búsqueda hoy en día. Pero resulta que sólo el tiempo dirá si tienes razón. Finalmente, esto nos recuerda que sopesar los costos versus los beneficios seguirá siendo una mentalidad primordial, incluso en el mundo de la IA en rápida evolución.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de 29k+ ML, Comunidad de Facebook de más de 40.000 personas, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

Janhavi Lande, se graduó en Ingeniería Física del IIT Guwahati, promoción de 2023. Es una futura científica de datos y ha estado trabajando en el mundo de la investigación ml/ai durante los últimos dos años. Lo que más le fascina es este mundo en constante cambio y su constante exigencia de que los humanos se mantengan al día. En su pasatiempo le gusta viajar, leer y escribir poemas.