Si bien los modelos de lenguajes grandes (LLM) como ChatGPT y GPT-4 han demostrado un mejor rendimiento en varios puntos de referencia, los proyectos de código abierto como MMLU y OpenLLMBoard han progresado rápidamente para ponerse al día en múltiples aplicaciones y puntos de referencia. Comprender sus capacidades, limitaciones y distinciones se vuelve más crucial a medida que ingresan a la nueva era de los LLM con rápidos avances en nuevos modelos y metodologías. Aunque los LLM han demostrado su capacidad para generar texto coherente en tareas como el resumen, se necesita más información sobre qué tan bien se desempeñan en LFQA.

Uno de los problemas importantes que aún debe resolverse es la respuesta a preguntas de formato largo (LFQA), que tiene numerosas e importantes aplicaciones en el mundo real (como foros de soporte, resolución de problemas, servicio al cliente, etc.). Responder a este tipo de preguntas frecuentemente requiere habilidades de pensamiento complicadas para comprender la pregunta y darle sentido al material que se encuentra disperso en el artículo original. Los puntos principales de los artículos se condensan en resúmenes abstractos. Suponen que las investigaciones de seguimiento de estos resúmenes requerirían una mejor comprensión de los temas que conectan las distintas secciones del material original. Además, otros investigadores muestran que las respuestas que exigen la comprensión de más de un tercio de un material extenso con frecuencia son evaluadas como “DIFÍCILES” por las personas.

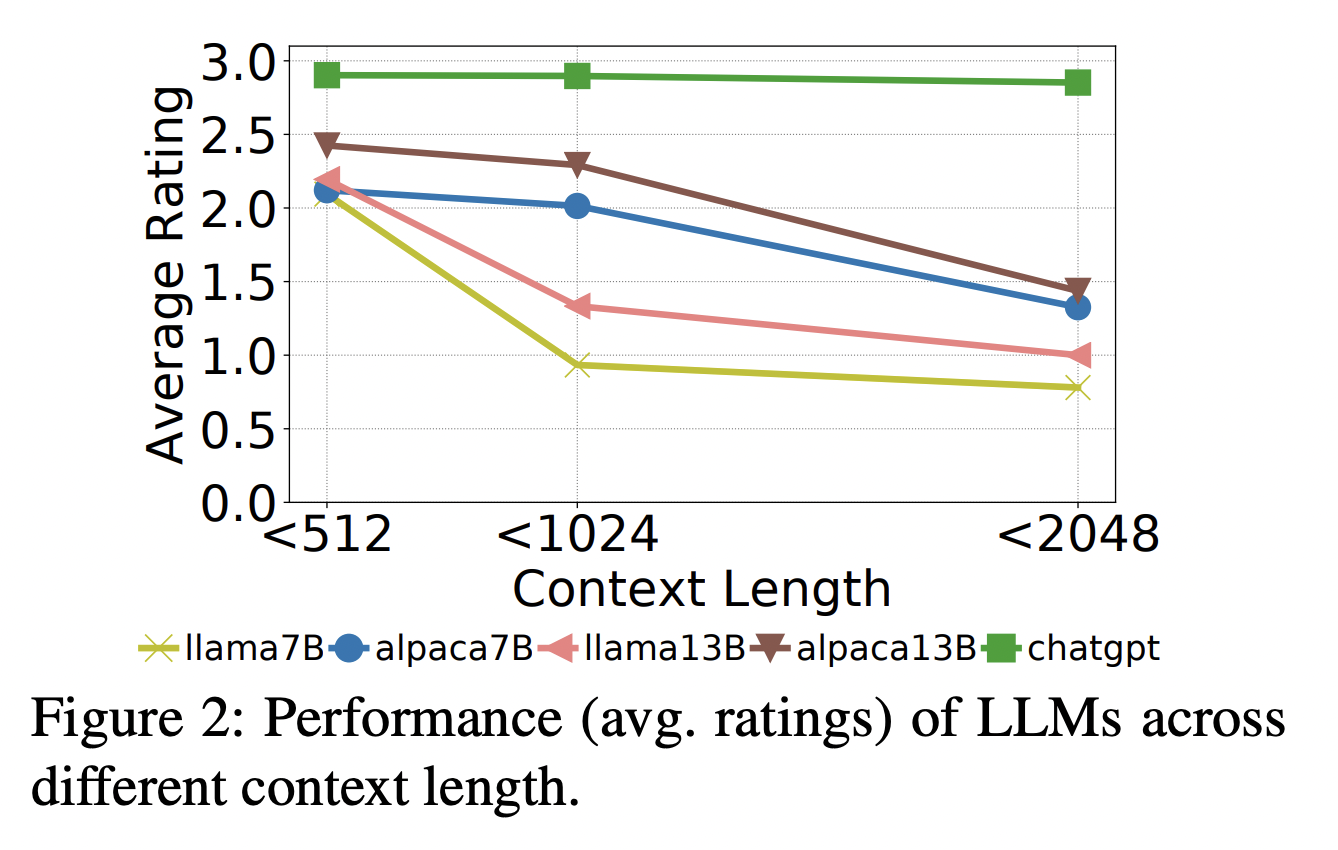

Los investigadores de Salesforce sugieren un enfoque de evaluación escalable para comparar y contrastar las diferencias entre los LLM enormes y los LLM básicos más pequeños pero exitosos (como Llama-7B, 13B) y sus contrapartes destiladas (como Alpaca-7B, 13B). Para ello, indican que se le indique explícitamente a ChatGPT que construya preguntas complicadas a partir de resúmenes de documentos. Su estudio empírico revela que las preguntas de seguimiento creadas a partir de resúmenes presentan una configuración difícil pero más realista para evaluar las habilidades de razonamiento de los LLM en dos frentes (complejidad de las preguntas generadas y calidad de la respuesta de los LLM de código abierto). Utilizan GPT-4 para determinar la calidad de la respuesta en cuanto a coherencia, relevancia, coherencia fáctica y corrección en trabajos anteriores porque depender completamente de la revisión humana para el control de calidad de formato largo es costoso y difícil de escalar. También realizan una evaluación humana a menor escala, lo que demuestra que GPT-4 se correlaciona fuertemente con la evaluación humana, lo que hace que su evaluación sea creíble.

Las siguientes son sus principales conclusiones de este estudio:

• Recomiendan inferir de contextos más extensos haciendo numerosos recorridos por el contexto durante > 20% del tiempo para generar preguntas a partir de resúmenes abstractivos.

• Los LLM destilados (Alpaca-7B, 13B) a menudo dependen menos del contexto cuando generan preguntas a partir del material original, pero su capacidad para crear preguntas a partir de resúmenes de documentos se reduce considerablemente.

• Para las preguntas derivadas de resúmenes (> 16,8%), las respuestas producidas por LLM destilados pueden ser consistentes en todos los contextos, pero con frecuencia se salen del tema, producen respuestas redundantes y son solo parcialmente precisas.

• Alpaca-7B y 13B son más sensibles a contextos más largos (>1024 tokens) que los LLM básicos (Llama), aunque normalmente producen respuestas sensatas.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de más de 30.000 ml, Comunidad de Facebook de más de 40.000 personas, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

Aneesh Tickoo es pasante de consultoría en MarktechPost. Actualmente está cursando su licenciatura en Ciencia de Datos e Inteligencia Artificial en el Instituto Indio de Tecnología (IIT), Bhilai. Pasa la mayor parte de su tiempo trabajando en proyectos destinados a aprovechar el poder del aprendizaje automático. Su interés de investigación es el procesamiento de imágenes y le apasiona crear soluciones en torno a él. Le encanta conectarse con personas y colaborar en proyectos interesantes.