Los modelos de lenguajes grandes (LLM) han remodelado significativamente el panorama de la Inteligencia Artificial (IA) desde su aparición. Estos modelos proporcionan un marco sólido para desafiar el razonamiento y la resolución de problemas, revolucionando numerosas disciplinas de la IA. Los LLM son agentes adaptables capaces de realizar diversas tareas gracias a su capacidad de comprimir enormes cantidades de conocimiento en redes neuronales. Pueden realizar trabajos que antes se pensaba que estaban reservados para los humanos, como esfuerzos creativos y resolución de problemas a nivel experto, cuando se les da acceso a una interfaz de chat. Como resultado de esta transición, se han creado aplicaciones que van desde chatbots y asistentes virtuales hasta herramientas de traducción y resumen de idiomas.

Los LLM actúan como agentes generalistas, trabajando con otros sistemas, recursos y modelos para lograr los objetivos establecidos por las personas. Esto incluye su capacidad para seguir instrucciones multimodales, ejecutar programas, utilizar herramientas y más. Esto abre nuevas posibilidades para las aplicaciones de IA, incluidas aquellas en vehículos autónomos, atención médica y finanzas. A pesar de sus extraordinarios poderes, los LLM han sido criticados por su falta de repetibilidad, direccionabilidad y accesibilidad del proveedor de servicios.

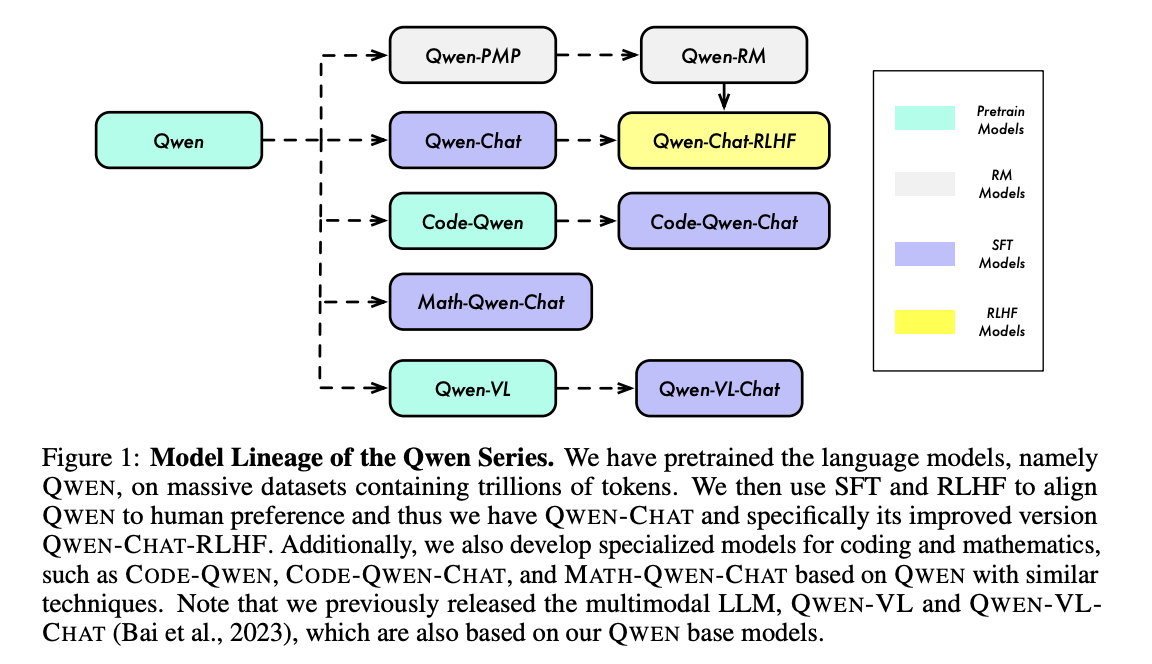

En una investigación reciente, un grupo de investigadores presentó QWEN1, que marca el lanzamiento inicial de la serie integral de modelos de lenguaje de gran tamaño del equipo, es decir, la serie QWEN LLM. QWEN no es un modelo en particular, sino más bien una colección de modelos con recuentos de parámetros variados. Las dos categorías principales de esta serie son QWEN, que significa modelos de lenguaje base previamente entrenados, y QWEN-CHAT, que significa modelos de chat que se han refinado utilizando métodos de alineación humana.

En una variedad de tareas posteriores, los modelos de lenguaje base, representados por QWEN, han mostrado consistentemente un desempeño sobresaliente. Estos modelos tienen una comprensión profunda de muchos dominios diferentes gracias a su entrenamiento sustancial en una variedad de conjuntos de datos textuales y de codificación. Son activos valiosos para una variedad de aplicaciones debido a su adaptabilidad y capacidad de éxito en diversas actividades.

Por otro lado, los modelos QWEN-CHAT están creados especialmente para interacciones y conversaciones en lenguaje natural. Se han sometido a un ajuste exhaustivo utilizando metodologías de alineación humana, incluido el aprendizaje por refuerzo a partir de la retroalimentación humana (RLHF) y un ajuste fino supervisado. En particular, RLHF ha tenido bastante éxito en mejorar la funcionalidad de estos modelos de chat.

Además de QWEN y QWEN-CHAT, el equipo también introdujo dos variantes especializadas en la serie de modelos, diseñadas específicamente para tareas relacionadas con la codificación. Estos modelos, llamados CODE-QWEN y CODE-QWEN-CHAT, se han sometido a un riguroso entrenamiento previo en grandes conjuntos de datos de código, seguido de ajustes para sobresalir en tareas que involucran comprensión, creación, depuración e interpretación de código. Si bien pueden quedar ligeramente por detrás de los modelos propietarios, estos modelos superan ampliamente a sus homólogos de código abierto en términos de rendimiento, lo que los convierte en una herramienta invaluable para académicos y desarrolladores.

De manera similar, también se ha desarrollado MATH-QWEN-CHAT, que se enfoca en resolver acertijos matemáticos. Cuando se trata de trabajos relacionados con las matemáticas, estos modelos funcionan mucho mejor que los modelos de código abierto y se aproximan a las capacidades de los modelos comerciales. En conclusión, QWEN marca un importante punto de inflexión en la creación de modelos lingüísticos extensivos. Incluye una amplia variedad de modelos, que en conjunto pueden revelar el potencial transformador de los LLM en el campo de la IA, mostrando su rendimiento superior a las alternativas de código abierto.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de 31k+ ML, Comunidad de Facebook de más de 40.000 personas, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

Tanya Malhotra es estudiante de último año de la Universidad de Estudios de Petróleo y Energía, Dehradun, y cursa BTech en Ingeniería en Ciencias de la Computación con especialización en Inteligencia Artificial y Aprendizaje Automático.

Es una entusiasta de la Ciencia de Datos con buen pensamiento analítico y crítico, junto con un ardiente interés en adquirir nuevas habilidades, liderar grupos y gestionar el trabajo de manera organizada.