Al producir resultados variados y de alta calidad, los modelos de difusión de texto a imagen entrenados con datos a gran escala han dominado considerablemente las tareas generativas. En una tendencia desarrollada recientemente, las tareas típicas de transformación de imagen a imagen, como la alteración, mejora o superresolución de la imagen, se guían por los resultados generados con condiciones de imagen externas mediante difusión antes de modelos generativos de texto a imagen previamente entrenados. Se ha demostrado que la difusión previa introducida por modelos previamente entrenados mejora significativamente la calidad visual de los resultados de producción de imágenes condicionales entre varios procedimientos de transformación. Los modelos de difusión, por otro lado, dependen en gran medida de un proceso de refinamiento iterativo que con frecuencia requiere muchas iteraciones, que pueden llevar tiempo completarse de manera efectiva.

Su dependencia del número de repeticiones aumenta aún más para la síntesis de imágenes de alta resolución. Por ejemplo, incluso con técnicas de muestreo sofisticadas, una excelente calidad visual en los modelos de difusión latente de texto a imagen de última generación a menudo necesita entre 20 y 200 pasos de muestra. El lento período de muestreo restringe gravemente la aplicabilidad práctica de los modelos de difusión condicional antes mencionados. Los intentos más recientes de acelerar el muestreo por difusión utilizan técnicas de destilación. Estas técnicas aceleran enormemente el muestreo, finalizándolo en 4 a 8 pasos y afectan poco el rendimiento generativo. Investigaciones recientes demuestran que estas técnicas también se pueden utilizar para condensar modelos de difusión de texto a imagen a gran escala que ya han sido entrenados.

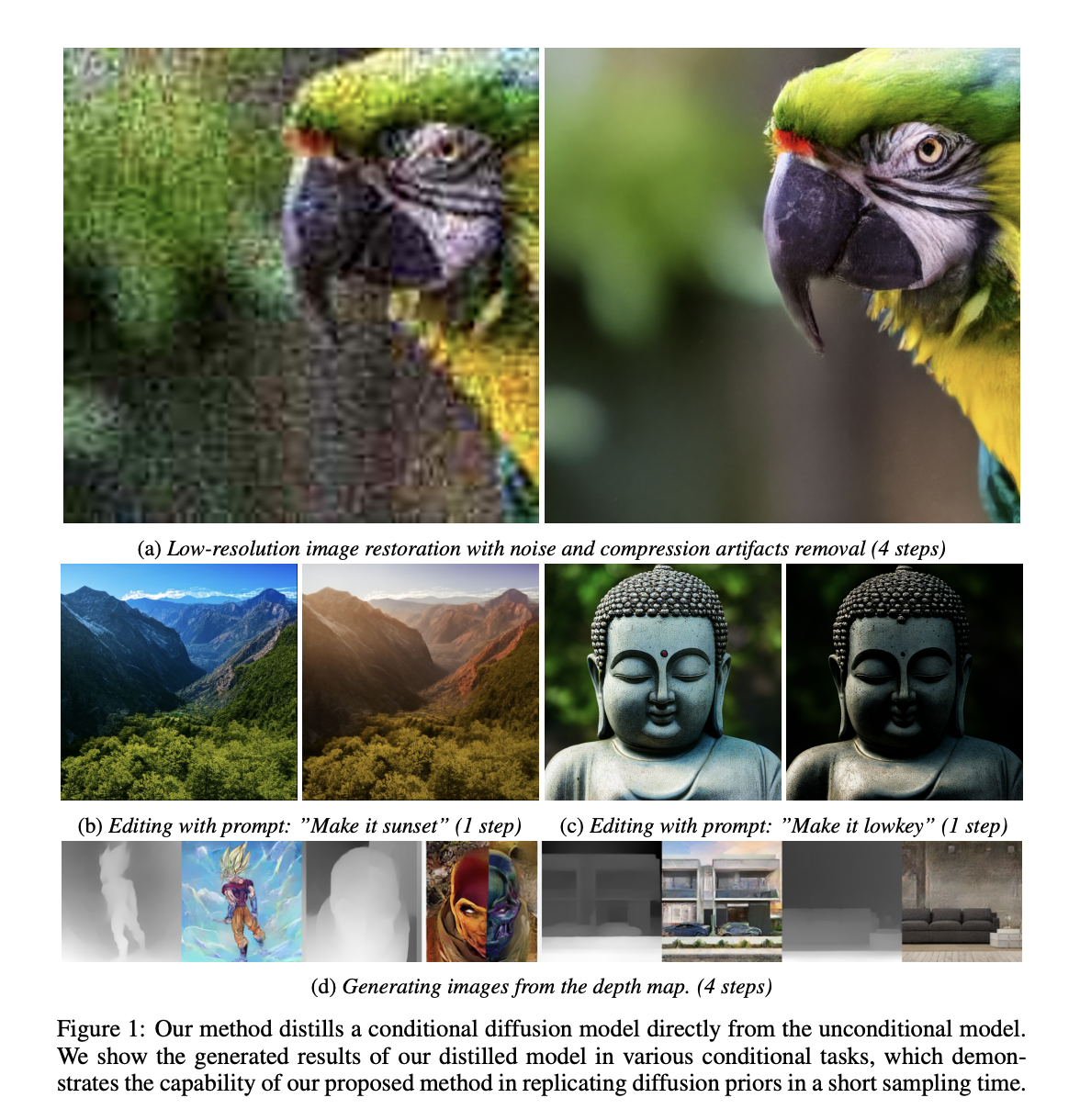

Proporcionan el resultado de nuestro modelo destilado en una variedad de tareas condicionales, lo que ilustra la capacidad de nuestro enfoque sugerido para replicar los antecedentes de difusión en un período de muestreo condensado.

Con base en estos métodos de destilación, se puede utilizar un proceso de destilación de dos etapas, ya sea destilación primero o ajuste fino condicional primero, para destilar modelos de difusión condicional. Cuando se les da el mismo período de muestreo, estas dos técnicas proporcionan resultados que suelen ser superiores a los del modelo de difusión condicional no destilado. Sin embargo, tienen diferentes beneficios en cuanto a flexibilidad para realizar tareas cruzadas y dificultad de aprendizaje. En este trabajo, presentan un nuevo método de destilación para extraer un modelo de difusión condicional de un modelo de difusión incondicional que ya ha sido entrenado. Su enfoque presenta una sola etapa, que comienza con el preentrenamiento incondicional y termina con el modelo de difusión condicional destilada, a diferencia de la técnica tradicional de destilación de dos etapas.

La Figura 1 ilustra cómo su modelo destilado puede pronosticar resultados de alta calidad en solo una cuarta parte de los pasos de muestreo tomando señales de la configuración visual dada. Su técnica es más práctica ya que este aprendizaje simplificado elimina la necesidad de los datos originales de texto a imagen, que eran necesarios en procesos de destilación anteriores. También evitan comprometer la difusión previa en el modelo previamente entrenado, un error típico cuando se utiliza el método de ajuste fino primero en su primera etapa. Cuando se les da el mismo tiempo de muestra, numerosos datos experimentales demuestran que su modelo destilado funciona mejor que las técnicas de destilación anteriores tanto en calidad visual como en rendimiento cuantitativo.

Un campo que necesita más investigación son las técnicas de destilación eficientes en parámetros para la generación condicional. Muestran que su enfoque proporciona un mecanismo de destilación novedoso que es eficiente en parámetros. Al agregar algunos parámetros más que se pueden aprender, puede convertir y acelerar un modelo de difusión incondicional para tareas condicionales. Su formulación, en particular, permite la integración con varias técnicas de ajuste eficientes de parámetros ya en uso, como T2I-Adapter y ControlNet. Utilizando tanto los parámetros aprendibles recién agregados del adaptador condicional como los parámetros congelados del modelo de difusión original, su técnica de destilación aprende a reproducir antecedentes de difusión para tareas dependientes con revisiones iterativas mínimas. Este nuevo paradigma ha aumentado enormemente la utilidad de varias tareas condicionales.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de 31k+ ML, Comunidad de Facebook de más de 40.000 personas, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

También estamos en WhatsApp. Únase a nuestro canal de IA en Whatsapp.

Aneesh Tickoo es pasante de consultoría en MarktechPost. Actualmente está cursando su licenciatura en Ciencia de Datos e Inteligencia Artificial en el Instituto Indio de Tecnología (IIT), Bhilai. Pasa la mayor parte de su tiempo trabajando en proyectos destinados a aprovechar el poder del aprendizaje automático. Su interés de investigación es el procesamiento de imágenes y le apasiona crear soluciones en torno a él. Le encanta conectarse con personas y colaborar en proyectos interesantes.