La animación de expresiones basadas en el habla, un problema complejo en la intersección de los gráficos por computadora y la inteligencia artificial, implica la generación de animaciones faciales realistas y posturas de la cabeza basadas en el lenguaje hablado. El desafío en este ámbito surge del intrincado mapeo de muchos a muchos entre el habla y las expresiones faciales. Cada individuo posee un estilo de habla distinto y la misma oración se puede articular de numerosas maneras, marcadas por variaciones de tono, énfasis y expresiones faciales que la acompañan. Además, los movimientos faciales humanos son muy complejos y llenos de matices, lo que hace que crear animaciones de aspecto natural únicamente a partir del habla sea una tarea formidable.

Los últimos años han sido testigos de la exploración de diversos métodos por parte de los investigadores para abordar el intrincado desafío de la animación de expresiones basadas en el habla. Estos métodos normalmente se basan en modelos y conjuntos de datos sofisticados para aprender las intrincadas asignaciones entre el habla y las expresiones faciales. Si bien se han logrado avances significativos, todavía hay un amplio margen de mejora, especialmente en la captura del espectro diverso y natural de las expresiones humanas y los estilos de habla.

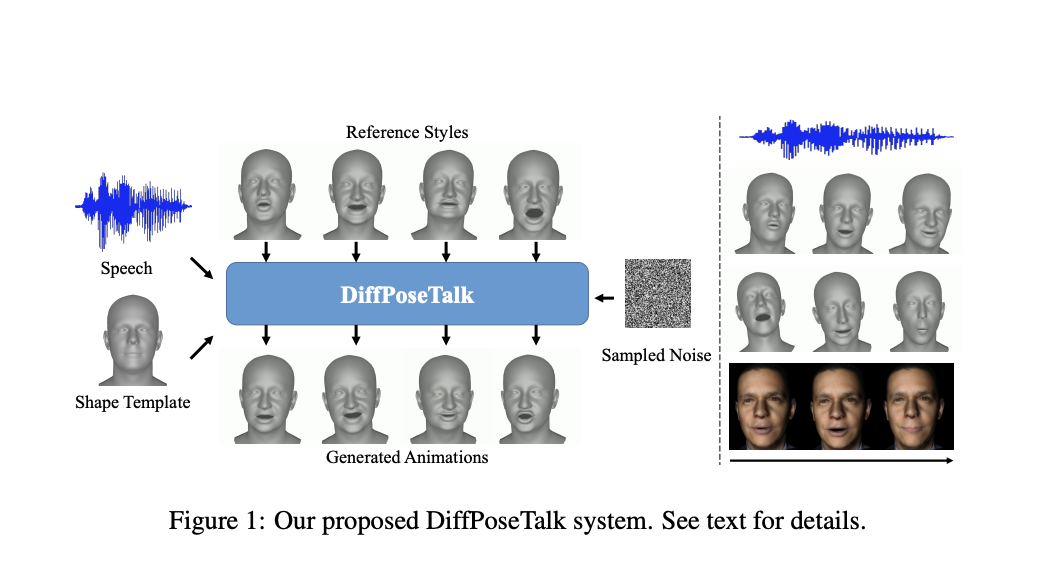

En este ámbito, DiffPoseTalk surge como una solución pionera. Desarrollado por un equipo de investigación dedicado, DiffPoseTalk aprovecha las formidables capacidades de los modelos de difusión para transformar el campo de la animación de expresiones basadas en el habla. A diferencia de los métodos existentes, que a menudo luchan por generar animaciones diversas y de aspecto natural, DiffPoseTalk aprovecha el poder de los modelos de difusión para afrontar el desafío de frente.

DiffPoseTalk adopta un enfoque basado en difusión. El proceso de avance introduce sistemáticamente ruido gaussiano en una muestra de datos inicial, como expresiones faciales y posturas de la cabeza, siguiendo un programa de variación meticulosamente diseñado. Este proceso imita la variabilidad inherente a los movimientos faciales humanos durante el habla.

La verdadera magia de DiffPoseTalk se desarrolla en el proceso inverso. Si bien la distribución que rige el proceso de avance se basa en todo el conjunto de datos y resulta intratable, DiffPoseTalk emplea ingeniosamente una red de eliminación de ruido para aproximar esta distribución. Esta red de eliminación de ruido se somete a un entrenamiento riguroso para predecir la muestra limpia en función de las observaciones ruidosas, invirtiendo efectivamente el proceso de difusión.

Para dirigir el proceso de generación con precisión, DiffPoseTalk incorpora un codificador de estilo de voz. Este codificador cuenta con una arquitectura basada en transformador diseñada para capturar el estilo de habla único de un individuo a partir de un breve videoclip. Destaca en la extracción de características de estilo de una secuencia de parámetros de movimiento, asegurando que las animaciones generadas repliquen fielmente el estilo único del hablante.

Uno de los aspectos más notables de DiffPoseTalk es su capacidad inherente para generar un amplio espectro de animaciones faciales en 3D y poses de cabezas que encarnan diversidad y estilo. Lo logra explotando el poder latente de los modelos de difusión para replicar la distribución de diversas formas. DiffPoseTalk puede generar una amplia gama de expresiones faciales y movimientos de cabeza, encapsulando eficazmente los innumerables matices de la comunicación humana.

En términos de rendimiento y evaluación, destaca DiffPoseTalk. Destaca en métricas críticas que miden la calidad de las animaciones faciales generadas. Una métrica fundamental es la sincronización de labios, medida por el error L2 máximo en todos los vértices de labios para cada fotograma. DiffPoseTalk ofrece constantemente animaciones altamente sincronizadas, asegurando que los movimientos de los labios del personaje virtual se alineen con las palabras habladas.

Además, DiffPoseTalk demuestra ser muy hábil para replicar estilos de habla individuales. Garantiza que las animaciones generadas reflejen fielmente las expresiones y gestos del hablante original, añadiendo así una capa de autenticidad a las animaciones.

Además, las animaciones generadas por DiffPoseTalk se caracterizan por su naturalidad innata. Exudan fluidez en los movimientos faciales, capturando hábilmente las intrincadas sutilezas de la expresión humana. Esta naturalidad intrínseca subraya la eficacia de los modelos de difusión en la generación de animaciones realistas.

En conclusión, DiffPoseTalk surge como un método innovador para la animación de expresiones basadas en el habla, que aborda el intrincado desafío de mapear la entrada del habla en animaciones faciales y posturas de la cabeza diversas y estilísticas. Al aprovechar los modelos de difusión y un codificador de estilo de habla dedicado, DiffPoseTalk destaca por capturar los innumerables matices de la comunicación humana. A medida que avanzan la IA y los gráficos por computadora, anticipamos ansiosamente un futuro en el que nuestros compañeros y personajes virtuales cobren vida con la sutileza y riqueza de la expresión humana.

Revisar la Papel y Proyecto. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de 31k+ ML, Comunidad de Facebook de más de 40.000 personas, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

También estamos en WhatsApp. Únase a nuestro canal de IA en Whatsapp.

Madhur Garg es pasante de consultoría en MarktechPost. Actualmente está cursando su Licenciatura en Ingeniería Civil y Ambiental en el Instituto Indio de Tecnología (IIT), Patna. Comparte una gran pasión por el aprendizaje automático y disfruta explorando los últimos avances en tecnologías y sus aplicaciones prácticas. Con un gran interés en la inteligencia artificial y sus diversas aplicaciones, Madhur está decidido a contribuir al campo de la ciencia de datos y aprovechar su impacto potencial en diversas industrias.