Comprensión de LoRA: adaptación de rango bajo para ajustar modelos grandes

Matemáticas detrás de este método de ajuste eficiente de parámetros

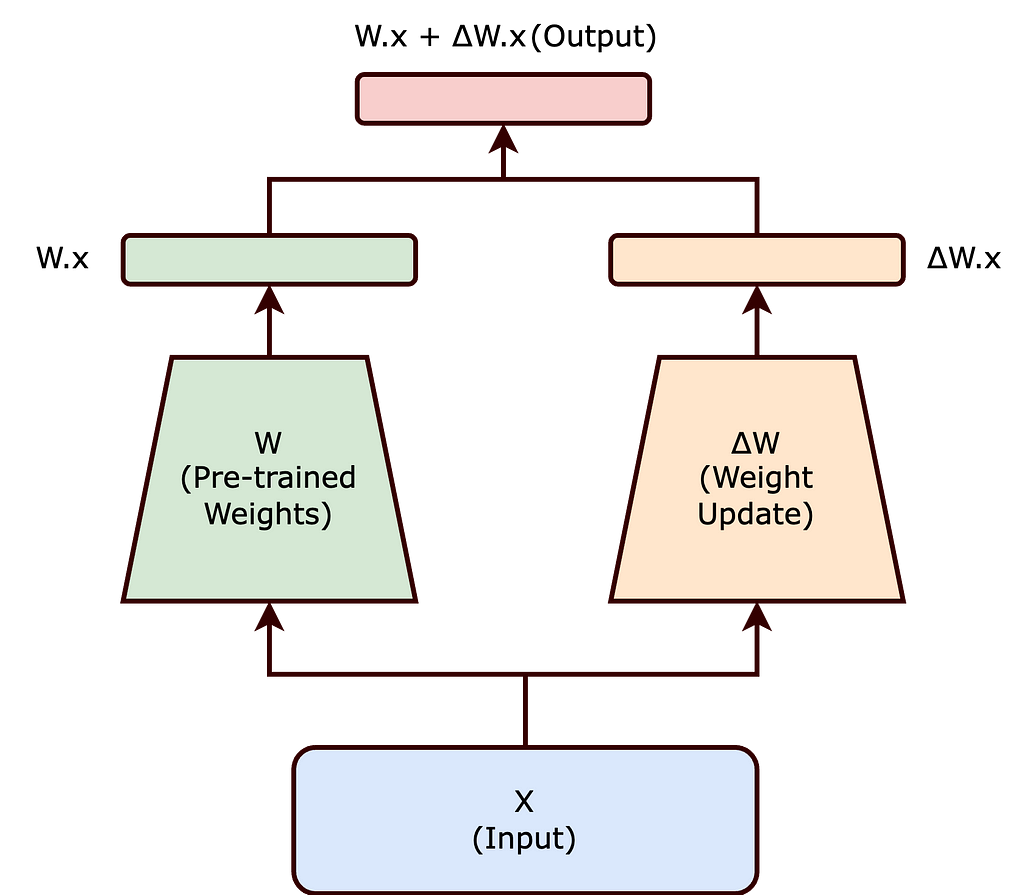

El ajuste fino de grandes modelos previamente entrenados es un desafío computacional y a menudo implica el ajuste de millones de parámetros. Este enfoque tradicional de ajuste, si bien es eficaz, exige tiempo y recursos computacionales sustanciales, lo que plantea un cuello de botella para adaptar estos modelos a tareas específicas. LoRA presentó una solución eficaz a este problema al descomponer la matriz de actualización durante el ajuste. Para estudiar LoRA, comencemos revisando primero el ajuste tradicional.

Descomposición de ( Δ W )

En el ajuste tradicional, modificamos los pesos de una red neuronal previamente entrenada para adaptarla a una nueva tarea. Este ajuste implica alterar la matriz de pesos original (W) de la red. Los cambios realizados en (W) durante el ajuste fino se representan colectivamente mediante (Δ W), de modo que los pesos actualizados se pueden expresar como (W + Δ W).

Ahora, en lugar de modificar ( W ) directamente, el enfoque LoRA busca descomponer ( Δ W ). Esta descomposición es un paso crucial para reducir la sobrecarga computacional asociada con el ajuste de modelos grandes.

La hipótesis del rango intrínseco

La hipótesis del rango intrínseco sugiere que se pueden capturar cambios significativos en la red neuronal utilizando una representación de dimensiones inferiores. Esencialmente, postula que no todos los elementos de (Δ W) son igualmente importantes; en cambio, un subconjunto más pequeño de estos cambios puede encapsular efectivamente los ajustes necesarios.

Introducción de matrices (A) y (B)

Partiendo de esta hipótesis, LoRA propone representar ( Δ W ) como el producto de dos matrices más pequeñas, ( A ) y ( B ), de rango inferior. La matriz de peso actualizada ( W’ ) se convierte así en:

[ W’ = W + BA ]

En esta ecuación, (W) permanece congelada (es decir, no se actualiza durante el entrenamiento). Las matrices ( B ) y ( A ) son de menor dimensionalidad, y su producto ( BA ) representa una aproximación de rango bajo de ( Δ W ).

Impacto del rango inferior en los parámetros entrenables

Al elegir las matrices ( A ) y ( B ) para que tengan un rango más bajo ( r ), el número de parámetros entrenables se reduce significativamente. Por ejemplo, si ( W ) es una matriz ( dxd ), tradicionalmente, la actualización ( W ) implicaría parámetros ( d² ). Sin embargo, con ( B ) y ( A ) de tamaños ( dxr ) y ( rxd ) respectivamente, el número total de parámetros se reduce a ( 2dr ), que es mucho menor cuando ( r << d ).

La reducción en la cantidad de parámetros entrenables, lograda mediante el método de Adaptación de rango bajo (LoRA), ofrece varios beneficios significativos, particularmente cuando se ajustan redes neuronales a gran escala:

- Huella de memoria reducida: LoRA disminuye las necesidades de memoria al reducir la cantidad de parámetros para actualizar, lo que ayuda en la gestión de modelos a gran escala.

- Capacitación y adaptación más rápidas: al simplificar las demandas computacionales, LoRA acelera la capacitación y el ajuste de modelos grandes para nuevas tareas.

- Viabilidad para hardware más pequeño: el menor número de parámetros de LoRA permite el ajuste de modelos importantes en hardware menos potente, como GPU o CPU modestas.

- Escalado a modelos más grandes: LoRA facilita la expansión de modelos de IA sin el correspondiente aumento de recursos computacionales, lo que hace que la gestión de modelos de tamaño creciente sea más práctica.

En el contexto de LoRA, el concepto de rango juega un papel fundamental a la hora de determinar la eficiencia y eficacia del proceso de adaptación. Sorprendentemente, el artículo destaca que el rango de las matrices A y B puede ser sorprendentemente bajo, a veces tan bajo como uno.

Aunque el artículo de LoRA muestra predominantemente experimentos dentro del ámbito del procesamiento del lenguaje natural (PNL), el enfoque subyacente de la adaptación de bajo rango tiene una amplia aplicabilidad y podría emplearse eficazmente en el entrenamiento de varios tipos de redes neuronales en diferentes dominios.

Conclusión

El enfoque de LoRA para descomponer ( Δ W ) en un producto de matrices de rango inferior equilibra efectivamente la necesidad de adaptar grandes modelos previamente entrenados a nuevas tareas manteniendo al mismo tiempo la eficiencia computacional. El concepto de rango intrínseco es clave para este equilibrio, ya que garantiza que la esencia de la capacidad de aprendizaje del modelo se preserve con muchos menos parámetros.

Comprensión de LoRA: adaptación de rango bajo para ajustar modelos grandes fue publicado originalmente en Hacia la ciencia de datos en Medium, donde las personas continúan la conversación resaltando y respondiendo a esta historia.