Los avances recientes en los modelos conversacionales de preguntas y respuestas (QA) han marcado un hito importante. La introducción de modelos de lenguaje grande (LLM) como GPT-4 ha revolucionado la forma en que abordamos las interacciones conversacionales y la generación de respuestas inmediatas. Estos modelos han remodelado el panorama, permitiendo interacciones más intuitivas y fáciles de usar y superando los límites de la precisión en las respuestas automatizadas sin necesidad de ajustes específicos del conjunto de datos.

Esta investigación aborda el desafío principal de mejorar la precisión del control de calidad conversacional de disparo cero en los LLM. Los métodos experimentados anteriormente, aunque algo efectivos, no han aprovechado plenamente el potencial de estos poderosos modelos. La investigación tiene como objetivo perfeccionar estos métodos, lograr una mayor precisión y establecer nuevos puntos de referencia en el control de calidad conversacional.

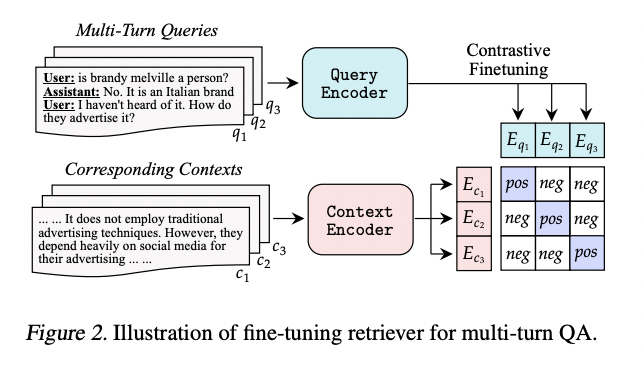

Las estrategias actuales en el control de calidad conversacional implican principalmente ajustar los recuperadores de consultas de un solo turno en conjuntos de datos de control de calidad de varios turnos. Si bien son efectivos hasta cierto punto, estos métodos pueden mejorarse, especialmente en aplicaciones del mundo real. La investigación presenta un enfoque innovador que promete abordar aún más estas limitaciones e impulsar las capacidades de los modelos conversacionales de control de calidad.

Los investigadores de NVIDIA han presentado ChatQA, una familia pionera de modelos de control de calidad conversacionales diseñados para alcanzar y superar los niveles de precisión de GPT-4. ChatQA emplea un novedoso método de ajuste de instrucciones de dos etapas que mejora significativamente los resultados de control de calidad conversacional de los LLM. Este método representa un gran avance, ya que mejora sustancialmente los modelos conversacionales existentes.

La metodología detrás de ChatQA es compleja e innovadora. La primera etapa implica un ajuste fino supervisado (SFT) en una amplia gama de conjuntos de datos, lo que sienta las bases para las capacidades de seguimiento de instrucciones del modelo. La segunda etapa, el ajuste de instrucciones mejorado por el contexto, integra conjuntos de datos de control de calidad contextualizados en la combinación de ajuste de instrucciones. Este enfoque doble garantiza que el modelo siga las instrucciones de manera efectiva y sobresalga en la generación contextualizada o de recuperación aumentada en control de calidad conversacional.

Una de las variantes, ChatQA-70B, supera a GPT-4 en puntuaciones promedio en diez conjuntos de datos de control de calidad conversacionales, una hazaña lograda sin depender de datos sintéticos de los modelos ChatGPT existentes. Este desempeño sobresaliente es un testimonio de la eficacia del método de ajuste de instrucciones de dos etapas empleado por ChatQA.

En conclusión, ChatQA representa un importante avance en la respuesta a preguntas conversacionales. Esta investigación aborda la necesidad crítica de mejorar la precisión en las tareas de control de calidad de disparo cero y destaca el potencial de los métodos avanzados de ajuste de instrucción para mejorar las capacidades de los modelos de lenguaje grandes. El desarrollo de ChatQA podría tener implicaciones de gran alcance para el futuro de la IA conversacional, allanando el camino para modelos conversacionales más precisos, confiables y fáciles de usar.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Unirse nuestro SubReddit de 36k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

Muhammad Athar Ganaie, pasante de consultoría en MarktechPost, es un defensor del aprendizaje profundo eficiente, con especial atención en la capacitación dispersa. Cursando un M.Sc. en Ingeniería Eléctrica, con especialización en Ingeniería de Software, combina conocimientos técnicos avanzados con aplicaciones prácticas. Su esfuerzo actual es su tesis sobre “Mejora de la eficiencia en el aprendizaje por refuerzo profundo”, que muestra su compromiso de mejorar las capacidades de la IA. El trabajo de Athar se encuentra en la intersección “Capacitación escasa en DNN” y “Aprendizaje por refuerzo profundo”.