El objetivo de los sistemas de recomendación es predecir las preferencias de los usuarios basándose en datos históricos. Principalmente, están diseñados en procesos secuenciales y requieren una gran cantidad de datos para entrenar diferentes subsistemas, lo que dificulta su escalamiento a nuevos dominios. Recientemente, los modelos de lenguaje grande (LLM) como ChatGPT y Claude han demostrado capacidades generalizadas notables, lo que permite que un modelo singular aborde diversas tareas de recomendación en varios escenarios. Sin embargo, estos sistemas enfrentan desafíos al presentar conjuntos de elementos a gran escala a los LLM en formato de lenguaje natural debido a la limitación de la longitud de la entrada.

En investigaciones anteriores, las tareas de recomendación se abordaron dentro del marco de generación de lenguaje natural. Estos métodos implican ajustar los LLM para abordar varios escenarios de recomendación a través del ajuste fino eficiente de parámetros (PEFT), incluidos enfoques como LoRA y P-tuning. Sin embargo, en estos enfoques, existen tres desafíos clave: Desafío 1: aunque afirman ser eficientes, estas técnicas de ajuste dependen en gran medida de cantidades sustanciales de datos de entrenamiento, cuya obtención puede ser costosa y llevar mucho tiempo. Desafío 2: tienden a subutilizar las sólidas capacidades generales o multitarea de los LLM. Desafío 3: Carecen de la capacidad de presentar eficazmente un corpus de ítems a gran escala a los LLM en un formato de lenguaje natural.

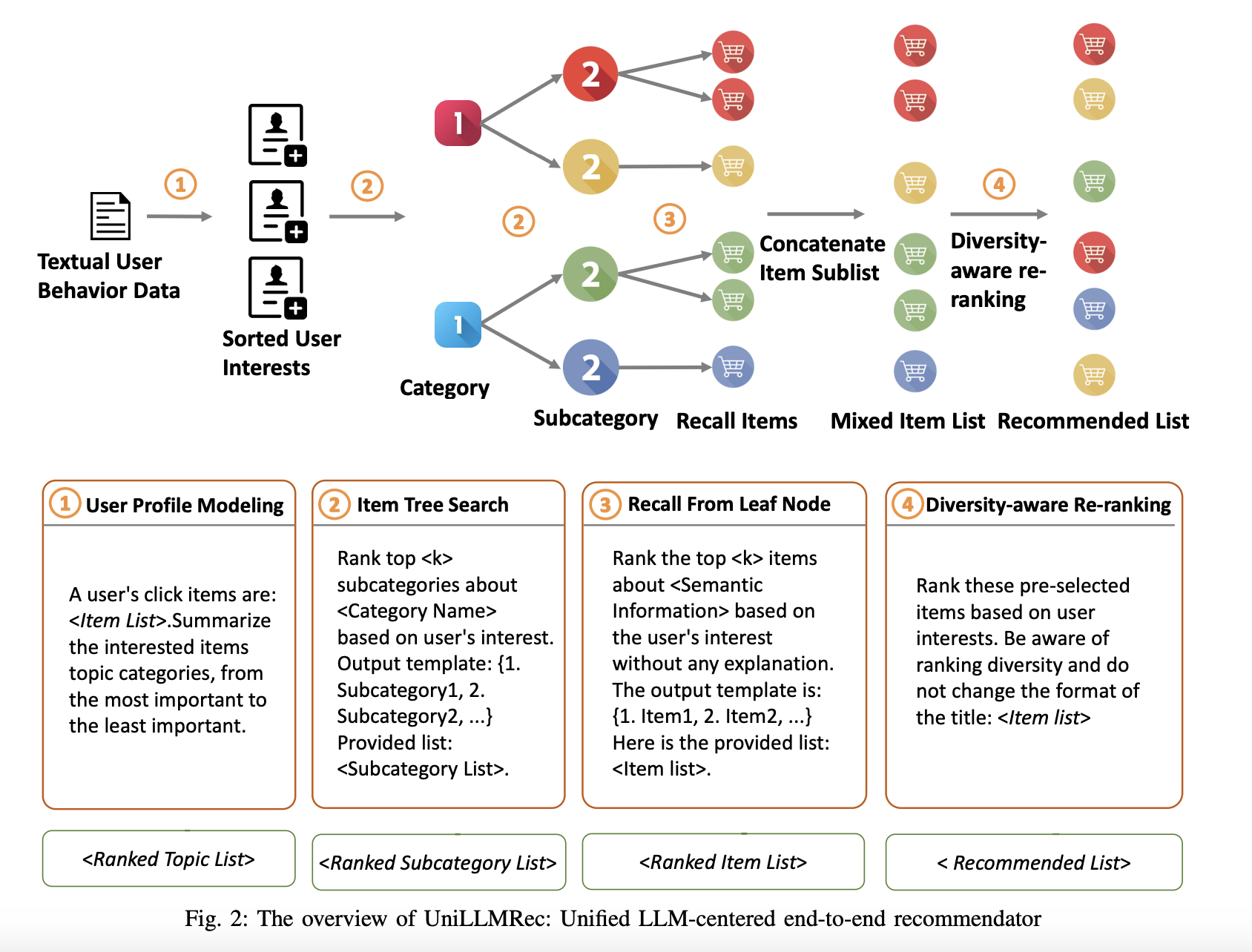

Investigadores de la Universidad de la ciudad de Hong Kong y el Laboratorio Arca de Noé de Huawei proponen UniLLMRec, un marco innovador que aprovecha un LLM singular para realizar sin problemas la recuperación, clasificación y reclasificación de elementos dentro de un marco de recomendación unificado de extremo a extremo. Una ventaja clave de UniLLMRec radica en la utilización de las capacidades inherentes de disparo cero de los LLM, lo que elimina la necesidad de capacitación o ajustes. Por lo tanto, UniLLMRec ofrece una solución más optimizada y eficiente en recursos en comparación con los sistemas tradicionales, lo que facilita implementaciones más efectivas y escalables en una variedad de contextos de recomendación.

Para garantizar que UniLLMRec pueda manejar eficazmente un corpus de artículos a gran escala, los investigadores han desarrollado una estrategia única de recuperación basada en árboles. Específicamente, esto implica construir un árbol que organiza elementos según atributos semánticos como categorías, subcategorías y palabras clave, creando una jerarquía manejable a partir de una lista extensa de elementos. Cada nodo de hoja en este árbol abarca un subconjunto manejable del inventario completo de artículos, lo que permite un recorrido eficiente desde la raíz hasta los nodos de hoja apropiados. Por lo tanto, sólo se pueden buscar elementos de los nodos hoja seleccionados. Este enfoque contrasta marcadamente con los métodos tradicionales que requieren buscar en toda la lista de artículos, lo que resulta en una optimización significativa del proceso de recuperación. Los sistemas existentes basados en LLM se centran principalmente en la etapa de clasificación en el sistema de recomendación y clasifican solo una pequeña cantidad de elementos candidatos. En comparación, UniLLMRec es un marco integral que unifica LLM para integrar tareas de múltiples etapas (por ejemplo, recordar, clasificar, reclasificar) por cadena de recomendación.

Los resultados obtenidos por UniLLMRec se pueden concluir como:

- Tanto UniLLMRec (GPT-3.5) como UniLLMRec (GPT-4), que no requieren capacitación, logran un rendimiento competitivo en comparación con los modelos de recomendación convencionales que requieren capacitación.

- UniLLMRec (GPT-4) supera significativamente a UniLLMRec (GPT3.5). Las capacidades mejoradas de comprensión semántica y procesamiento del lenguaje de UniLLMRec (GPT-4) lo hacen competente en la utilización de árboles de proyectos para completar todo el proceso de recomendación.

- UniLLMRec (GPT-3.5) muestra una disminución del rendimiento en el conjunto de datos de Amazon debido al desafío de abordar el desequilibrio en el árbol de artículos y la información limitada disponible en el índice de títulos de artículos. Sin embargo, UniLLMRec (GPT-4) sigue teniendo un rendimiento superior en Amazon.

- UniLLMRec con ambas redes troncales puede mejorar eficazmente la diversidad de recomendaciones. UniLLMRec (GPT-3.5) tiende a proporcionar elementos más homogéneos que UniLLMRec (GPT-4).

En conclusión, esta investigación presenta UniLLMRec, el primer marco de recomendación integral centrado en LLM para ejecutar tareas de recomendación de múltiples etapas (por ejemplo, recuperación, clasificación, reclasificación) a través de una cadena de recomendaciones. Para abordar conjuntos de elementos a gran escala, los investigadores diseñan una estrategia innovadora para estructurar todos los elementos en una estructura de árbol jerárquico, es decir, un árbol de elementos. El árbol de elementos se puede actualizar dinámicamente para incorporar nuevos elementos y recuperarlos de manera efectiva según los intereses del usuario. Según el árbol de elementos, LLM reduce efectivamente el conjunto de elementos candidatos utilizando esta estructura jerárquica para la búsqueda. UniLLMRec logra un rendimiento competitivo en comparación con los modelos de recomendación convencionales.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Únete a nuestro Canal de telegramas, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro SubReddit de 39k+ ML

Asjad es consultor interno en Marktechpost. Está cursando B.Tech en ingeniería mecánica en el Instituto Indio de Tecnología, Kharagpur. Asjad es un entusiasta del aprendizaje automático y el aprendizaje profundo que siempre está investigando las aplicaciones del aprendizaje automático en la atención médica.