A medida que las interacciones digitales se vuelven cada vez más complejas, se intensifica la demanda de herramientas analíticas sofisticadas para comprender y procesar estos datos diversos. El desafío principal implica integrar distintos tipos de datos, principalmente imágenes y texto, para crear modelos que puedan interpretar y responder eficazmente a entradas multimodales. Este desafío es fundamental para aplicaciones que van desde la generación automatizada de contenido hasta sistemas interactivos mejorados.

Las investigaciones existentes incluyen modelos como LLaVa-NeXT y MM1, conocidos por sus sólidas capacidades multimodales. La serie LLaVa-NeXT, en particular la variante 34B, y los modelos MM1-Chat han establecido puntos de referencia en respuesta visual a preguntas e integración de imagen y texto. Los modelos Gemini como Gemini 1.0 Pro impulsan aún más el rendimiento en tareas complejas de IA. DeepSeek-VL se especializa en respuesta visual a preguntas, mientras que Claude 3 Haiku se destaca en generar contenido narrativo a partir de entradas visuales, mostrando diversos enfoques para combinar datos visuales y textuales dentro de marcos de IA.

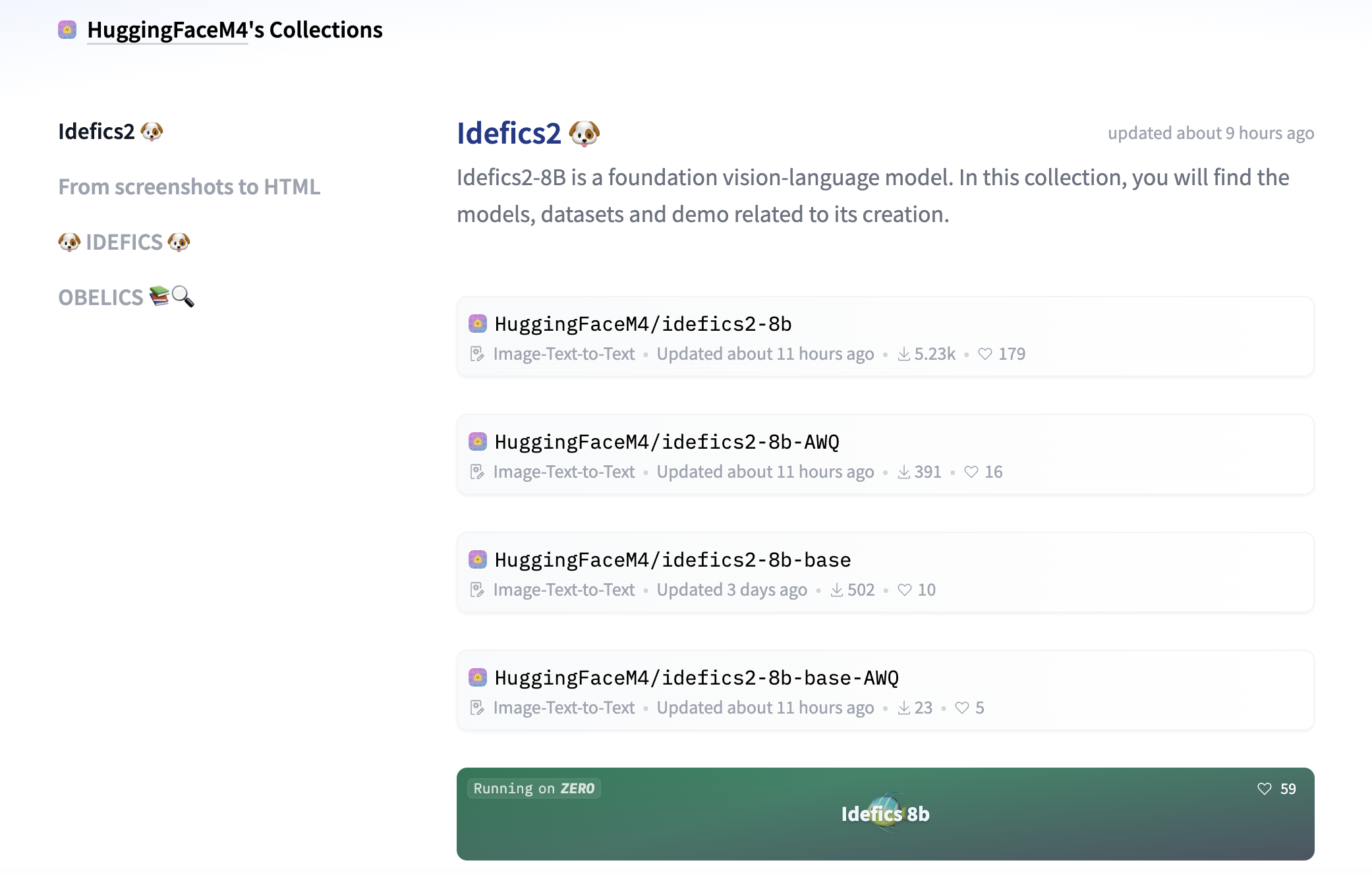

Los investigadores de Hugging Face han introducido Idéficas2un poderoso Modelo visión-lenguaje del parámetro 8B diseñado para mejorar la integración del procesamiento de texto e imágenes dentro de un único marco. Este método contrasta con los modelos anteriores, que a menudo requerían cambiar el tamaño de las imágenes a dimensiones fijas, comprometiendo potencialmente el detalle y la calidad de los datos visuales. Esta capacidad, derivada de la estrategia NaViT, permite a Idefics2 procesar información visual de manera más precisa y eficiente. La integración de características visuales en la columna vertebral del lenguaje a través de la agrupación de perceptores aprendidos y una proyección de modalidad MLP distingue aún más este modelo, lo que facilita una comprensión más profunda y matizada de las entradas multimodales.

El modelo fue entrenado previamente en una combinación de recursos disponibles públicamente, incluidos documentos web intercalados, pares de imágenes y leyendas del conjunto de datos público multimodal y LAION-COCO, y datos OCR especializados de PDFA, IDL y texto renderizado. Además, Idefics2 se perfeccionó utilizando “The Cauldron”, una compilación cuidadosamente seleccionada de 50 conjuntos de datos de visión y lenguaje. Esta fase de ajuste empleó tecnologías como Lora para el aprendizaje adaptativo y estrategias de ajuste específicas para parámetros recién inicializados en el conector de modalidad, lo que sustenta las distintas funcionalidades de sus diversas versiones, que van desde el modelo base generalista hasta el Idefics2-8B, adepto a la conversación. -Hablador, listo para ser liberado. Cada versión está diseñada para sobresalir en diferentes escenarios, desde tareas multimodales básicas hasta interacciones complejas y de larga duración.

Versiones de Idefics2:

Idéfics2-8B-Base:

Esta versión sirve como base de la serie Idefics2. Tiene 8 mil millones de parámetros y está diseñado para manejar tareas multimodales generales. El modelo base está previamente entrenado en un conjunto de datos diverso, incluidos documentos web, pares de imágenes y leyendas y datos de OCR, lo que lo hace sólido para muchas tareas básicas de visión y lenguaje.

Idéficos2-8B:

El Idefics2-8B amplía el modelo base incorporando ajustes en ‘The Cauldron’, un conjunto de datos especialmente preparado que consta de 50 conjuntos de datos multimodales seleccionados manualmente y conjuntos de datos de ajuste con instrucciones de solo texto. Esta versión está diseñada para funcionar mejor en tareas complejas de seguimiento de instrucciones, mejorando su capacidad para comprender y procesar entradas multimodales de manera más efectiva.

Idefics2-8B-Chatty (Próximamente):

Anticipado como un avance sobre los modelos existentes, el Idefics2-8B-Chatty está diseñado para conversaciones largas y una comprensión contextual más profunda. Está aún más optimizado para aplicaciones de diálogo, lo que lo hace ideal para escenarios que requieren interacciones prolongadas, como robots de servicio al cliente o aplicaciones de narración interactiva.

Mejoras sobre Idefics1:

- Idefics2 utiliza la estrategia NaViT para procesar imágenes en resoluciones nativas, mejorando la integridad de los datos visuales.

- Las capacidades de OCR mejoradas a través de la integración de datos especializados mejoran la precisión de la transcripción de texto.

- La arquitectura simplificada que utiliza el codificador de visión y la agrupación de Perceiver aumenta significativamente el rendimiento con respecto a Idefics1.

En las pruebas, Idefics2 demostró un rendimiento excepcional en múltiples puntos de referencia. El modelo logró una precisión del 81,2 % en la respuesta visual a preguntas (VQA) en los puntos de referencia estándar, superando significativamente a su predecesor, Idefics1. Además, Idefics2 mostró una mejora del 20% en la precisión del reconocimiento de caracteres en tareas de OCR basadas en documentos en comparación con modelos anteriores. Las mejoras en las capacidades de OCR redujeron específicamente la tasa de error del 5,6% al 3,2%, estableciendo su eficacia en aplicaciones prácticas que requieren altos niveles de precisión en la extracción e interpretación de texto.

Para concluir, la investigación presentó Idefics2, un modelo visionario de lenguaje de visión que integra procesamiento de resolución de imagen nativa y capacidades avanzadas de OCR. El modelo demuestra avances significativos en IA multimodal, logrando resultados de primer nivel en tareas de extracción de texto y respuesta visual a preguntas. Al mantener la integridad de los datos visuales y mejorar la precisión del reconocimiento de texto, Idefics2 representa un avance sustancial y promete facilitar aplicaciones de IA más precisas y eficientes en campos que requieren un análisis multimodal sofisticado.

Revisar la Página del proyecto HF y Blog. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Únete a nuestro Canal de telegramas, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro SubReddit de más de 40.000 ml

Para asociación de contenido, por favor Complete este formulario aquí.

Nikhil es consultor interno en Marktechpost. Está cursando una doble titulación integrada en Materiales en el Instituto Indio de Tecnología de Kharagpur. Nikhil es un entusiasta de la IA/ML que siempre está investigando aplicaciones en campos como los biomateriales y la ciencia biomédica. Con una sólida experiencia en ciencia de materiales, está explorando nuevos avances y creando oportunidades para contribuir.